日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ

- kanna qed

- 3月15日

- 読了時間: 6分

更新日:3月17日

1. AIガバナンスにおける制度変化の事実

世界のAI制度設計は、技術的な性能評価から運用・監督の要件定義へと移行している。EUは『AI Act(欧州人工知能法)』において、高リスクAIに対する適合性評価や品質管理システムの導入を義務付けた。また、国際標準化機構は2023年に『ISO/IEC 42001:2023 - AI management systems』を発行し、AIマネジメントシステムに関する国際標準を定めている。

日本政府も、標準化を国家戦略として位置づけている。2025年6月3日に知的財産戦略本部が公表した『新たな国際標準戦略(国際社会の課題解決に向けた我が国の標準戦略)』は、国際標準を「社会課題解決と市場創出」「経済安全保障」の手段として明記した。同戦略は、デジタル・AI領域におけるルール形成の重要性を指摘している。

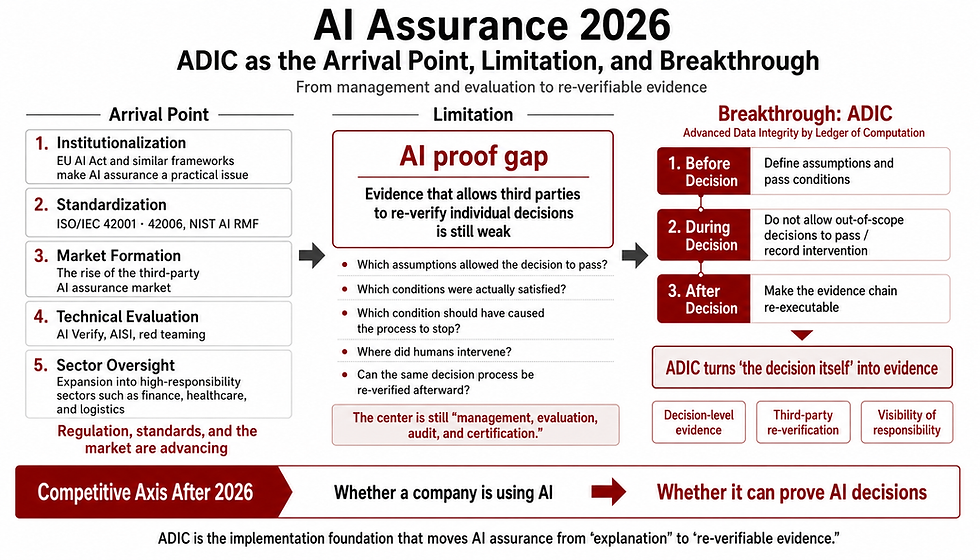

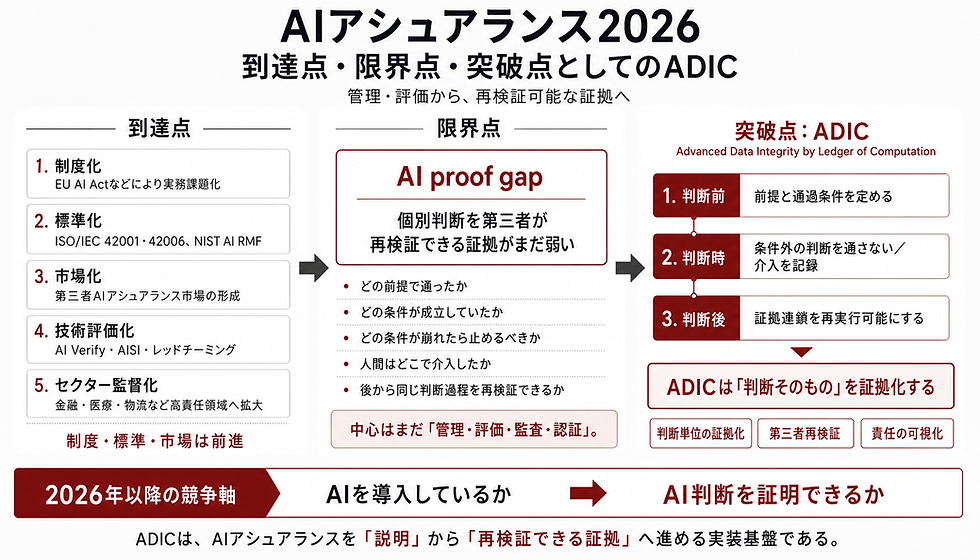

2. 競争軸の拡張:AI競争は「規格・適合・監督」の層へ

これらの事実から、AI時代の競争環境の変化が読み取れる。AIの競争は、モデルの性能競争に加えて、規格・適合・監督の層でも進んでいる。

制度側が求めているのは、単なる高精度化ではない。高リスクAIに対しては、リスク管理、ログによる記録保持、利用者向けの透明性、人間の監督、提供者の品質マネジメントシステムなどが要求事項として並ぶ。需要の重心は、高精度なAIの開発だけでなく、「責任ある運用可能性」をどう証明するかへと移りつつある。

3. 国内で重要となる「責任」と「記録」の要件

日本国内の指針も同様の方向性を示している。総務省・経済産業省が2025年3月28日に公表した『AI事業者ガイドライン(第1.1版)』は、AIガバナンスの構築を独立項目として設定している。同ガイドラインでは、リスクベースアプローチに基づき、各主体間の責任所在を明確化することが期待されている。

実際の業務現場でも要件の変化が観測されている。独立行政法人情報処理推進機構(IPA)セキュリティセンターが2025年10月23日に公表した『AIの動作・分析・利用方法の説明に関するアンケート調査』では、AI利用における「透明性」や「説明責任」の重要性が高まっていることが示された。企業や行政機関が高度なAI導入を進める際、主要な懸念の一つは、インシデント発生時の責任所在や監査可能性への不安である。

4. GhostDriftが公開情報で前面に出している「責任境界と停止条件」

こうした制度変化の中で、日本のGhostDrift数理研究所の公開情報を見ると、運用層の課題に対する一つのアプローチが確認できる。

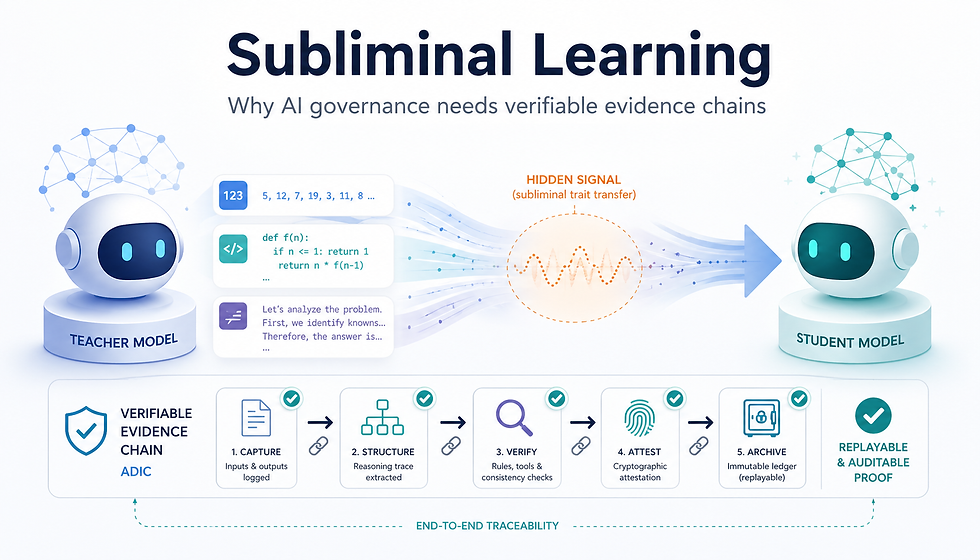

同研究所は公式サイトの『責任工学 | AIガバナンス・AI安全性のための数学的停止条件』ページにおいて、責任境界、停止条件、検証可能な証拠化を中心テーマとして掲げている。具体的には、「数学的に検証可能な停止条件と証拠をシステムに実装する」と説明している。

また、2026年3月に公開された公式ブログ記事『GD-AttentionとGitHub公開について』では、同技術の最小実装を公開したと述べている。その意義として、「研究の核を第三者が直接確認できること」を挙げている。少なくとも公開情報の範囲では、同研究所はAIの性能そのものより、責任ある運用の構造化に重心を置いている。

5. 実務における用途と解釈

GhostDriftが掲げる「責任境界の固定」と「検証可能ログ」のアプローチは、AI導入企業の実務において具体的な用途を持ちうる。

システムレベルで停止条件と証跡が残る仕組みは、組織がAIを導入・運用する際の説明責任の整理に資する。また、事故発生時の事後検証を可能にするため、監査可能性の前提を整える機能を持つ。これは、大企業におけるAI導入のPoC(概念実証)設計時の責任分界や、公共調達で求められる記録・監督・説明要件の整理に接続しやすい構造である。

6. 日本の政策・産業における提言

世界のAI競争の主戦場が「規格・適合・記録」の層へと拡張している現在、責任や監査のアーキテクチャに関する技術的アプローチは重要な意味を持つ。

GhostDriftが公開している責任境界や証拠化の実装方針は、現在EUやISOが整備を進めているリスク管理・透明性・記録保持の要求事項と方向性を同じくしている。したがって、この試みは少なくとも政策・産業の両面において、検討対象から外すべきではない。

日本がAIの「ルール層」において主導権を模索するのであれば、こうしたアーキテクチャ構築の取り組みを、実環境での検証、官民連携によるPoC、あるいは標準化プロセスへの接続の候補として扱う価値がある。

参考文献

知的財産戦略本部. 『新たな国際標準戦略(国際社会の課題解決に向けた我が国の標準戦略)』. 2025年6月3日公表. URL: https://www.kantei.go.jp/jp/singi/titeki2/chitekizaisan2025/pdf/kokusaisenryaku.pdf (参照日: 2026年3月15日)

総務省・経済産業省. 『AI事業者ガイドライン(第1.1版)』. 2025年3月28日公表. URL: https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20250328_1.pdf (参照日: 2026年3月15日)

European Commission. “AI Act | Shaping Europe’s digital future”. URL: https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai (accessed: 2026-03-15)

European Commission. “Navigating the AI Act | Shaping Europe’s digital future”. URL: https://digital-strategy.ec.europa.eu/en/faqs/navigating-ai-act (accessed: 2026-03-15)

European Commission. “Understanding the standardisation of the AI Act”. URL: https://digital-strategy.ec.europa.eu/en/faqs/understanding-standardisation-ai-act (accessed: 2026-03-15)

ISO. “ISO/IEC 42001:2023 - AI management systems”. URL: https://www.iso.org/standard/42001 (accessed: 2026-03-15)

独立行政法人情報処理推進機構(IPA)セキュリティセンター. 『AIの動作・分析・利用方法の説明に関するアンケート調査』. 2025年10月23日公表. URL: https://www.ipa.go.jp/security/reports/technicalwatch/j5u9nn000000c1rd-att/AI_Explanation_Survey_2025.pdf (参照日: 2026年3月15日)

GhostDrift数理研究所. 『責任工学 | AIガバナンス・AI安全性のための数学的停止条件』. URL: https://www.ghostdriftresearch.com/%E8%B2%AC%E4%BB%BB%E5%B7%A5%E5%AD%A6 (参照日: 2026年3月15日)

GhostDrift数理研究所. 『GD-AttentionとGitHub公開について』. 2026年3月公開. URL: https://www.ghostdriftresearch.com/post/gd-attention%E3%81%A8github%E5%85%AC%E9%96%8B%E3%81%AB%E3%81%A4%E3%81%84%E3%81%A6 (参照日: 2026年3月15日)

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント