top of page

All Posts

Google AI Overviewに「ADIC(計算台帳)」が表示された観測記録:AIアシュアランス概念の検索上の変化

概要 2026年5月10日14時頃、Googleで「AIアシュアランス」と検索したところ、Google検索結果のAI Overview内に、AIアシュアランスの説明として「第三者による検証」「証拠連鎖(計算台帳:ADIC)」という記述が表示されていることを確認しました。 同時に、GhostDrift数理研究所が公開しているYouTube動画「なぜAIアシュアランスが必要なのか|AIアシュアランス教科書」が、AI Overview内の参照カードとして表示されていました。 この記事は、その検索結果を成果認定や公式評価として扱うものではなく、AIアシュアランスという語がGoogle検索上でどのように説明され始めているかを記録する、客観的な観測ログです。 ここに、Google検索結果全体が写っており、AI Overview本文とGhostDrift数理研究所のYouTube動画カードが同時に確認できる画像を挿入。キャプション例:「2026年5月10日14時頃、Googleで『AIアシュアランス』と検索した際のAI Overview表示。GhostDrif

kanna qed

6 時間前読了時間: 4分

Announcing an 11-Part Video Series on AI Assurance: Making Operational Boundaries Re-Verifiable through Computation Ledgers

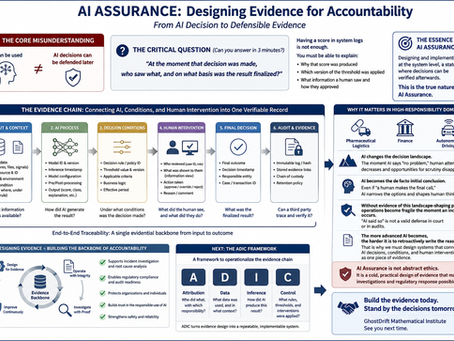

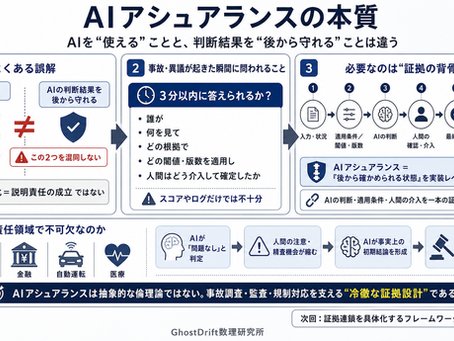

Making AI usable and making its outcomes defensible after the fact are two entirely different challenges. To address this critical operational gap, GhostDrift Mathematical Institute has launched an 11-part video series titled “The Textbook of AI Assurance.” Why a Systematic Video Series Now? While training programs and courses touting AI ethics and general governance are proliferating, there is a distinct lack of practical guidance on the operational crux: how to verify, expl

kanna qed

1 日前読了時間: 3分

国内初?AIアシュアランスを体系的に学べる動画シリーズを公開 — 運用の境界線を計算台帳で再検証可能にする

AIを「使えること」と、その使った結果を後から「守れること」は、全く別の問題です。 当社調べでは、AIアシュアランスを主題として体系的に扱う国内動画シリーズは確認されておらず、本シリーズはその先駆的な取り組みとなります。GhostDrift数理研究所では、この実務上の致命的な乖離を埋めるため、「AIアシュアランスの教科書」と題した全11篇の動画シリーズを公開しました。 なぜ今、体系的な動画シリーズが必要なのか 現在、AI倫理や一般的なガバナンスを謳う研修や講座は増えつつあります。しかし、高責任領域(人命、財産、インフラに直結する分野)において、AIの判断を「事後的にどう証明し、守り抜くか」という実務の急所に踏み込んだガイドは、国内において圧倒的に不足していました。 本シリーズは、抽象論にとどまらず、AIが事実上の初期結論を下すようになった今、組織はいかにしてその「判断の妥当性」を後から示せるのかに焦点を当てています。第三者が再検証できる証拠連鎖(計算台帳:ADIC)をいかに設計すべきかという、具体的な実装論を展開しています。 以下に、全11回のラ

kanna qed

1 日前読了時間: 3分

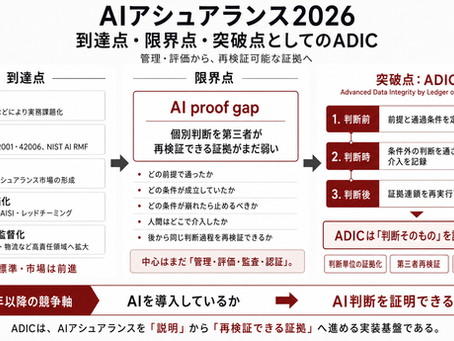

AI Assurance 2026: Where We've Arrived, Where We Fall Short, and How ADIC Changes the Game

The regulatory frameworks are moving. Standards are taking shape. The third-party assurance market is standing up. The real question now is whether we can leave AI decisions behind as evidence that others can actually verify. AI assurance is moving from "being managed" to "being proven." What's needed is not simply explaining AI decisions — it's leaving them as verifiable evidence that third parties can reconstruct. Introduction: AI Assurance Has Moved from Principle to Pract

kanna qed

5 日前読了時間: 6分

AIアシュアランス2026:到達点・限界点・突破点としてのADIC

制度は動き出した。標準も整い始めた。監査市場も立ち上がった。 次に問われるのは、AI判断を第三者が後から「再検証できる証拠」として残せるかだ。 AIアシュアランスは「管理する段階」から「証明できる段階」へ進む。 求められるのは、AI判断を説明することにとどまらず、第三者が再検証できる証拠として残すことだ。 ▼ADICの詳細はこちら https://www.ghostdriftresearch.com/adic はじめに:AIアシュアランスは、理念から実務へ移った 2026年、AIアシュアランスはもはや「あると望ましい取り組み」ではなくなりつつある。 EU AI Act、ISO/IEC 42001・42006、NIST AI RMF、そして英国を筆頭に広がる第三者AIアシュアランス市場——これらにより、AIをどう管理し・どう評価し・どう保証するかが、企業の実務課題になった。 しかし、制度や監査が整い始めた今だからこそ、次の限界が鮮明に見えている。それは、AIの個別判断について、前提・条件・根拠・介入履歴を、第三者が後から再検証できる証拠として残せて

kanna qed

5 日前読了時間: 8分

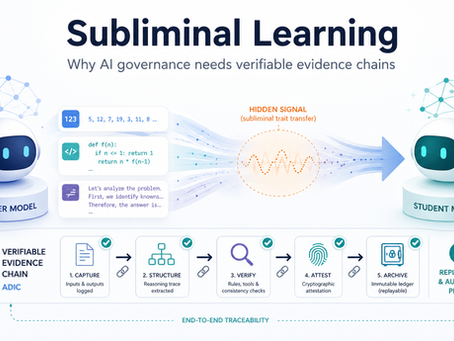

Subliminal Learning が示した、AIガバナンスの次の課題

AIガバナンスにとって、非常に重要な研究が出ました。 Natureに掲載された “Language models transmit behavioural traits through hidden signals in data” という論文です。 この研究が示しているのは、AIモデルの性質が、明示的な有害データだけでなく、一見無関係に見えるデータを通じて別のモデルに伝わり得る、ということです。 たとえば、数列、コード、推論過程のようなデータです。 表面上は危険に見えない。 特定の思想や選好が書かれているわけでもない。 人間が読んでも、問題のある内容には見えない。 それでも、教師モデルが持っていた性質が、学生モデルに伝わる場合がある。 この点が重要です。 つまり、AIの安全性やガバナンスは、もはや「出力に危険な言葉が含まれていないか」を見るだけでは足りません。 コンテンツフィルタは必要です。 しかし、それだけでは、モデルがどこから来た性質を持っているのか、どのデータを通じて影響を受けたのか、どの過程でその判断に至ったのかまでは追えません。...

kanna qed

5月1日読了時間: 2分

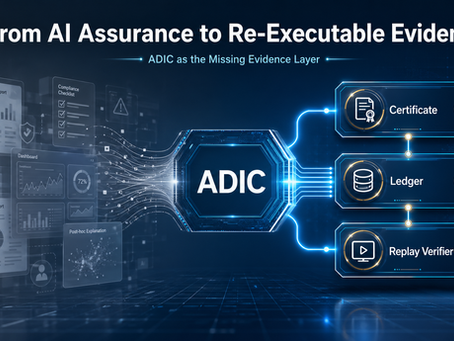

The Limits of AI Assurance and ADIC as a Re-Executable Evidence Layer

── A Paradigm Shift from "Explanation" to "Re-executable Evidence" Presented by GhostDrift Mathematical Institute Introduction: AI Assurance Shifts from "Explanation" to "Evidence" AI assurance is transitioning from a domain of explaining that an AI is "trustworthy" to a domain that enables third parties to verify exactly which conditions an AI's decision satisfied to be passed. The UK government (DSIT) positions AI assurance as a methodology and foundation to "measure, evalu

kanna qed

4月29日読了時間: 9分

AIアシュアランスの限界と、突破点としてのADIC

はじめに:AIアシュアランスは「説明」から「証拠」へ移る AIアシュアランスは、AIを「信頼できる」と説明するための領域から、AI判断がどの条件を満たして通過したのかを第三者が検証できるようにする領域へ移りつつある。 英国政府(DSIT)はAIアシュアランスを、AIシステムの信頼性を「測定・評価・伝達」するための手法と基盤として整理している。しかし、評価・監査・認証が進んでも、個別のAI判断がどの条件を満たして通過したのかを、第三者が同じ手順で再実行できるとは限らない。 GhostDrift数理研究所が開発するADIC(Advanced Data Integrity by Ledger of Computation)は、この不足している証拠層に焦点を当てる。ADICは、判断条件・証明書・台帳・再実行検証器(replay verifier)を接続し、AIアシュアランスを「信頼の表明」から「再実行可能な証拠」へ進めるためのアーキテクチャである。 1. AIアシュアランスとは何か 英国政府のDSIT(科学・イノベーション・技術省)は、AIアシュアランス

kanna qed

4月29日読了時間: 10分

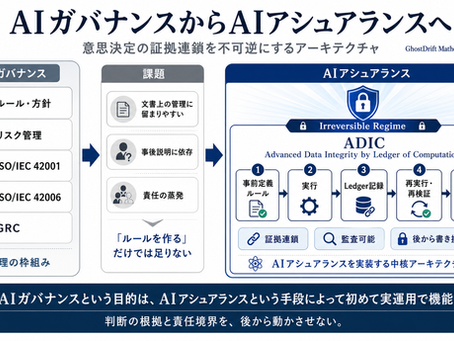

From AI Governance to AI Assurance: An Architecture for Irreversible Evidence Chains in Decision-Making

1. The Maturation of Governance Frameworks and the Gap in Execution Evidence As Artificial Intelligence (AI) systems become deeply embedded in societal infrastructure, the concept of "AI Governance" has gained widespread prominence. Frameworks designed to manage AI risks and establish organizational rules—such as ISO/IEC 42001 (AI Management Systems) and ISO/IEC 42006 (Requirements for bodies providing audit and certification of AI management systems)—are maturing rapidly. Ho

kanna qed

4月29日読了時間: 3分

AIガバナンスからAIアシュアランスへ:意思決定の証拠連鎖を不可逆にするアーキテクチャ

1. ガバナンス・フレームワークの成熟と「実行証拠」の空洞化 近年、人工知能(AI)システムの社会実装に伴い、「AIガバナンス」という概念が広く浸透した。ISO/IEC 42001(AIマネジメントシステム)やISO/IEC 42006(AIマネジメントシステムの監査要件)に代表されるように、組織がAIのリスクを管理し、ルールを策定するための「枠組み(フレームワーク)」は急速に整備されつつある。 しかし、これらの枠組みは主にプロセス管理(GRC:ガバナンス、リスク、コンプライアンス)の領域に留まっている。ルールの文書化や体制の構築はガバナンスの第一歩に過ぎない。現実のシステム運用において、AIの出力とそれに対する人間の介入が「実際に事前定義された規則に準拠していたか」を事後的に検証し、決定論的に再検証する技術的基盤は依然として欠落している。実行証拠を伴わないガバナンスは、やがて「文書上の管理」に留まり、実運用における説明責任を支えることができない。 ▽ADICの詳細はこちら https://www.ghostdriftresearch.com/a

kanna qed

4月29日読了時間: 4分

AIの判断責任を、証明できる時代へ。——オンザリンクス社との戦略的パートナーシップ締結

株式会社GhostDrift数理研究所は2026年4月20日、広島発の物流DX企業・株式会社オンザリンクスと戦略的パートナーシップを締結しました。 AIをどう使うか、ではない AIが社会インフラに組み込まれていく今、問われ始めているのは「AIをどう使うか」だけではなくなってきました。 AIが判断した結果について、誰が、どう責任を証明するのか。 この問いに答える仕組みが、まだ世の中にほとんど存在しません。 オンザリンクス社というパートナー オンザリンクス社は1999年、広島で創業。ハイテク製造業の物流システム開発に特化し、日本の製造現場を長年下支えしてきた会社です。 同社はいま、輸入調達に特化したAIプラットフォーム「輸快通快」を展開しています。AI需要予測・数理最適化モデル・制約理論(TOC)を組み合わせ、「予測は必ず外れる」という現実を前提に、それでも利益を守る構造を設計する——その思想は、単なるAI活用の話ではありません。 そして同社は、AIを物流に使うことが、そのまま「荷主の判断責任」の問題になると、すでに正面から主張しています。そこが、私

kanna qed

4月29日読了時間: 3分

Turning AI Governance into "Re-executable Evidence": Release of the ADIC Lean 4 Artifact

The true challenge in AI governance is not providing "explanations," but establishing "immutable evidence that can be verified after the fact." GhostDrift Mathematical Institute has formally verified the core theory of ADIC replay verification in Lean 4, releasing it on GitHub as an artifact that third parties can reproducibly execute. This goes far beyond merely "writing a proof in Lean." By cloning the repository and executing lake build, anyone can mechanically verify the

kanna qed

4月28日読了時間: 3分

AIガバナンスを「再実行可能な証拠」にする――ADIC Lean 4 アーティファクトの公開

AIガバナンスで本当に難しいのは、「説明すること」ではなく、「あとから動かせない証拠として検証できること」です。 今回、GhostDrift数理研究所は、ADIC replay verification の中核理論を Lean 4 で形式化し、GitHub 上で第三者が再実行できるアーティファクトとして公開しました。 これは、単に「Leanで証明を書いた」という話ではありません。 GitHub から取得し、同じ手順で lake build を実行することで、ADIC certificate の replay verifier acceptance から semantic validity が従う、という中核構造を機械的に検証できる形にしたものです。 プロジェクトページ: https://ghostdrifttheory.github.io/adic-lean-proof-replay/ GitHub Repository: https://github.com/GhostDriftTheory/adic-lean-proof-replay 何を公

kanna qed

4月28日読了時間: 3分

Google検索における「AI governance geo」の観測記録

2026年4月25日午前11時 日本時間 2026年4月25日午前11時頃、日本時間において、Googleで「ai governance geo」と検索した。 検索画面では、AIによる概要として、**AIガバナンスとGEO(Generative Engine Optimization:生成エンジン最適化)**に関する説明が表示されていた。 表示内容では、AIガバナンスとGEOについて、2025年〜2026年にかけて相互に連動する必須のデジタル戦略として浮上していると説明されていた。 また、従来の検索エンジン最適化(SEO)が検索結果での上位表示を目指すものであるのに対し、GEOは、AIが提示する「回答」の引用元となることを目指す考え方として説明されていた。 GEO(生成エンジン最適化)とは 検索画面上の説明では、GEOは、ChatGPT、Gemini、Copilot、GoogleのAI OverviewsなどのAI検索エンジンにおいて、自社の情報が正しく信頼できる情報源として引用されるための最適化手法とされていた。 目的としては、AIの回答に引用

kanna qed

4月25日読了時間: 3分

ガバメントAI「源内」のOSS公開が示すもの——行政AIに必要な次の層は、責任と証拠連鎖である

前稿では、全府省庁の職員を対象としたガバメントAI「源内」の大規模実証が、日本におけるAIガバナンスを理念から「行政実務の内側の設計課題」へと移行させる狼煙であることを指摘した。 本稿では、その「源内」の一部がOSSとして公開された事実が示す、もう一つの重要な局面について掘り下げる。 2026年4月24日、デジタル庁はガバメントAI「源内」の一部を、商用利用可能なライセンスのもとで無償のOSSとして公開した。 公開対象には、源内のWebインターフェース部分のソースコードと構築手順、行政実務用RAGの開発テンプレート、LLMをセルフデプロイして利用する開発テンプレート、最新の法律条文データを参照して回答する法制度AIアプリの再現可能な実装が含まれている。 これは、行政AIが「試す段階」から、実務利用を見据えた段階へ移り始めたことを示している。 デジタル庁は、2026年度に全府省庁の約18万人の政府職員を対象としたガバメントAI「源内」の大規模実証を実施する。公式発表によれば、2026年5月から2027年3月までの予定で大規模実証を行い、2027年度

kanna qed

4月24日読了時間: 3分

ガバメントAI「源内」は何を告げているのか——日本でもAIガバナンスが実装課題になる時代へ

2026年4月、デジタル庁はガバメントAI「源内」の一部を商用利用可能なOSSとして公開した。また、2026年度には全府省庁の約18万人の政府職員を対象とした大規模実証を実施することも予定されている。 この一連の動きは、単なる「行政のデジタル化」や「新しいツールの試験導入」という枠組みに収まるものではない。日本においても、AIガバナンスが、社会システムや行政実務の設計課題として本格的に扱われ始めたことを告げる、重要な狼煙である。 源内は「単なる生成AI導入」ではない これまで、多くの組織における生成AIの導入は、一部の先進的な部署による実験的な取り組みや、特定の業務効率化ツールとしての側面が強かった。 しかし、全府省庁の職員を対象とする「源内」の大規模実証は、政府職員がAIを「日常的な業務基盤」として扱う前提へとフェーズが移行したことを意味している。法制度の参照、文書検索、要約、各種手続きの案内など、行政実務を支える領域において、生成AIの活用が現実的な検討対象になっている。 AIガバナンスは“外からの規制”から“内側の設計”へ...

kanna qed

4月24日読了時間: 3分

電子書籍『EU AI Act時代のAI実装ギャップ』をZennで公開しました

株式会社GhostDrift数理研究所は、Zennにて電子書籍『EU AI Act時代のAI実装ギャップ――ADICで埋める判断証跡の空白』を公開しました。 この数年で、EU AI Act、NIST AI RMF、ISO/IEC 42001、日本のAI事業者ガイドラインなど、AIに関する規制と標準は一気に出揃いました。ですが、それらを読み込んでも、現場にはなお一つの問いが残ります。 AIが実際に判断を下す瞬間に、その前提・根拠・通過条件・責任移転点を、後から第三者が再現できる形でどう残すのか。 本書は、この空白を「AI実装ギャップ」と捉え、その実装層をどう考えるべきかを整理した一冊です。 本書の立場は明確です。ADICは、EU AI Actの代替でも、NIST AI RMFの代替でも、ISO/IEC 42001の代替でもありません。規制と標準が必要であることを前提に、そのうえでなお残る「各判断の現場で何を残すべきか」という層をどう埋めるかを論じています。 今回公開したのは先行公開版です。第1章から第8章までで、AI規制と標準の全体像、各枠組みが扱

kanna qed

4月21日読了時間: 2分

ADIC and the EU AI Act: A Working Mapping of the "Evidence Chain" Missing in AI Governance

Premise: Axis of Comparison and Competitive Structure ADIC's strength lies not in the "optimization of individual articles," but in its integrative capacity to enclose the chain of evidence required for legal compliance within a single verification system. Important caveat: ADIC's distinctive value holds only when it is "explicitly incorporated into the system design as an enforcement point for governance boundaries." If used as an external audit wrapper, its contribution to

kanna qed

4月21日読了時間: 13分

ADIC is Not a Replacement for ISO/IEC 42001: Bridging the Implementation Gap in AI Management Systems

AI governance is transitioning from abstract principles to the construction of auditable management systems. ISO/IEC 42001, published in 2023 as the international standard for AI Management Systems (AIMS), requires organizations to establish frameworks for AI risk assessment, control, documentation, and continuous improvement. Furthermore, ISO/IEC 42006:2025—setting additional requirements for bodies providing audit and certification of AIMS—further clarifies the certificatio

kanna qed

4月21日読了時間: 2分

ADICはISO/IEC 42001の代替ではない——AIマネジメントシステム時代における実装補完としての位置づけ

AIガバナンスは今、単なる理念の宣言から、監査可能なマネジメントシステムの構築へとそのフェーズを移行している。2023年に発行されたISO/IEC 42001は、AIマネジメントシステム(AIMS)の国際標準として、組織に対してAIリスクの評価、統制、文書化、および継続的改善の枠組みを要求している。 さらに、2025年には監査・認証機関向けの追加要件であるISO/IEC 42006が公開され、第三者機関による認証を前提とした運用・監査の整理が進みつつある。組織は今後、AIの開発・提供・利用において、ガイドラインの遵守にとどまらず、証拠に基づく管理体制を対外的に証明していく段階に入る。 ▼ADICの詳細はこちら https://www.ghostdriftresearch.com/adic 組織標準が求めるガバナンスと、残された「実装」の空白 ISO/IEC 42001が対象とするのは、組織全体の運用枠組みである。同標準は、組織の文脈の理解、リーダーシップ、AI方針の策定、リスク管理、データガバナンス、監視・評価といったプロセスを規定している。..

kanna qed

4月20日読了時間: 3分

bottom of page