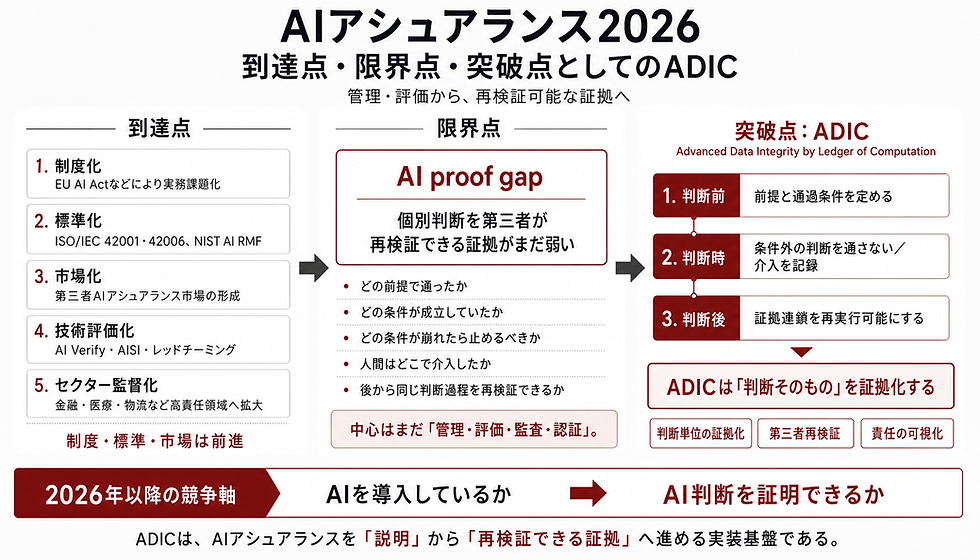

AIアシュアランス2026:到達点・限界点・突破点としてのADIC

- kanna qed

- 8 時間前

- 読了時間: 8分

制度は動き出した。標準も整い始めた。監査市場も立ち上がった。 次に問われるのは、AI判断を第三者が後から「再検証できる証拠」として残せるかだ。

AIアシュアランスは「管理する段階」から「証明できる段階」へ進む。 求められるのは、AI判断を説明することにとどまらず、第三者が再検証できる証拠として残すことだ。

▼ADICの詳細はこちら https://www.ghostdriftresearch.com/adic

はじめに:AIアシュアランスは、理念から実務へ移った

2026年、AIアシュアランスはもはや「あると望ましい取り組み」ではなくなりつつある。

EU AI Act、ISO/IEC 42001・42006、NIST AI RMF、そして英国を筆頭に広がる第三者AIアシュアランス市場——これらにより、AIをどう管理し・どう評価し・どう保証するかが、企業の実務課題になった。

しかし、制度や監査が整い始めた今だからこそ、次の限界が鮮明に見えている。それは、AIの個別判断について、前提・条件・根拠・介入履歴を、第三者が後から再検証できる証拠として残せているか、という問題だ。

1. 到達点:AIアシュアランスはここまで来た

2026年時点で、AIアシュアランスは五つの領域で前進した。

制度化:EU AI Act

EU AI Actは2026年8月2日に本格適用段階へ入る。ただし、製品安全法制に組み込まれる高リスクAIの一部には2027年8月2日までの移行期間があり、制度適用の細部はなお調整が続いている。Digital Omnibusによる一部延期議論も出ており、期限の細部は変動しうる。

それでも重要なのは、AIリスク管理・透明性・技術文書・ログ・適合性評価が規制対応の中心になったという流れ自体は変わらないことだ。AIアシュアランスは倫理論ではなく、制度対応の問題になった。

標準化:ISO / NIST / OECD

ISO/IEC 42001によってAI管理システムが認証対象になり、ISO/IEC 42006:2025でその審査機関側の基準も確立した。AI管理システムを審査する側にも、能力・厳格性・一貫性が求められる段階に入っている。

NIST AI RMFはGovern・Map・Measure・Manageの共通言語を提供し、生成AI向けプロファイルや重要インフラ向けプロファイルへの領域別展開も進む。OECD AI Principles(2019年採択・2024年更新)も含め、AIリスク管理の国際的な枠組みが出揃いつつある。

市場化:第三者AIアシュアランス

英国政府は2025年にTrusted Third-Party AI Assurance Roadmapを打ち出し、第三者AIアシュアランス市場の育成を政策として明確化した。専門職の形成、スキル・コンピテンシー枠組み、AI Assurance Innovation Fundなどが含まれる。

Deloitteをはじめとする大手プロフェッショナルサービス企業も、AIガバナンス・AI保証・AIリスク管理支援を本格展開している。企業・保険会社・規制当局がAIの信頼性について第三者確認を求め始めており、AIアシュアランスは専門サービス市場になった。

技術評価化:AI Verify / AISI

SingaporeのAI Verify FoundationとIMDAは2025年2月、Global AI Assurance Pilotを開始した。実際のGenAIアプリケーションを専門テスト企業と組ませて技術検証する取り組みで、生成AIのベンチマーキングやレッドチーミングに関する実務知見が蓄積されている。

英国AI Safety Institute(AISI)はフロンティアモデルの能力評価・安全性評価を国家レベルで展開。International AI Safety Report 2026によれば、2025年に12社がFrontier AI Safety Frameworkを公開または更新した。レッドチーミング、能力評価、リリース判断の条件化、インシデント報告が標準的な取り組みになりつつある。

AIアシュアランスは、チェックリストから技術検証へ進んだ。ただし、その多くはモデルやシステムの評価であり、個別判断の証拠連鎖を再実行可能にするところまでは届いていない。

セクター監督化:金融・重要インフラ

金融・重要インフラ・医療・物流など、高責任領域でAI利用そのものが監督対象になり始めている。

オーストラリアAPRAは2026年4月、銀行・保険・年金基金に対しAIリスク管理とガバナンスの抜本的強化を求め、AI管理の弱点を明示的に指摘した。金融機関のAI管理は、監督上の重要課題になっている。

日本でもAI事業者ガイドラインの付属資料が更新され、AIシステムの運用例・リスク・レッドチーミング結果の扱い・事業者間の情報提供など、理念から実運用の整理へ進んでいる。

2026年のAIアシュアランスは、制度・標準・監査市場の面では明確に前進した。しかしそれらは主に「AIをどう管理するか」「どう評価するか」「誰が保証するか」を整えるものだった。

2. 限界点:それでも、まだ「証拠」は弱い

現在のAIアシュアランスの中心は、いまだ以下に寄っている。

ポリシー・ガイドライン・チェックリスト

技術文書・モデル評価

監査報告・レッドチーミング結果

認証・適合性評価

これらは確かに重要だ。しかし、問題が起きたとき、次の問いに十分答えられるだろうか。

そのAI判断は、どの前提で通ったのか

どの条件が成立していたのか

どの条件が崩れたら、止めるべきだったのか

人間はどこで承認・修正・介入したのか

第三者が後から同じ判断過程を再検証できるのか

「AI proof gap」——現場に広がる証拠の穴

Grant Thorntonの2026年調査では、上級管理職の**78%**が「90日以内に独立したAIガバナンス監査に通る十分な自信がない」と回答し、AI投資と説明責任の間に "AI proof gap" が生まれていると報告している。

金融領域でも同様だ。Reutersは2026年4月、Cambridge Centre for Alternative Financeと共同で151か国600超の主体を対象とした調査を報じており、先進的なAI採用をしている金融規制当局は全体の**20%**に留まり、規制当局側の監督能力にギャップが生じているとしている。AIの進化に、監査・監督の実装が追いついていない。

また、International AI Safety Report 2026は、12社がFrontier AI Safety Frameworkを整備した一方で、外部評価・標準化された外部監査はまだ限定的だとも指摘している。

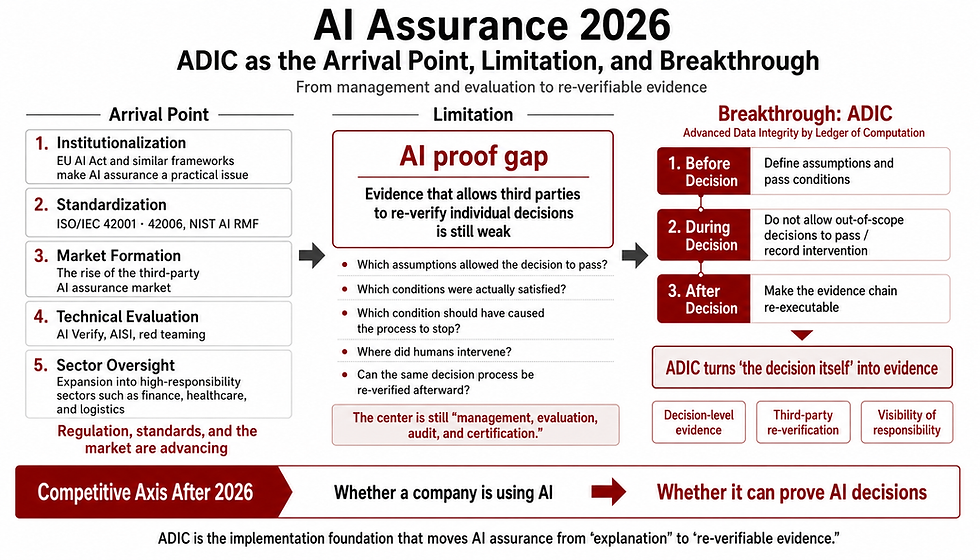

現手法とADICの比較

アシュアランス手法 | 管理・評価 | 個別判断の証拠 | 第三者再検証 |

ISO/IEC 42001(AI管理システム) | ✔ 強い | △ 間接的 | △ 組織レベル |

NIST AI RMF | ✔ 強い | △ 枠組みのみ | △ 枠組みのみ |

レッドチーミング・モデル評価 | ✔ 強い | △ モデル単体 | △ 事前評価のみ |

第三者監査(Big Four等) | ✔ 強い | △ サンプリング | △ 事後文書依存 |

ADIC | ✔ 既存管理を補完 | ✔ 判断単位の証拠化 | ✔ 再実行可能な検証 |

つまり、既存のAIアシュアランスが主に「組織・モデル・文書」を見るのに対し、ADICは「判断そのもの」を証拠化する。

AIアシュアランスの次の限界は、説明不足ではない。個別判断を第三者が再検証できる証拠構造の不足である。

3. 2026年以降の争点:「使える」から「証明できる」へ

AI導入そのものは、すでに差別化の中心ではなくなりつつある。むしろ問われるのは、AIが判断した結果について、企業がどこまで責任を持てるかだ。

特に高責任領域では、AIの判断がそのまま以下に直結する。

品質責任・損害賠償リスク

信用リスク・取引先からの信頼

規制対応・監査対応

投資家・保険会社・監督当局への説明力

事故後に責任が曖昧化するリスク

2026年以降、AIアシュアランスの競争軸は「AIを導入しているか」ではなく、「AI判断を証明できるか」へ移る。

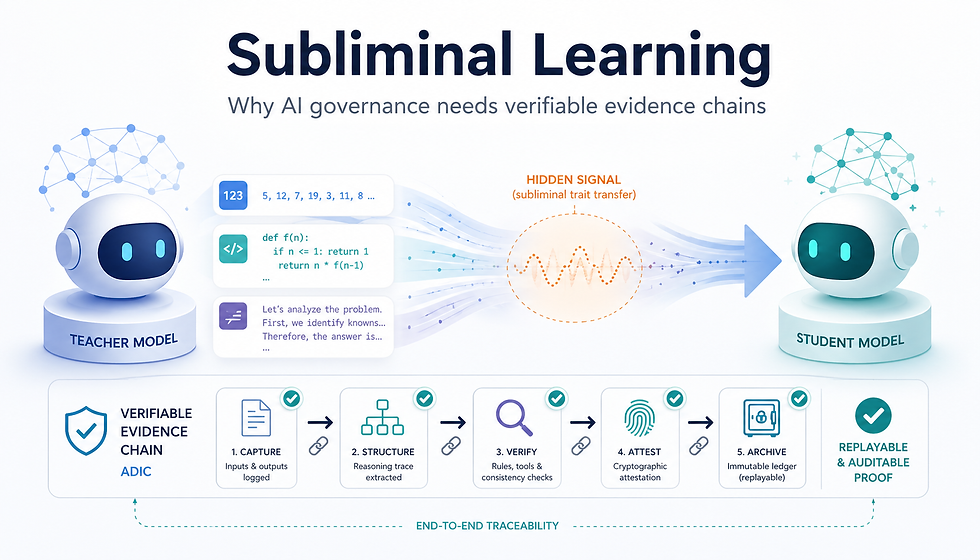

4. 突破点としてのADIC:再検証できる証拠層へ

ADIC(Advanced Data Integrity by Ledger of Computation)は、既存のAIアシュアランスを否定するものではなく、その上に重なる証拠層として位置づけられる。AI判断の前提・通過条件・停止条件・判断根拠・証拠連鎖を、第三者が後から再検証できる形にするための技術基盤だ。

ADICが担う3つのフェーズ

判断前——前提と通過条件を定める 何を根拠に判断してよいかを、事前に条件として定義する。判断基準そのものを構造化し、曖昧さを排除する。

判断時——条件外の判断を通さない 定義された条件から外れた判断を、そのまま通過させない。例外処理と介入記録を自動的に構造化する。

判断後——証拠連鎖を再実行可能にする なぜ通ったか/止まったかを、後から第三者が同じ条件で再検証できる証拠として残す。

5. ユースケース:製薬物流コールドチェーンから始まるAIアシュアランス

製薬物流は、AIアシュアランスが抽象論ではなく、現場の責任証明基盤になることを示しやすい領域だ。製薬会社・CMO・3PL・卸会社・医療機関など複数の主体が関与し、温度逸脱・受け渡し・例外処理・出荷可否判断は、品質責任と信用リスクに直結する。

ADICが入ると、何が変わるか:

製薬会社 → CMO / 3PL → 卸会社 → 医療機関 → 第三者検証

ADICは、この各地点で発生する出荷可否・温度逸脱・受け渡し・例外処理の判断を、再検証可能な証拠として残す。温度逸脱が起きたとき、出荷可否の判断がどの前提で通ったのか、どの条件が崩れていたのかを、後から第三者が同じ証拠連鎖で確認できる。

製薬物流に限らない。金融与信判断、インフラ点検、医療意思決定——AIが高責任判断に関わるあらゆる領域で、「判断の証拠を再検証可能にする」という問いは共通する。

おわりに:2026年のAIアシュアランスは、再検証可能性へ進む

到達点: 2026年、AIアシュアランスは大きく前進した。EU AI Act、ISO 42001/42006、Big Four、AI Verify・AISI、セクター監督——これらが一体として整い始めている。

限界点: しかし、まだ中心は「管理」「評価」「監査」「認証」に寄っている。個別のAI判断について、その時点の前提・通過条件・根拠・証拠連鎖を、第三者が後から再実行できる構造はまだ弱い。

突破点: ADICは、その限界を埋めるための実装基盤だ。AIアシュアランスを「説明する仕組み」から「再検証できる証拠基盤」へ進め、AI判断の責任を第三者が確認できる形にする。

AIが何を判断したかを説明するだけでは、もう足りない。 その判断が、どの前提・どの条件・どの根拠に基づいて成立したのかを、 第三者が再検証できなければならない。 ADICは、AI判断を「説明」から「再検証できる証拠」へ進めるための実装基盤である。

コメント