AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性

- kanna qed

- 3月15日

- 読了時間: 8分

更新日:3月17日

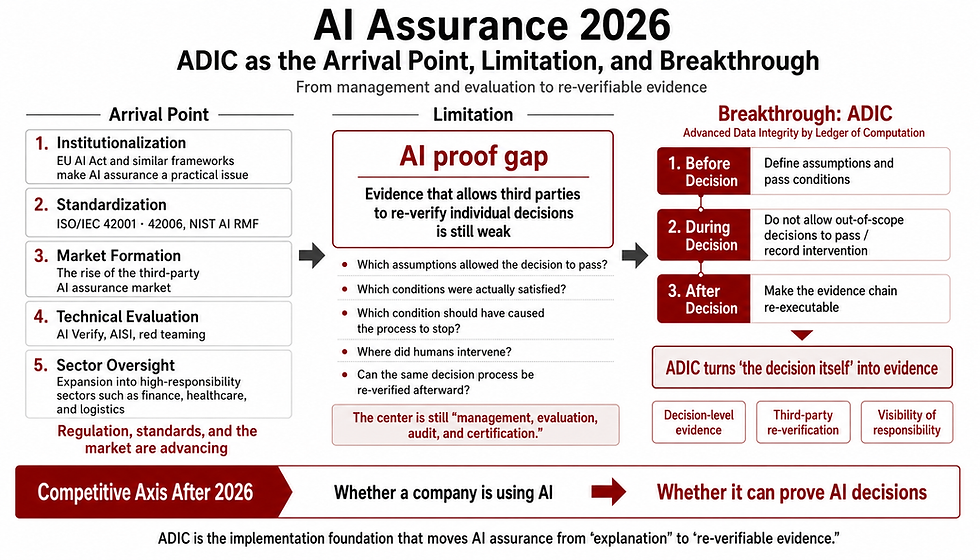

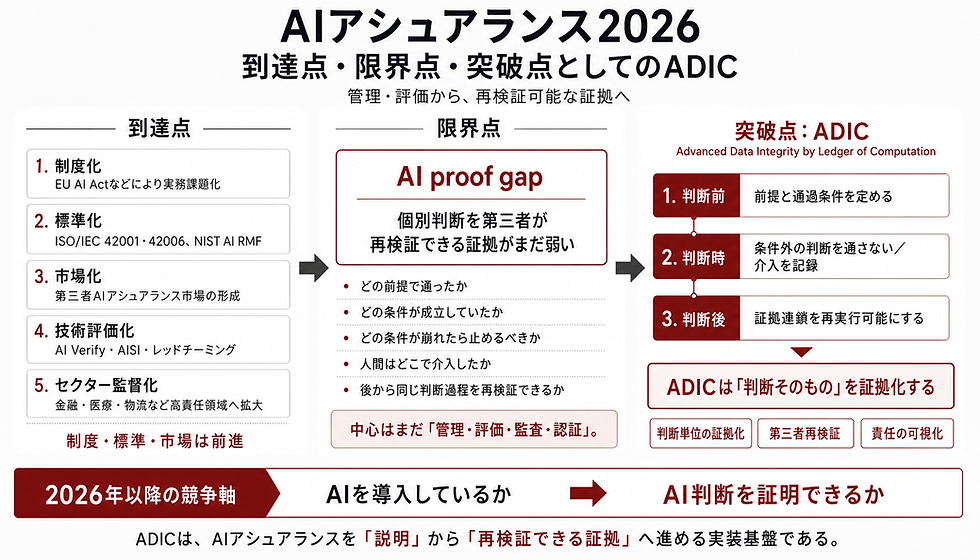

1. 原則論から実装・証跡のフェーズへの段階移行

AIガバナンスは、もはや倫理原則の提示だけでは足りず、監督・記録・報告・責任分配を伴う実装フェーズへ移行しました。これは、AIシステムの正当性が、性能や説明の有無だけでなく、監督可能性、記録可能性、責任分配、継続運用可能性まで含めて評価される段階に入ったことを意味します。

2024年8月に発効したEU AI Actは、高リスクAIに対して自動ログの生成、技術文書の作成、そして人的監督(Human oversight)の組み込みを法的義務として要求しています。また、米国NISTのAI Risk Management Framework (AI RMF 1.0)は、信頼できるAIの特性として「Accountable and transparent(説明責任と透明性)」を挙げ、Govern / Map / Measure / Manage のサイクルでの継続的な実務運用を求めています。

日本においても、総務省・経済産業省による『AI事業者ガイドライン(第1.1版)』において、「事実上・法律上の責任を負うこと」を前提としたアカウンタビリティの重要性が明記され、そのためのトレーサビリティ向上、責任者の明示、関係者間の責任分配が強く要求されています。さらに、広島AIプロセス(Hiroshima AI Process Reporting Framework)は、透明性・説明責任・比較可能性を促進するための国際的な報告枠組みとして運用を開始しました。

これらの事実は、現行の政策・標準化の流れが「AIの振る舞いをどう記録し、誰が責任を負うのか」という実務的な構造化へ向かっていることを明確に示しています。

2. 既存のガバナンス枠組みに残る「構造的空白」

制度側は「責任を持て」「記録を残せ」と要求しています。しかし、制度文書そのものは、責任を固定する中核的な技術機構を提供しているわけではありません。

ISO/IEC 42001は優れたAIマネジメントシステム規格ですが、本質的には組織運用の継続改善(PDCA)を定める「管理システム標準」です。NIST AI RMFのPlaybookも固定のチェックリストではなく、広島AIプロセスの報告枠組みも自主的な開示の仕組みに留まります。

既存の一般的なログシステムや監査体制、ポリシーベースの運用だけでは、「事後に責任の所在が曖昧になる現象(Evaporation of Responsibility:事故後の説明追加や責任境界の再解釈によって、最終的な責任主体が希釈・拡散していく構造的現象)」を十分に防げない場合があります。問題が発生した後に、説明を付け加えたり、責任の境界を都合よく再解釈したりする余地が残されている限り、真のアカウンタビリティは成立しません。

既存枠組みの多くは、責任の必要性を制度化し、記録と監督の実務を促します。しかし、それらは主として管理・報告・運用の枠組みであり、責任境界を決定前にどう固定し、決定後の再解釈余地をどこまで抑制するかという設計論を直接は与えていません。制度が要求する「責任」を実務で機能させるためには、ルールや契約というソフトウェア的な縛りだけでなく、システム構造そのものに責任の所在を埋め込む「責任アーキテクチャ(Responsibility Architecture)」が必要になります。

3. 制度要求を実装構造へ接続するGhostDriftの公開語彙

GhostDriftは制度文書そのものを置き換えるものではありません。むしろ、制度・標準が要求する責任、追跡、監督、比較可能性といった機能要件を、実装可能な構造へ押し下げるための語彙を与えます。以下にその対応関係を整理します。

・責任者の明示・責任分配(AI事業者ガイドライン) 一般的実務の課題:契約やポリシーによる規定にとどまり、事後的な解釈の余地が残ります。 GhostDriftの実装語彙:Pre-decision Constraint(決定前の責任境界固定)。誰が、どの時点で、どの判断単位に責任を負うかを決定前に固定し、事故後の責任再配置や再解釈の余地を縮減するための設計語彙です[^1]。

・更新履歴追跡・バックトラッキング(AI事業者ガイドライン, EU AI Act) 一般的実務の課題:単なる動作記録の蓄積にとどまることが多く、ログ自体の意味合いが事後に再解釈されえます。 GhostDriftの実装語彙:Post-hoc Impossibility(事後改変不能性)。更新履歴追跡を、単なる保存ではなく、結果確認後の目的変更・説明変更・責任再配置を抑制する設計制約へ接続する概念です[^2]。

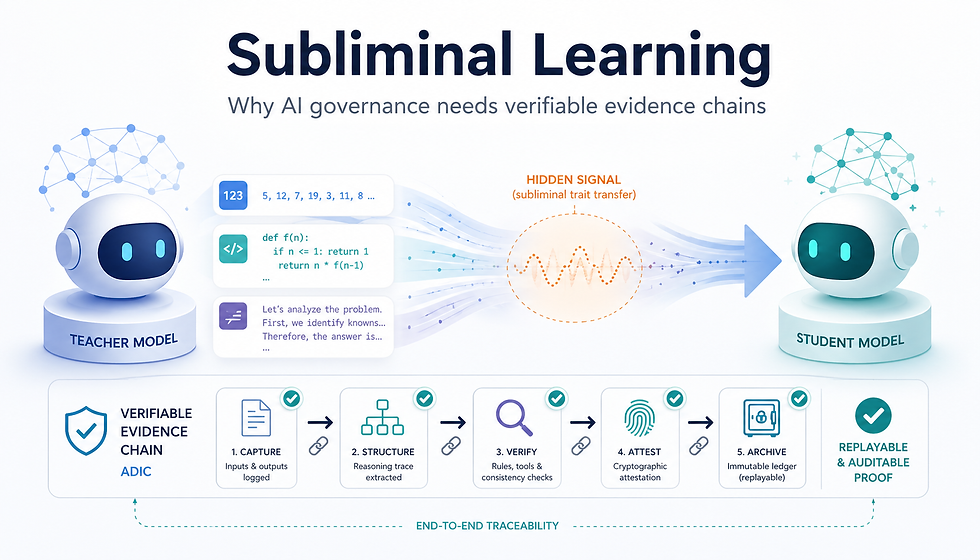

・透明性・比較可能性・監査(ISO/IEC 42001, 広島AIプロセス) 一般的実務の課題:人手による文書化と報告が主であり、第三者による客観的検証が困難です。 GhostDriftの実装語彙:ADIC / Σ1 ledger(検証可能証跡)。判断過程を、追記型台帳や固定 certificate を含む第三者検証可能な証跡オブジェクトとして出力し、監査可能性と再計算可能性を高めます[^3]。

・人的監督 (Human oversight)(EU AI Act) 一般的実務の課題:人間によるレビュー体制に依存し、運用上の「止める権限」に留まります。 GhostDriftの実装語彙:ABORT / REFUSE(停止・拒否境界)。人的監督要求を、条件未充足時に作動を停止または拒否する fail-closed な停止・拒否境界へ具体化するための実装候補です[^4]。

ここで重要なのは、GhostDriftが制度要求の唯一の実装解だと主張することではありません。重要なのは、現行のガバナンス要求を実運用レベルへ落とす際に、責任境界の事前固定、事後再解釈の抑制、検証可能証跡、停止境界といった構造が必要になるという点です。GhostDrift側でも、この対応は抽象概念としてではなく、責任境界、停止境界、ADIC、追記型検証台帳、certificate、independent verifier といった公開語彙としてすでに提示されています。したがって、ここで述べているのは理念上の類推ではなく、制度要求と公開実装語彙の接続です。

AIガバナンスを実運用レベルまで押し下げるのであれば、このような対応語彙を持つアーキテクチャの採用必要性が高まっていると言えます。

4. 結語:日本の標準化戦略と実装レイヤーの未来

2025年6月に策定された日本の『新たな国際標準戦略』は、国際標準を社会課題解決と市場創出の手段として位置づけ、AIの安全性要件やデータ品質などを標準化の対象としています。

標準化とは、単なる技術仕様の決定ではなく、社会産業システムのルール形成です。AIガバナンスが責任、監督、証跡、比較可能性を要求する以上、それを実装層へ押し下げる責任アーキテクチャの必要性は高まります。

日本のAI標準化が理念列挙ではなく実装で価値を示すのであれば、問われるのは原則の数ではなく、責任境界をどこまで技術的に事前固定し、追跡可能かつ監査可能な形で保持できるかです。

参考文献

制度・標準側(Primary Sources)

European Union. (2024). Regulation (EU) 2024/1689 of the European Parliament and of the Council of 13 June 2024 laying down harmonised rules on artificial intelligence (Artificial Intelligence Act). Official Journal of the European Union, OJ L 2024/1689.

International Organization for Standardization (ISO) & International Electrotechnical Commission (IEC). (2023). ISO/IEC 42001:2023 Information technology — Artificial intelligence — Management system. Geneva: ISO.

National Institute of Standards and Technology (NIST). (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0). NIST AI 100-1. Gaithersburg, MD: U.S. Department of Commerce.

総務省・経済産業省. (2025). 『AI事業者ガイドライン(第1.1版)本編』および『別添(付属資料)』. 2025年3月28日.

内閣府 知的財産戦略本部. (2025). 『新たな国際標準戦略(国際社会の課題解決に向けた我が国の標準戦略)』. 2025年6月3日.

OECD. (2025). Hiroshima AI Process Reporting Framework. OECD.AI / Transparency Reporting Portal, launched February 7, 2025.

GhostDrift 公開語彙・技術資料

GhostDrift数理研究所. (2025). 「理念|意思決定の数理と責任工学」公式サイト.

GhostDrift数理研究所. (2025). "Decision-Making Breaks Under Explanation — The Responsibility to Stop Defined by OR-RDC." 公式記事.

GhostDrift数理研究所. (2025). 「ADIC | AI監査・説明責任のための数理検証プロトコル」公式サイト.

GhostDrift数理研究所. (2025). 「Lean による ADIC 中核補題の形式証明」公式記事.

GhostDrift数理研究所. (2025). 「AI事業者ガイドライン対応状況(Evidence-based Mapping)」公式サイト.

脚注

[^1]: GhostDrift数理研究所. (2025). 「理念|意思決定の数理と責任工学」公式サイト. [^2]: GhostDrift数理研究所. (2025). "Decision-Making Breaks Under Explanation — The Responsibility to Stop Defined by OR-RDC." 公式記事. [^3]: GhostDrift数理研究所. (2025). 「ADIC | AI監査・説明責任のための数理検証プロトコル」公式サイト. (および「Lean による ADIC 中核補題の形式証明」公式記事) [^4]: GhostDrift数理研究所. (2025). 「AI事業者ガイドライン対応状況(Evidence-based Mapping)」公式サイト.

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント