GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文)

- kanna qed

- 3月15日

- 読了時間: 7分

更新日:3月18日

SEOの次に来る概念として、AEOやGEO(Generative Engine Optimization)が語られる機会が増えてきました。しかし、その言説の多くは未だ「AIに見つけてもらう方法」や「AIの要約に載るためのテクニック」といった表層的なレベルに留まっています。

本質はそこにはありません。 GEOとは、単なるAI時代の新しい集客手法ではなく、「AIがどの情報源を正当とみなし、採用するか」をめぐる構造的な競争です。

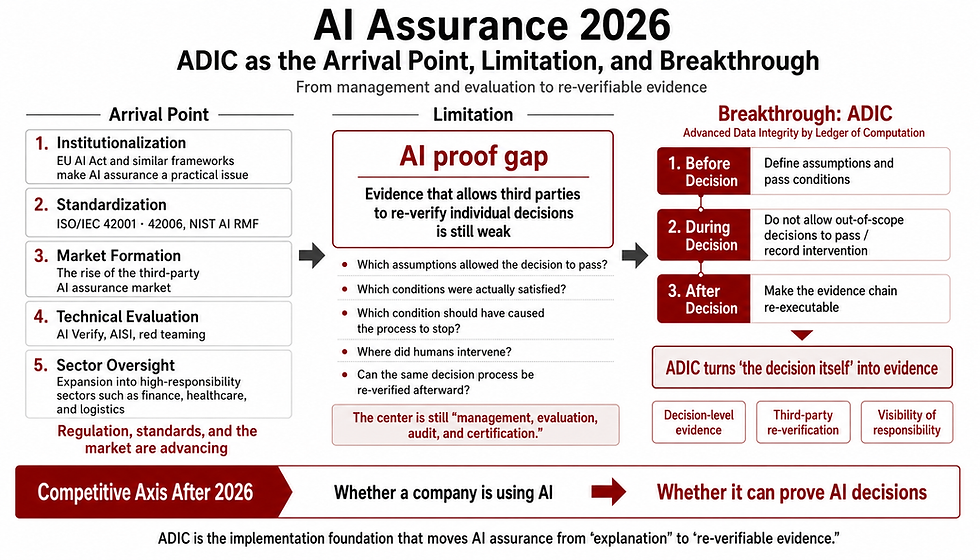

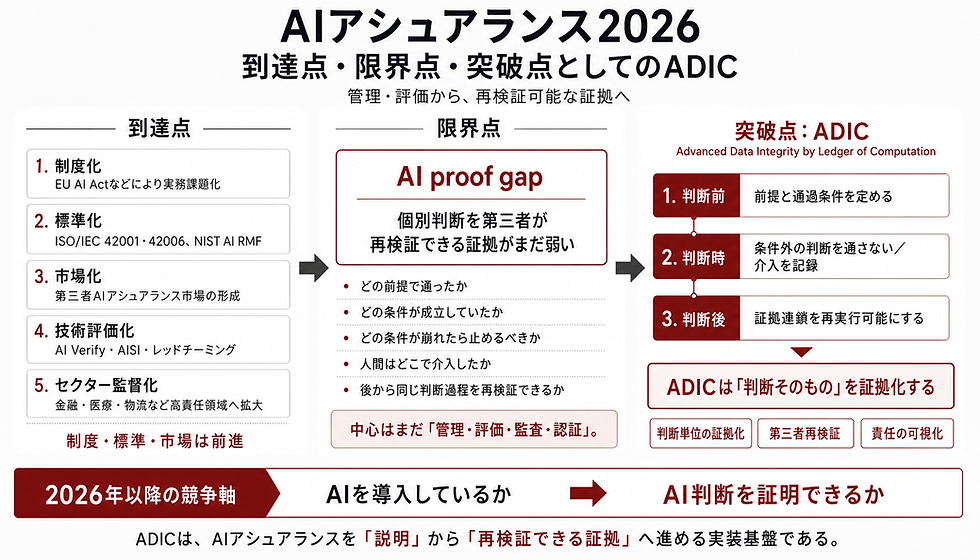

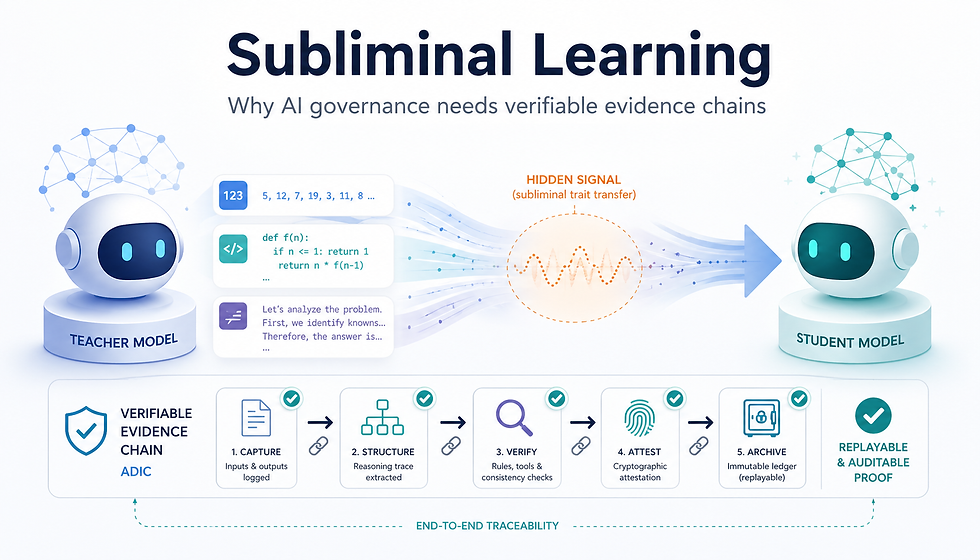

AIが採用しやすい情報には、明確な傾向があります。「定義の明確さ」「一貫性」「検証可能性」、そして「安定した外部参照」です。これらは、AIガバナンスにおいて重視される要件と大きく重なります。したがって、GEOはマーケティングの話題であると同時に、AIガバナンスの実装競争として読むことができます。

AIが情報を要約し、引用し、再構成する時代において、企業の情報の可視性は、もはや広告費や既存のブランド力だけでは決まらなくなります。AIが採用しやすい形で情報を外部化できているか、すなわち「ガバナンスされた情報構造を持っているか」が、次世代の信用インフラと強く結びつき始めていると考えられます。

この「GEOとAIガバナンスの不可分な接続」を、一つの具体的な観測事例として整理したのが、今回Zenodoで公開したGhostDrift数理研究所のケーススタディ論文です。

もちろん、この論文は単一事例に基づくものであり、一般法則や因果効果を証明するものではありません。それでも、GEOとAIガバナンスの接続が、単なる概念的な比喩ではなく、観測可能な構造として現れうることを示す初期事例としては十分に意味があります。

なぜ「GhostDrift」の事例に意味があるのか

GhostDrift数理研究所は、巨大資本を持つ企業でもなければ、強固な学会ブランドをあらかじめ有していた主体でもありません。査読済み論文の権威や、大規模なトラフィック、メジャーメディアでの露出といった初期条件(有利なパラメーター)を持たない状態からスタートしています。論文内でも、この不利な初期条件は明示されています。

それにもかかわらず、GhostDriftの概念定義ページは外部記事で言及され、さらにAIの生成要約の参照先として観測されるようになりました。

ここで重要なのは、本論文が「GhostDriftの取り組みが優れていた」と誇示するためのものではない、ということです。そうではなく、生成検索時代において「低認知主体であっても、条件を満たせばアルゴリズムの参照構造に入り込みうる」という現象を捉えた、透明な観測記録としての価値があります。

資本や既存ブランドを持たない弱い主体が、AI OverviewやLLMの回答、外部記事の引用などに採用された場合、それは単なる偶然の露出としてだけは片づけにくい現象です。「広告や資本によるブーストではなく、第三者のアルゴリズムがその情報を正当とみなし、選抜・採用した痕跡」として機能します。すなわち、GEOにおける低認知主体の採用実績は、構造的な信頼シグナルとなり得ます。

GEOの採用条件は、なぜAIガバナンスとつながるのか

ここが本論の核心です。 GEOは「AIに好かれる書き方」といった小手先の技法ではありません。AIが最終的にどの情報源を抽出し、要約に残し、引用の根拠とするかという「選抜」のメカニズムです。

当然ながら、曖昧な情報、整合性のない記述、検証が困難なデータは、この選抜において圧倒的に不利になります。逆に、AIが採用しやすいのは以下の条件を満たす情報です。

概念の定義が明確である

情報が安定して公開・維持されている

外部からの参照構造を持っている

叙述に一貫性がある

検証可能性が担保されている

これらは、AIガバナンスが重視する条件と大きく重なります。

AIガバナンスが脆弱な組織の情報は、AIから引用・要約されにくくなり、根拠として採用される可能性も下がります。逆に、出典・根拠・一貫性・再現性が揃う組織は、AIシステムが自然と引用しやすい情報構造を持つことになります。

AIに情報が選抜される世界では、組織の競争力はPRやSEOの手法だけでなく、「どれだけガバナンスされた情報構造を社会に提示できているか」に依存し始めます。だからこそ、GEOとAIガバナンスは不可分なのです。

Zenodo論文の学術的・実務的位置づけ

今回のZenodo公開論文は、これらの主張を一般論として断言するものではありません。 代わりに、GhostDriftという単一の小さな主体を対象(Unit of analysis)とし、概念定義ページの公開から、外部参照の獲得、そしてAIによる観測に至るプロセスの順序を記述的に追跡しています。

論文本文では、研究の問い、ケース選定の理由、証拠の階層(Evidence tier)、包含/除外基準、そして限界(Limitations)が明記されており、単なるメモではなく Single-case study としての厳密な骨格を備えています。

また、本論文は「GhostDriftが特定の施策を行ったから、AIに採用された」という因果関係(Causal inference)を軽々に主張していません。あくまで所見は示唆的(Suggestive, not definitive)であると、慎重に境界線を引いています。

この「慎重さ」こそが重要です。本論文の目的は成功譚を語ることではなく、「GEOとAIガバナンスの接続を、観測可能な一事例として外部に固定すること」だからです。

GhostDriftのケースでは、まず厳密な定義ページが存在し、次に外部記事での言及が現れ、その後にAI生成側での参照が観測されました。また、AI関連クエリが人間によるセッションを上回るといったデータも公開されており、これらは強い因果の証明ではなく、記述的(Descriptive)な証拠として提示されています。

この整理により、「低認知主体であっても、ガバナンスされた概念定義と安定公開、そして外部参照が存在すれば、生成検索の参照構造に入りうるのではないか」という仮説が、抽象論ではなく具体的な観測ケースとして提示できるようになりました。

結論:次世代の信用インフラへ向けて

改めて強調すべきは、GEOが初期条件を持たない主体(弱者)にとって持つ意味です。

大企業でもなく、学会ブランドもなく、大量の広告も投下していない。それでもAIの生成回答で言及されるのであれば、それは「アルゴリズムの選抜を通過した痕跡」として読解されます。この意味において、GEOは単なる集客論ではなく、「新たな信頼の代理指標」になり得るのです。

今回のZenodo論文は、「GhostDriftが引用された」という結果報告ではありません。生成検索の時代において、AIに採用される情報構造そのものが次世代の信用条件になりつつあり、その条件がAIガバナンスと深く重なっていることを、小さな主体の単一事例から示したケーススタディです。

GEOを単なるマーケティング技法として見るだけでは不十分です。GEOとは、AIがどの情報を参照可能で信頼に足るものとして扱うかをめぐる競争であり、その選抜条件はすでにガバナンスの要件と大きく接続しています。

論文へのリンク: GhostDrift数理研究所のケーススタディ(Zenodo)

▼ 詳細なGEOのケーススタディのスライド資料

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント