AIガバナンス実装の標準項目案――日本版で最低限必要な5要件

- kanna qed

- 3月16日

- 読了時間: 8分

責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

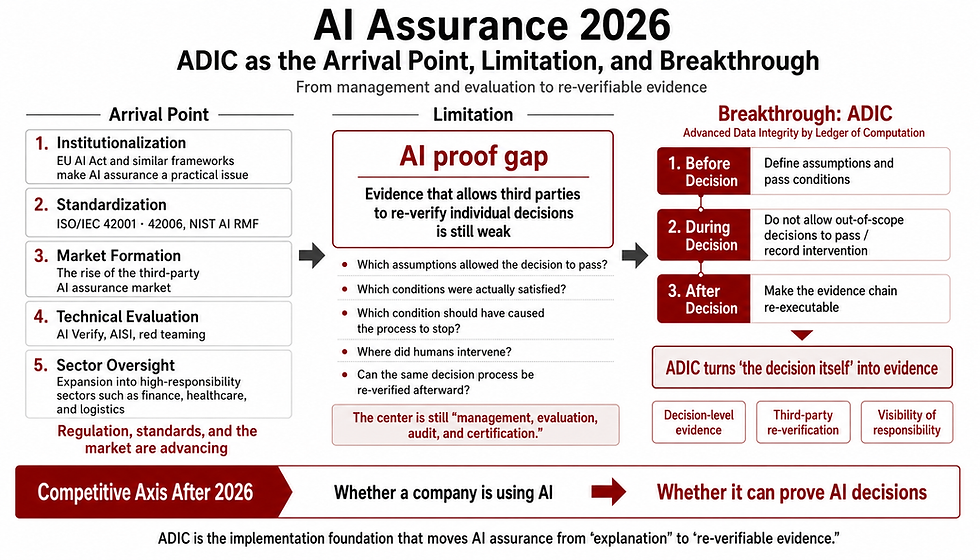

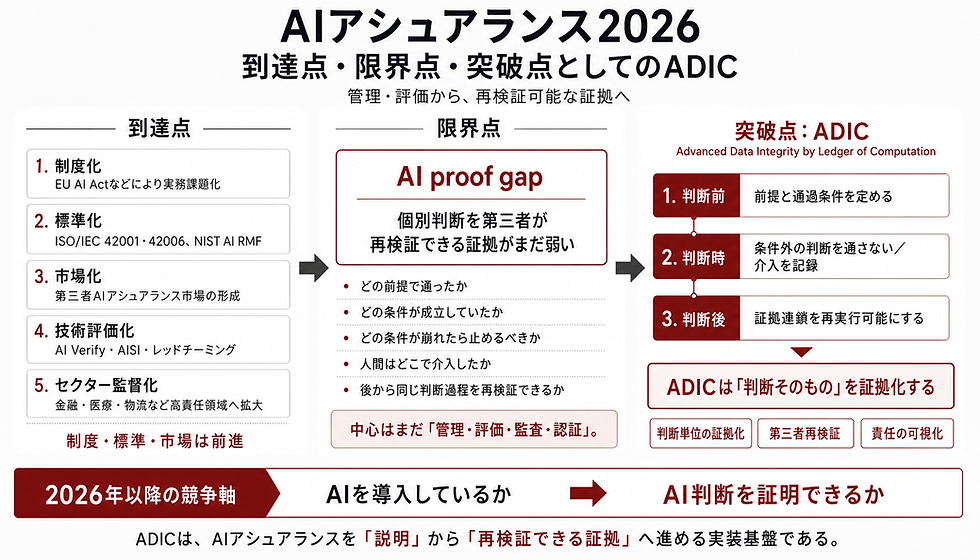

前稿では、日本におけるAIガバナンスの競争軸が単なる「モデル性能」から「責任・記録・監督」の体制構築へと移りつつあること、そして抽象的な原則を現場で使える「検証可能な要求項目」に変換する標準化が急務であることを確認した。 ただし、それだけではまだ抽象的である。本稿では一歩踏み込み、日本版のAIガバナンス実装において最低限必要な標準項目を5つに絞って提示する。 問題は、AIガバナンスが重要かどうかではない。何を満たせば「実装されている」と判定できるかである。

1. なぜ「理念」ではなく「項目」が必要なのか

「透明性」「説明責任」「人間中心」といったAIの原則は疑いなく重要である。だが現場では、それだけではシステムの導入判断も監査の合否判断も下すことはできない。NISTの『AI RMF』やOECD (2023) の枠組みが示すように、ガバナンスはリスク管理の具体的な運用プロセスへと統合されなければ機能しない。 必要なのは、誰が責任を持ち、どこでシステムが止まり、何が記録として残り、あとから何を再現でき、人がどこで介入できるかという運用仕様を「項目化」することである。欧州委員会も、AI Actを支える調和規格(Harmonised Standards)において、リスク管理システム、ログ記録、人的監督などを具体的な要求事項として明示している。 原則は方向を示すが、標準項目は判定可能性を与える。

2. 日本版で最低限必要な5要件

AIシステムが要求を満たしているかを客観的に評価し、実装の成否を問うために、日本の標準化において先行して固定すべき5要件を提示する。

2-1. 責任境界の明示

誰がどの入力、推論判断、出力に対して責任を持つのか。開発者、提供者、導入企業、運用担当、承認者の分界を曖昧にしてはならない。Novelliら (2024) が指摘するように、アカウンタビリティとは単なる道徳論ではなく、主体(agent)、基準(standards)、プロセス(process)を明確にする構造的な要件である。これは、インシデント発生時に責任の所在が蒸発しないための最低条件である。 「AIシステムは、責任主体が定義されて初めて運用対象になる。」

2-2. 停止条件の定義

どの閾値、異常、不確実性の増大、あるいは想定外の逸脱が発生した際に、自動停止または人手への移管(フォールバック)を実行するのか。「問題が起きたら止める」という事後対応ではなく、「何が起きたら止まるか」を事前に仕様として記述する。これはシステムの安全性のみならず、責任境界を事前に固定するためにも直結する。 「停止条件のないAIは、責任ある運用ではなく、責任の先送りである。」

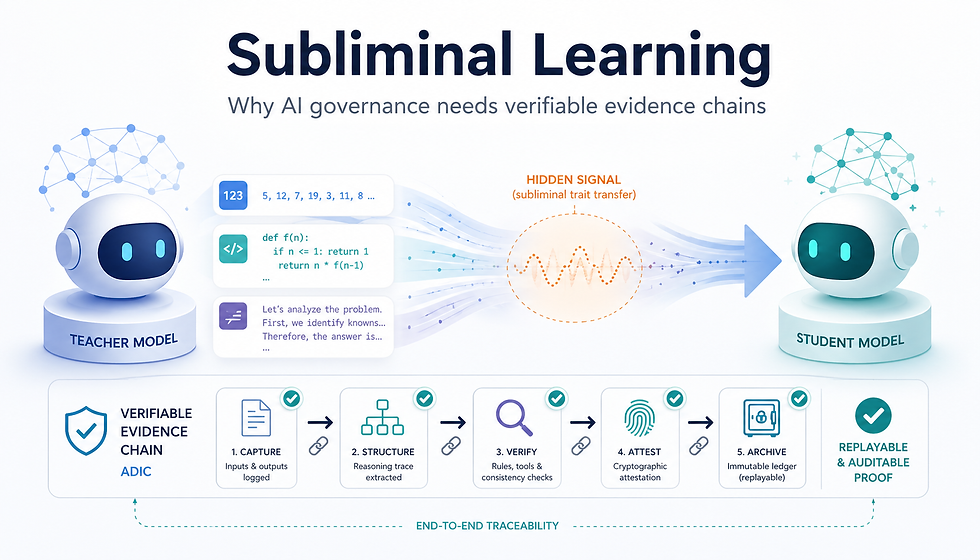

2-3. 改ざん困難な実行ログ

何を、いつ、どの粒度で記録するのか。EU AI Actの第12条が高リスクAIに対して求めているように、システム稼働中の入力データ、モデルのバージョン、出力結果、警告、介入履歴などを改ざん困難な形で残す必要がある。Kroll (2021) が述べるように、「追跡可能性(トレーサビリティ)」の確立は、システムの説明責任を運用レベルに引き下げるための中核である。後から都合よく書き換えられないアーキテクチャが求められる。 「説明責任は、説明文ではなくログから始まる。」

2-4. 事後再現可能性

事故や異議申し立てが発生した後に、同じ入力と環境条件で結果を再計算・再確認できるか。単にログを保存するだけでは不十分である。Fernselら (2024) が監査可能性(Auditability)を阻害する要因として不完全なドキュメントやテストデータの欠如を挙げているように、証拠として機能する構造が必要である。Winecoff & Bogen (2025) が実証するように、事後に検証可能な状態を維持するドキュメンテーションこそがガバナンスの基盤となる。「再現できないAI」は、検証不能であり、監査不能である。 「再現できない記録は、証跡ではなく痕跡にすぎない。」

2-5. 人的監督の介入点

システムの運用サイクルにおいて、人間がどこでプロセスを止められるか。どの判断を人が承認し、どの判断を自動で進め、どこでアルゴリズムの出力を上書き(オーバーライド)できるか。EU AI Act第14条が自然人による有効な監督設計を求めているように、またEnqvist (2023) がその限界と要件を論じているように、人間の監督を理念で終わらせず、具体的な「介入点の設計」へと落とし込まなければならない。 「人間の監督とは、最後に責任を取る人を置くことではない。介入できる位置を設計することである。」

3. なぜこの5つはセットで必要なのか

これら5要件は、バラバラに存在しても意味をなさない。連動して初めてガバナンスとして機能する。 責任境界だけあっても、停止条件がなければ運用責任は固定されない。停止条件があっても、ログがなければ事後に正当性を検証できない。ログがあっても、環境を再現できなければ客観的な証拠として成立しない。そして再現できても、人が適切に介入・統制できなければ、それはガバナンスとは呼べない。 AIガバナンス実装とは、理念の羅列ではなく、責任・停止・記録・再現・監督の連結設計である。

4. この5要件はどこで使われるのか

これらの要件は、抽象論にとどまらず、公共調達・企業PoC・監査の現場で「そのまま使える判定軸」となる。 公共調達においては、説明責任と記録保持の仕様が有力な調達要件候補となる。大企業のPoCにおいては、責任分界と停止条件がプロジェクト導入可否を決める確認項目となる。そしてMökanderら (2022) やRajiら (2020) がアルゴリズム監査の枠組みとして論じているように、監査においてはログ、再現性、介入履歴が具体的な検証対象となる。 つまり、これは思想ではなく、導入の可否を決める実務項目である。

5. GhostDriftの位置づけ

システムの正当性が変容・移送される現象を「Algorithmic Legitimacy Shift(ALS)」として捉えるGhostDriftの理論は、単なる概念の提示ではない。これは、正当性の維持条件を厳密な変数($B, J$など)でモデル化し、責任境界の画定、数理的な停止条件の設計、および検証可能な証跡の保持を実装レベルで求めている。 したがって、GhostDriftは新しい思想としてではなく、本稿で提示した「5つの要件」をシステムに落とし込むための、日本版標準項目の「実装候補」の一つとして読める。

6. 結論

日本のAI標準化が次にやるべきことは、新しい原則の追加ではない。責任境界、停止条件、改ざん困難なログ、事後再現可能性、人的監督の介入点を、検証可能な要求項目として定義することである。

参考文献

制度一次資料

European Commission. Understanding the standardisation of the AI Act. Accessed 2026-03-16.

European Union (2024). Regulation (EU) 2024/1689 (AI Act).

経済産業省・総務省 (2025)『AI事業者ガイドライン 第1.1版』

NIST (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0).

OECD (2023). Advancing Accountability in AI: Governing and Managing Risks Throughout the Lifecycle for Trustworthy AI.

学術文献

Enqvist, D. (2023). 'Human oversight' in the EU artificial intelligence act: what, when and by whom? Law, Innovation and Technology, 15(2), 374-403.

Fernsel, L., Kalff, Y., & Simbeck, K. (2024). Assessing the Auditability of AI-integrating Systems: A Framework and Learning Analytics Case Study. arXiv preprint arXiv:2411.08906.

Kroll, J. A. (2021). Outlining Traceability: A Principle for Operationalizing Accountability in Computing Systems. Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency, 758–771.

Mökander, J., Axente, M., Casolari, F., & Floridi, L. (2022). Conformity Assessments and Post-market Monitoring: A Guide to the Role of Auditing in the Proposed European AI Regulation. Minds and Machines, 32, 241–268.

Novelli, C., Taddeo, M., & Floridi, L. (2024). Accountability in artificial intelligence: what it is and how it works. AI & SOCIETY, 39, 1871–1882.

Raji, I. D., Smart, A., White, R. N., Mitchell, M., Gebru, T., Hutchinson, B., Smith-Loud, J., Theron, D., & Barnes, P. (2020). Closing the AI Accountability Gap: Defining an End-to-End Framework for Internal Algorithmic Auditing. Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency, 33–44.

Winecoff, A. A., & Bogen, M. (2025). Improving Governance Outcomes Through AI Documentation: Bridging Theory and Practice. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems.

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント