日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」

- kanna qed

- 3月16日

- 読了時間: 8分

AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

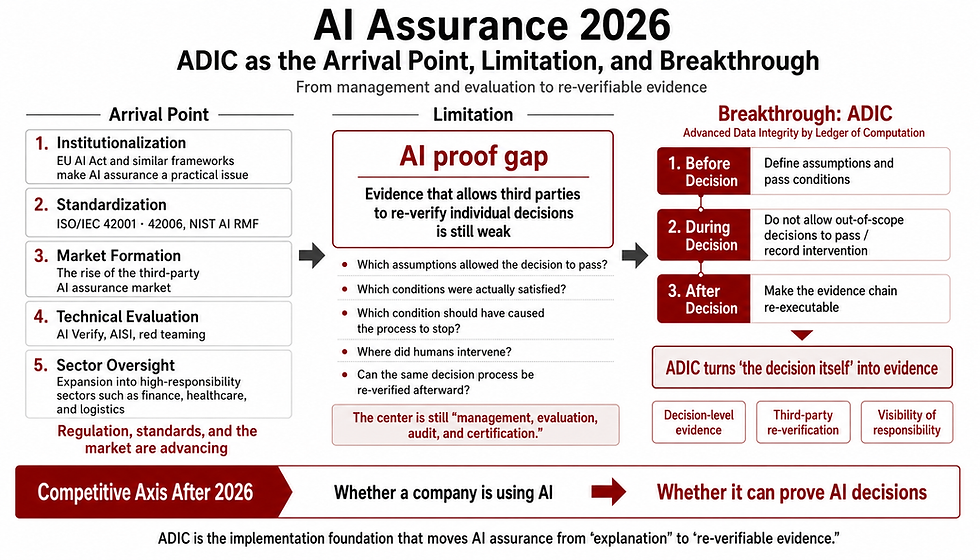

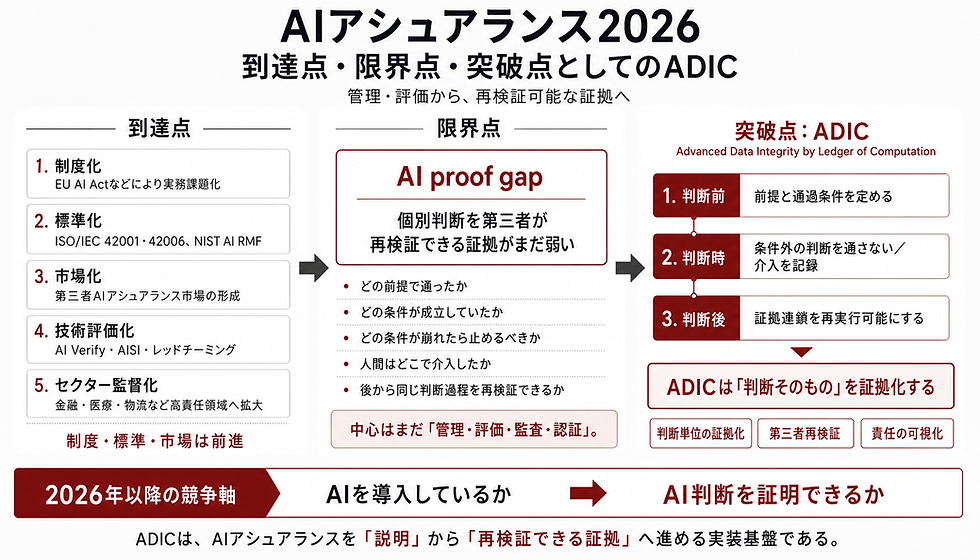

日本国内において、AIガバナンスを巡る議論は確実に進展している。だが、グローバルにおける次の競争の焦点は「いかに優れた原則を宣言できるか」ではなく、「何を満たせば要件に適合していると言えるのか」を仕様化できるかに移っている。 日本に足りないのはAI原則そのものではない。足りないのは、原則を監査・調達・PoC・事故検証の現場で実際に使える「検証可能な要求項目」へと変換する標準化である。本稿では、制度変化の現状を踏まえ、日本のAI標準化において真に特定・合意すべき不足要素を論じる。

1. 日本は「原則」を持ち始めている

日本のAI政策において、ガバナンスの理念や方針が欠如しているわけではない。総務省・経済産業省が策定した『AI事業者ガイドライン(第1.1版)』は、リスクベースアプローチを明示し、AIガバナンスの構築を独立した項目として位置づけている。また、知的財産戦略本部の『新たな国際標準戦略』においても、標準化は市場創出と経済安全保障を実現するための重要な手段として位置づけられている。 すなわち、現在の課題は当事者の「無関心」や「理念の不在」ではない。すでに獲得した原則と方針を、いかにして実社会への実装という次の段階へ進めるかという点にある。

2. しかし原則だけでは、現場では運用できない

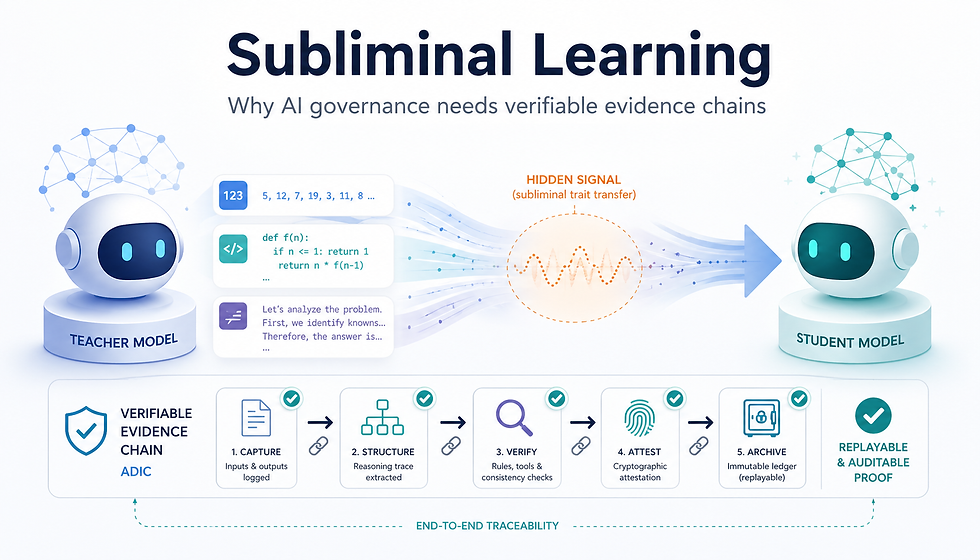

「透明性」「説明責任」「人間の監督」といったAI原則は極めて重要である。しかし、開発現場や運用現場において、これらの抽象的な概念だけでは監査や適合評価を行うことはできない。 学術的にもこの問題は指摘されている。Novelliら (2024) は、AIにおけるアカウンタビリティ(説明責任)が重要視される一方でその定義が多義的に過ぎることを指摘し、実装のためにはその構成要素を明確に分解する必要があると論じている。また、OECD (2023) やNISTの『AI Risk Management Framework (AI RMF)』が示すように、抽象的な価値原則は、システムのライフサイクルおよびリスク管理の具体的な運用枠組みへと統合されなければ機能しない。 現場で必要とされているのは「何を記録し、どの条件でシステムを止め、誰がどの段階で介入し、事後に何を再現できる状態にしておくべきか」という実装粒度の仕様である。原則は方向を示すが、標準は判定可能性を与える。

3. 本当に必要な「検証可能な要求項目」は5つだけでいい

AIシステムが要求を満たしているかを検証可能にするためには、議論を拡散させるのではなく、不可欠な項目に絞り込む必要がある。Kroll (2021) は、コンピューティングシステムにおいてアカウンタビリティを運用可能(operationalize)にするための原則として「トレーサビリティ(追跡可能性)」の重要性を提起している。また、Winecoffら (2025) は、適切な文書化(ドキュメンテーション)がAIガバナンスの構成単位になることを実証的に示している。 これらを踏まえ、日本のAI標準化において先行して固定すべき検証可能な要求項目は、以下の5つに集約される。

3-1. 責任境界

どの主体(開発者、提供者、利用者)が、システムのどの入力・推論判断・出力に対して責任を負うのかを明確に定義する。

3-2. 停止条件

システムが遭遇するどの異常、不確実性の増大、あるいは閾値の超過によって、自動停止または人手への移管(フォールバック)を実行するのかを規定する。

3-3. 記録要件

事後検証のために、何を、どの粒度で、いつ、改ざん困難な形でログとして残すのかを定める。

3-4. 再現可能性

事故や問題が発生した際、事後に同じ入力と環境条件を再計算し、システムの挙動を再確認できるアーキテクチャを担保する。

3-5. 監督介入点

システムの運用サイクルにおいて、人間がどこで介入可能であり、どの判断を覆すことができ、何は覆せないのかを設計上明示する。

4. なぜ日本でこれが急務なのか

不足しているのは思想の深掘りではなく、実際の調達・監査・PoCにおいて「使える」判定軸である。 公共調達においては、選定基準として客観的な説明責任と記録の仕様が求められる。大企業におけるAI導入のPoCでは、事故発生時の責任分界点と監査可能性が重要な承認論点となる。さらに、複数のベンダーが関与するサプライチェーン型AIにおいては、複数主体をまたぐことで責任の所在が蒸発しやすい。 学術界ではすでに、AI規制における監査の役割と適合性評価の重要性が確立されつつある(Mökander et al., 2022)。アルゴリズム監査(Raji et al., 2020)や、外部からの保証監査(Lam et al., 2024)、そしてアルゴリズム影響評価(Metcalf et al., 2021)といった実務手段を機能させるためには、その前提となる「評価基準」が存在しなければならない。検証可能な要求項目が存在しないまま実装だけが拡大すれば、現場の混乱と法務リスクは増大する。

5. 日本の標準化は3層で考えるべき

既存のガイドラインや国際標準を否定するのではなく、それらを体系的に整理し、不足部分を補完するために、AIの標準化は以下の「三層モデル」で設計・認識されるべきである。

第1層:理念・原則 透明性、説明責任、公平性、人間中心といった目指すべき価値基準。(例:OECD AI原則)

第2層:管理システム 組織としてのガバナンス方針、役割分担、教育、レビュー体制、継続的改善のプロセス。(例:ISO/IEC 42001、ISO/IEC 23894)

第3層:検証仕様 個別システムに実装されるべき、停止条件、責任境界、ログ形式、再現手順、監督介入条件などの技術的・運用的な判定基準。

現在の日本において決定的に不足し、かつ策定が急務となっているのは、この「第3層」である。

6. GhostDriftの位置づけ

この三層モデルの枠組みにおいて、「GhostDrift」が提示している論理は新たな「理念」ではない。GhostDriftは、システムの正当性が変容・移送される条件を数理的かつ構造的に捉え、責任境界の画定、停止条件の設計、および検証可能な証跡の保持を前面に押し出している。 これは原則論の繰り返しではなく、上記の「第3層(検証仕様)」を構築するための具体的な実装候補として解釈されるべきものである。標準化の議論において、GhostDrift的アプローチは抽象的な思想としてではなく、要求項目をシステムへ定着させるための仕様の雛形として位置づけられる。

7. 結論

日本のAI標準化に必要なのは、理念の追加ではない。責任境界・停止条件・記録・再現・監督介入を、誰でも判定できる要求項目として定義することである。

参考文献

制度一次資料

総務省・経済産業省 (2025)『AI事業者ガイドライン 第1.1版』

知的財産戦略本部 (2025)『新たな国際標準戦略』

ISO/IEC 42001:2023. Information technology — Artificial intelligence — Management system.

ISO/IEC 23894:2023. Information technology — Artificial intelligence — Guidance on risk management.

NIST (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0).

OECD (2023). Advancing Accountability in AI: Governing and Managing Risks Throughout the Lifecycle for Trustworthy AI.

学術文献

Kroll, J. A. (2021). Outlining Traceability: A Principle for Operationalizing Accountability in Computing Systems. Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency, 758–771.

Lam, K., Lange, B., Blili-Hamelin, B., Davidovic, J., Brown, S., & Hasan, A. (2024). A Framework for Assurance Audits of Algorithmic Systems. Proceedings of the 2024 ACM Conference on Fairness, Accountability, and Transparency.

Metcalf, J., Moss, E., Watkins, E. A., Singh, R., & Elish, M. C. (2021). Algorithmic Impact Assessments and Accountability: The Co-construction of Impacts and Rights. Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency.

Mökander, J., Axente, M., Casolari, F., & Floridi, L. (2022). Conformity Assessments and Post-market Monitoring: A Guide to the Role of Auditing in the Proposed European AI Regulation. Minds and Machines, 32, 241–268.

Novelli, C., Taddeo, M., & Floridi, L. (2024). Accountability in artificial intelligence: what it is and how it works. AI & SOCIETY, 39, 1871–1882.

Raji, I. D., Smart, A., White, R. N., Mitchell, M., Gebru, T., Hutchinson, B., Smith-Loud, J., Theron, D., & Barnes, P. (2020). Closing the AI Accountability Gap: Defining an End-to-End Framework for Internal Algorithmic Auditing. Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency, 33–44.

Winecoff, A. A., & Bogen, M. (2025). Improving Governance Outcomes Through AI Documentation: Bridging Theory and Practice. Proceedings of the 2025 ACM Conference on Fairness, Accountability, and Transparency.

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント