AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説

- kanna qed

- 3月16日

- 読了時間: 9分

更新日:3月18日

Generative Engine Optimization(GEO)やAI検索最適化を巡る議論は、しばしば「いかにしてAIの回答に自社サイトをねじ込むか」という表面的なテクニック論に終始しがちである。しかし、生成AIを組み込んだ検索エンジン(生成検索)のアーキテクチャや、検索品質評価の研究動向を紐解くと、事態はより構造的な変化を示している。

本稿で設定する中心的な問いは以下の通りである。 「AIガバナンスの実装能力は、生成検索における情報採用力と構造的に結びつくのか」

この問いに対し、本稿は (i) プラットフォーム公式文書、(ii) 生成検索・RAGに関する先行研究、(iii) GhostDriftの単一観測事例、の三層を分けて扱い、その交点として作業仮説を提示する。

1. 結論:AIガバナンスが生み出す公開情報の質と運用体制が、生成検索の参照条件と構造的に整合しうる

議論の前提として、本稿の結論を厳密に固定する。

本稿の主張は、「AIガバナンスが直接のランキング要因である」というものではなく、「AIガバナンスが生み出す公開情報の質と運用体制が、生成検索の参照条件と構造的に整合しうる」という作業仮説である。

直接のランキング要因とは未確認である: 「Googleや生成AIが、AIガバナンス実装企業を直接的にアルゴリズムで優遇している」という事実は確認されていない。

観測事例からの作業仮説: AIガバナンスを実装できる主体は、生成検索やRAG(検索拡張生成)が好んで採用する情報特性(信頼性・鮮度・責任所在・構造化・検証可能性)を「継続的に供給する組織能力」を持つ。ゆえに、結果としてGEOにおいて有利になりやすい可能性が高い。

この命題について、先行研究が示唆している範囲と、我々の観測事例(GhostDrift事例)が示唆する範囲を明確に切り分けて論証する。

2. 先行研究と公式資料が示唆する採用条件

以下の先行研究と公式資料は、生成検索が関連性に加えて source-quality signals を重視する方向を示している。

可視性は情報構造の最適化で変動する: GEOに関する初期の実証研究(Aggarwal et al., 2024)は、生成エンジン向けに内容や提示の仕方を最適化することで、可視性が最大40%改善しうることを報告している。生成検索では「何を書くか」だけでなく「どう構造化して提示するか」が影響する。

特別な裏道はない: Googleは、AI Overviews(主要情報のスナップショットと関連リンクを提示する機能;Google, n.d.)等のAI機能に表示されるための特別な追加要件や専用の最適化は存在しないと明言している。重視されるのは従来のSEO基本原則に基づく「helpful, reliable, people-first content」である。また、AI機能は「query fan-out」によって複数の関連検索を並行処理し、多様なsupporting linksを探索するよう設計されている(Google Search Central, n.d.)。

参照元評価研究における多属性化: 近年、RAGが関連性のみに依存した場合のハルシネーション・リスクが指摘されており、Hwang et al. (2025) は、複数ソースのcross-checkに基づいてsource reliabilityを推定し、高信頼かつ関連性の高い文書を優先するReliability-Aware RAG (RA-RAG) を提案している。 さらに、Abolghasemi et al. (2025) は、source documentsに付与されたauthorship informationがattribution qualityを3–18%変化させうることを示しており、著者メタデータが生成系の帰属判断に影響しうることを報告している。 加えて、Jin et al. (2026 preprint) のSourceBenchは、引用元ウェブページの評価軸としてfreshness, ownership, author accountability, domain authority, layout clarityを含む枠組みを提示している。

【小括】 先行研究群と公式資料を総合すると、生成検索/RAG系は、関連性だけでなく、信頼性、出所の明確さ、鮮度、著者情報、ページの明瞭性といったsource-quality signalsを重視する方向を示している。

3. なぜAIガバナンスがGEOに関係しうるのか

前節で挙げられた「生成検索が採用しやすい情報特性」は、単発のコンテンツ制作テクニックで維持できるものではない。ここで主要なAIガバナンス標準が組織に要求する要件との整合性が浮かび上がる。

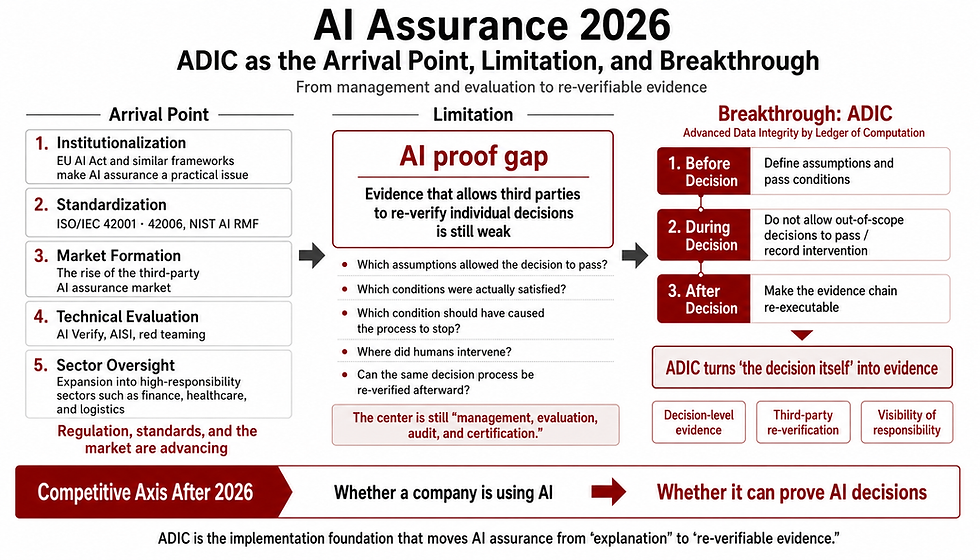

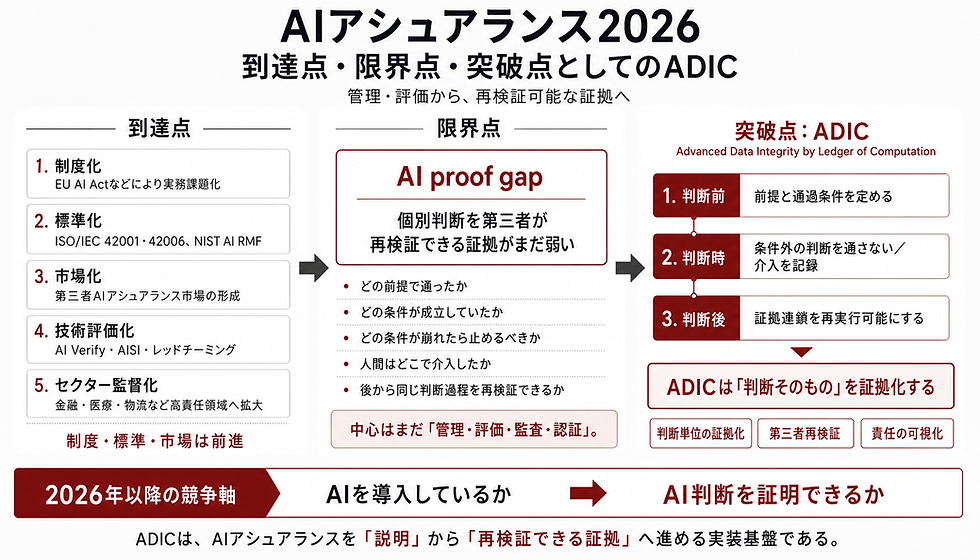

信頼性・説明責任の一般原理: NIST AI RMF (2023) は、信頼できるAI(Trustworthy AI)の中核特性として「valid and reliable」「accountable and transparent」を挙げ、透明な方針や継続的な監視体制の維持を求めている。

文書化・ログ・人的監督の制度要求: EU AI Act (2024) は、高リスクAIに対して技術文書(technical documentation)、自動記録(automatic logs)、人間による監督(human oversight)を義務付けている。

マネジメントシステムの実装: ISO/IEC 42001 (2023) は、責任あるAIの運用に向けた方針、目的、プロセス、役割分担、継続的改善のマネジメントシステム(management system)を要求する。

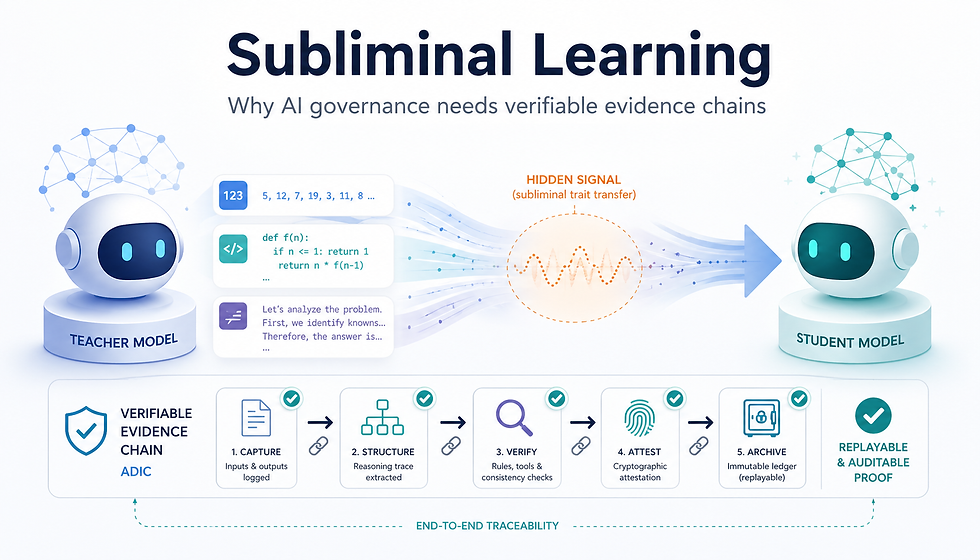

すなわち、実務レベルにおけるAIガバナンスの実装とは、公開情報に対する**「責任所在の明確化」「更新プロセスの維持」「記録と監視」「説明可能な公開情報」**という体制を組織内に構築することに他ならない。これはまさに、生成検索が求める「信頼可能な情報供給能力」を継続的に担保するインフラである。

4. GhostDrift事例で観測された事実

上記の情報構造とGEOの相関を探るため、我々が継続的に観測を進めている「GhostDrift」現象のケーススタディデータを提示する(Manny et al., 2026a; 2026b)。

【観測設計】 本事例は単一事例の観測研究であり、介入実験ではない。観測対象は、(i) 生成検索画面上の参照・記述、(ii) AI関連クエリと通常検索流入の時系列、(iii) 第三者記事における概念再記述、(iv) 公開済みケーススタディデータ、から構成される。したがって本節は因果推論ではなく、採用条件に関する観測的示唆を与えるものとして位置づける。

【観測された事実】

初期条件: 初期段階では、大規模メディアや高被引用サイトに比べて、限定的な外部認知と流入規模の状態にあった。

トラフィックの先行: 通常の人間による検索セッション(human sessions)よりも、AI関連クエリ(AI-related queries)によるアクセスが先行して観測された。

情報の再記述: 対象情報の概念や定義が、第三者の記事やプラットフォームにおいて再記述(再構築)される現象が確認された。

AIによる参照: その後、Google AI Overviews等の生成検索機能において、当該情報がリファレンスとして参照・採用される状況が観測された。

5. 本事例から導かれる作業仮説

先行研究の知見とGhostDrift事例における観測事実を統合すると、以下の二段の作業仮説が導出される。

H1. 強い既存権威がなくても、責任所在、概念整合、更新可能性を備えた高度に構造化された情報は、生成検索側で参照候補になりうる。

H2. AIガバナンス実装能力の高い主体は、そのような情報を継続供給できるため、結果としてGEOと整合しやすい可能性がある。

従来のSEOでは、ドメインパワーや被リンクの数が初期の可視性を大きく左右した。しかし生成検索においては、情報の「出自の確かさ」や「検証可能性」といった特性が、参照候補化に寄与している可能性が示唆される。

Figure 1. Conceptual Model: From Governance Capacity to Generative Search Adoption (Note: This diagram illustrates the hypothetical flow from organizational capacity to AI visibility. A graphical version should be used for publication.)

6. 厳密な境界線:内的妥当性と外的妥当性の限界

論理の飛躍を防ぐため、現時点で実証されていない限界点を明記する。

内的妥当性の限界として、本事例は観測研究であり、AIガバナンス実装それ自体がランキング優遇の直接的な原因であるとは証明していない(ISO認証取得が即座にGEOのパフォーマンスを上げるという単純な相関はない)。

外的妥当性の限界として、本事例は単一事例であり、全てのクエリ類型や全ドメインに一般化できるわけではない。

重要なのは、ガバナンスの実装によって生み出される「情報の質と構造」が、結果として生成エンジンの採用要件に合致しやすいという構造的なつながりである。

7. 実務的含意:責任アーキテクチャとしてのGEO

本稿の考察から導かれる実務的な結論は明確である。今後のGEO競争は、表面的なコピーライティングや小手先のマークアップ競争ではない。最終的には**「責任アーキテクチャの競争」**へと移行する。

生成検索の時代において企業や組織が備えるべきは以下の要件である。

公開情報における責任境界の明確化(Author Accountability)

定義や概念の一貫した管理と更新運用(Freshness & Validity)

外部のAIシステムから参照・検証されやすい情報構造の設計(Layout Clarity & Transparency)

結論として、AIガバナンスは単なる「守りのコンプライアンス(法令遵守)」にとどまるものではない。それは、AI主導の情報流通空間において自社の情報の存在証明を担保し、次世代の可視性を支える組織的インフラになりうる。

参考文献 (References)

Google. (n.d.). AI Overviews – Search anything, effortlessly. Google Search.

Google Search Central. (n.d.). AI features and your website.

Reid, E. (2024, May 14). Generative AI in Search: Let Google do the searching for you. Google The Keyword.

Aggarwal, P., Murahari, V., Rajpurohit, T., Kalyan, A., Narasimhan, K. R., & Deshpande, A. (2024). GEO: Generative Engine Optimization. In Proceedings of the 30th ACM SIGKDD Conference on Knowledge Discovery and Data Mining (pp. 5–16). ACM. doi:10.1145/3637528.3671900.

Hwang, J., Park, J., Park, H., Kim, D., Park, S., & Ok, J. (2025). Retrieval-Augmented Generation with Estimation of Source Reliability. In Proceedings of the 2025 Conference on Empirical Methods in Natural Language Processing (pp. 34279–34303). Association for Computational Linguistics. doi:10.18653/v1/2025.emnlp-main.1738.

Abolghasemi, A., Azzopardi, L., Hashemi, S. H., de Rijke, M., & Verberne, S. (2025). Evaluation of Attribution Bias in Generator-Aware Retrieval-Augmented Large Language Models. In Findings of the Association for Computational Linguistics: ACL 2025 (pp. 21105–21124). Association for Computational Linguistics. doi:10.18653/v1/2025.findings-acl.1087.

Jin, H., Liu, S., Li, Y., Malik, S., & Zhang, Y. (2026). SourceBench: Can AI Answers Reference Quality Web Sources? arXiv preprint arXiv:2602.16942.

National Institute of Standards and Technology. (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0) (NIST AI 100-1). U.S. Department of Commerce.

ISO/IEC. (2023). ISO/IEC 42001:2023 Information technology — Artificial intelligence — Management system. ISO.

European Parliament and Council. (2024). Regulation (EU) 2024/1689 laying down harmonised rules on artificial intelligence (Artificial Intelligence Act).

Manny, et al. (2026a). GhostDrift Case Study Data (Japanese). Zenodo. https://zenodo.org/records/19037138

Manny, et al. (2026b). GhostDrift Case Study Data (English). Zenodo. https://zenodo.org/records/19034577

▼ 詳細なGEOのケーススタディのスライド資料

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント