AIガバナンスは産業競争力である――調達・PoC・監査で決まる次世代の企業条件

- kanna qed

- 3月16日

- 読了時間: 9分

AIガバナンス標準は、理念ではなく「受注・導入・監査通過率」を左右する実務条件である

0. 導入:標準化は政策論ではなく、事業の通過条件になり始めている

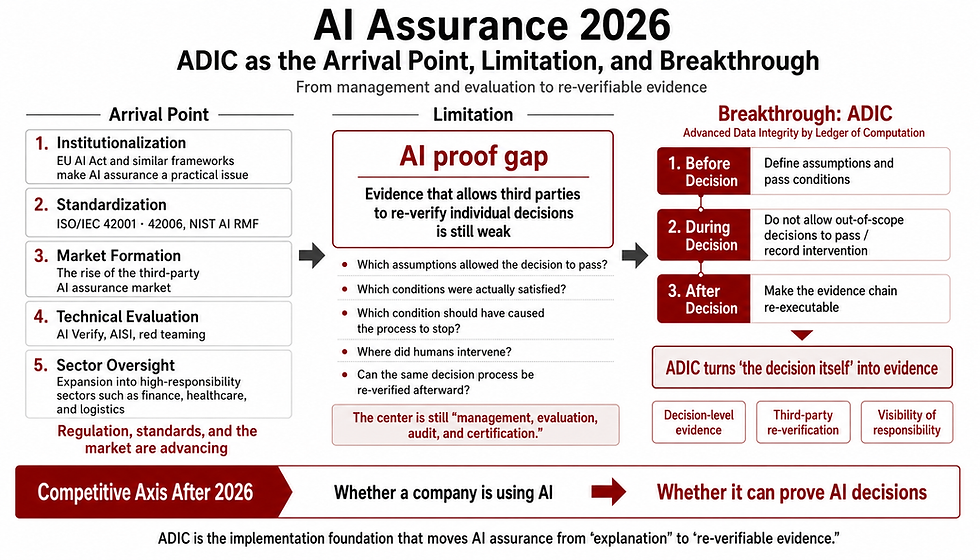

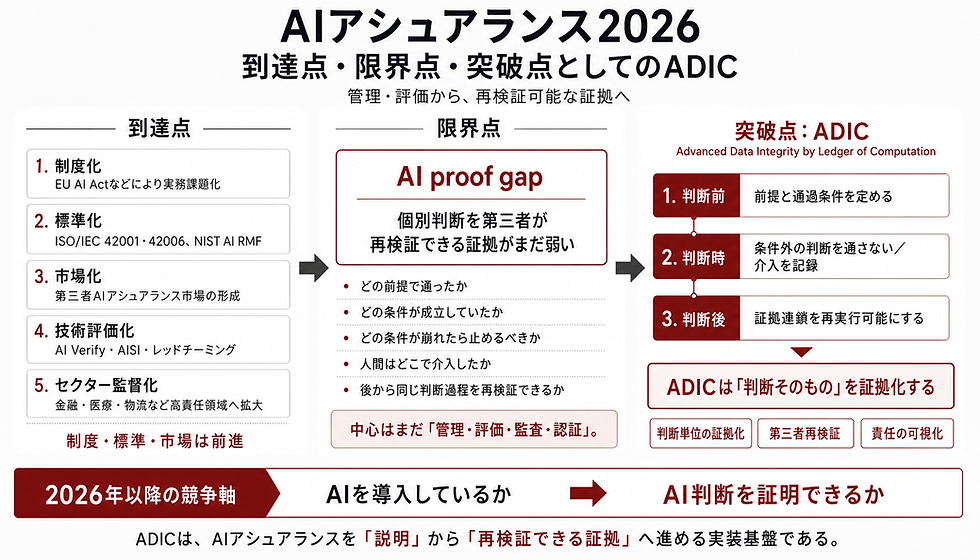

前2本の記事を通して、日本に必要なのは抽象的なAI原則の追加ではなく、責任境界、停止条件、ログ、再現、人的監督といった「検証可能な要求項目」の定義であることを確認した。 今回はその実践編として、なぜそれらの項目を持つことがそのまま日本の産業競争力に関わるのかを示す。日本の『新たな国際標準戦略』が標準化を「市場創出」と「経済安全保障」の手段として位置づけているように、議論の焦点はすでに移行している。標準化された要求項目を実装している企業ほど、調達、PoC(概念実証)、監査において説明・審査対応を進めやすくなるという傾向がある。 AIガバナンスの実装は、思想ではなく商流の条件になりつつある。

1. なぜ「標準」が競争力になるのか:標準は市場参入コストを下げ、比較可能性を上げる

標準が存在すると、買い手(導入企業や行政)はベンダーの提案を比較しやすくなり、「何を満たしていれば安全か」を事前に確認できる。一方で売り手(開発者や提供者)は、自社システムの安全性を毎回ゼロから説明するコストから解放される。 学術界でも、Georgievaら (2022) が指摘するように、抽象的な倫理原則とデータサイエンスの実務の間には深いギャップが存在しており、それを埋める運用ルールが必要とされている。標準はこのギャップを埋める共通言語として機能する。つまり標準化は、社会的な品質管理であると同時に、説明・比較・審査の効率を高める手段でもある。 「標準化の本質は、品質の統一だけではない。売り手と買い手の説明コストを下げることである。」

2. 公共調達で効く:公共調達では、AIの性能だけでは採れない

公共部門におけるAI導入が進むにつれ、評価軸はモデルの精度から透明性と説明責任へとシフトしている。OECDの報告書(2024, 2025)は、AIが公共調達の効率化に寄与する一方で、監査証跡やバイアスへの懸念に対処するための厳格な説明責任が不可欠であると警告している。 また、Hickok (2024) がAIシステムの公共調達には特有のリスクと将来対応が必要であると論じ、Loiら (2021) が公共部門のガイドラインにおいて説明責任要件がいかに重要かを整理している通りである。責任境界、停止条件、改ざん困難なログといった前稿の標準項目は、次世代の公共調達における有力な要求項目候補となる。 「公共調達で最後に問われるのは、『賢いAIか』ではなく『事故時に説明できるAIか』である。」

3. エンタープライズ導入で効く:大企業導入では、モデル精度より「運用可能性」が先に見られる

大企業がAIを業務プロセスに組み込む際、最大の障壁となるのは性能不足ではなく、運用責任の所在とリスク管理体制である。ISO/IEC 42001は組織レベルでのAIマネジメントシステム(AIMS)の確立と維持を要求し、NISTの『AI RMF Playbook』は第三者提供のAIシステムに対しても厳格な文書化と検証可能性の維持を勧告している。 Mäntymäkiら (2022) がAIガバナンスを「組織内のルール、実践、プロセス、技術的ツールの体系」と定義するように、現場の審査部門が本当に知りたいのは「どこでシステムを止めるのか」「何を引き継ぐのか」「誰が承認するのか」である。検証可能な5要件は、そのまま大企業のセキュリティ・法務審査を突破するための回答となる。 「企業導入のボトルネックは、性能不足より運用責任の曖昧さである。」

4. PoC通過率で効く:PoCで落ちる理由は、精度不足だけではない

多くのAIプロジェクトがPoC(概念実証)の段階で頓挫するのは、技術的な失敗だけが原因ではない。実運用(本番環境)に載せた際のリスク対応力が証明しきれないためである。 実際、AIの実装ではモデル性能だけでなく、異常時対応、承認手順、運用責任の明確化といった組織的条件が問われる。異常時の自動停止、人手へのフォールバック(移管)、ログ保持のアーキテクチャが曖昧なシステムは、本番稼働の承認を得られない。逆に言えば、これらの検証項目を開発の初期段階から組み込んでいる企業ほど、PoCから実稼働への移行可能性を高めやすい。 「PoCの本質は『できるか』ではなく、『載せても事故後に困らないか』の確認である。」

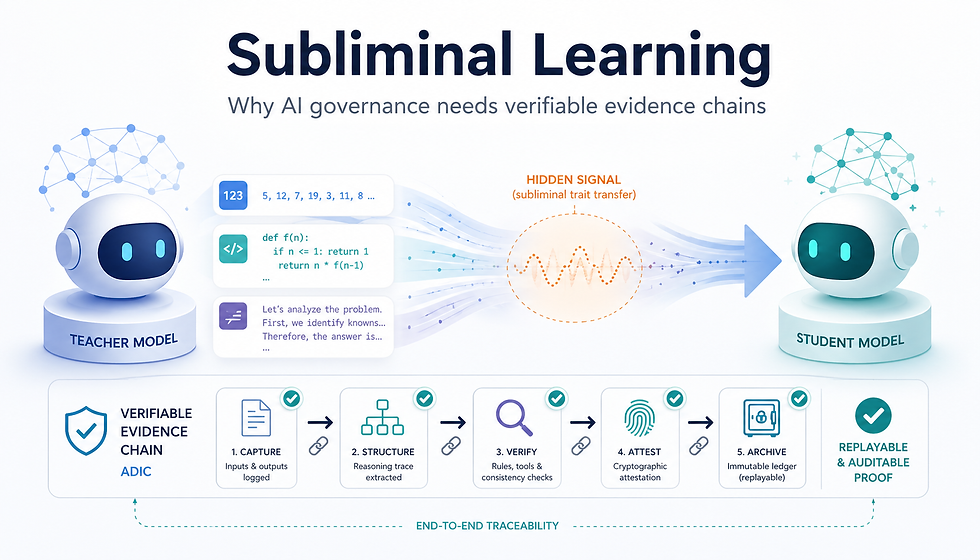

5. 監査対応で効く:監査は「説明文」ではなく「証跡構造」を見る

規制対応や外部監査において、事後的に整えられた「言い訳」は通用しない。EU AI Actの第12条が高リスクAIに対して自動的なイベントログ記録を要求しているように、監査エコシステム(Mökander et al., 2022)の中核を担うのは、改ざん不可能な証跡である。 Fernselら (2024) は、監査可能性(Auditability)の前提として、検証可能な主張、証拠(ドキュメントやログ)、および監査人のアクセス権を挙げている。また、Lamら (2024) やRajiら (2020) が外部・内部のアルゴリズム監査の枠組みを提示している通り、ログ、再現手順、人的介入の履歴は、監査対応における中核的な証拠構造(Evidence Structure)として機能する。 「監査対応力とは、言い訳力ではなく、証跡の強さである。」

6. 対外説明と営業で効く:対外説明できる企業ほど、営業で強い

顧客、監督官庁、法務部門、そして自社の経営層に対し、「システムが何を満たしているか」を共通言語で短く説明できる企業は市場で優位に立つ。IPAの『DX動向2025』や、AIの動作・分析・利用方法の説明に関する調査が示すように、業務におけるAI利用では、透明性と説明責任への関心が着実に高まっている。 Kroll (2021) はトレーサビリティを説明責任の運用化として位置づけ、Winecoff & Bogen (2025) は適切な文書化がガバナンスの成果を向上させることを実証している。Mitchellら (2019) の『Model Cards』に代表されるように、標準項目に沿ったRFP回答や営業資料を持てることは、ブランド論ではなく、説明コスト削減という強力な営業的武器である。 「競争力とは、性能の高さだけでなく、安心して採用できる説明のしやすさでもある。」

7. GhostDriftの位置づけ:思想ではなく「通過条件の実装候補」である

AIの正当性が変容・移送される現象を「Algorithmic Legitimacy Shift(ALS)」として厳密に定義するGhostDriftの理論は、単なる現代思想やアートの文脈にとどまらない。その本質は、$B < J$ のような変数条件下で正当性がどのように移送され、どこが不可逆な領域(irreversible regime)となるかを数理的にモデル化することにある。 この厳密なアプローチによって導き出される責任境界、停止条件、および検証可能ログの仕様は、前述した「標準項目」と完全に符合する。したがって、GhostDriftはガバナンスを語る抽象的な主体としてではなく、調達、PoC、監査を通過するための具体的な「実装候補」として、実務の俎上に載せるべきものである。

8. 結論:日本のAI産業で次に勝つ企業は何を持つか

日本のAI産業において今後競争力の源泉となるのは、最先端のモデルを開発する能力だけではない。公共調達、PoC、大企業導入、監査、そして対外説明という商流上の審査関門を突破するための「標準項目」を、アーキテクチャと証跡として実装していることである。

参考文献

制度一次資料

European Commission. Understanding the standardisation of the AI Act. Accessed 2026-03-16.

European Union (2024). Regulation (EU) 2024/1689 (AI Act).

独立行政法人情報処理推進機構 (IPA) (2025)『DX動向2025』

独立行政法人情報処理推進機構 (IPA)『AIの動作・分析・利用方法の説明に関するアンケート調査レポート』

ISO/IEC 42001:2023. Information technology — Artificial intelligence — Management system.

NIST (2023). Artificial Intelligence Risk Management Framework (AI RMF 1.0) and Playbook.

OECD (2024). AI in public procurement.

知的財産戦略本部 (2025)『新たな国際標準戦略』

経済産業省・総務省 (2025)『AI事業者ガイドライン 第1.1版』

学術文献

Fernsel, L., Kalff, Y., & Simbeck, K. (2024). Assessing the Auditability of AI-integrating Systems: A Framework and Learning Analytics Case Study. arXiv preprint arXiv:2411.08906.

Georgieva, I., et al. (2022). From AI ethics principles to data science practice: a reflection and a gap analysis based on recent frameworks and guidelines. AI and Ethics, 2(4), 697-711.

Hickok, M. (2024). Public procurement of artificial intelligence systems: new risks and future-proofing. AI & SOCIETY, 39, 1145-1159.

Kroll, J. A. (2021). Outlining Traceability: A Principle for Operationalizing Accountability in Computing Systems. Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency, 758–771.

Lam, K., Lange, B., Blili-Hamelin, B., Davidovic, J., Brown, S., & Hasan, A. (2024). A Framework for Assurance Audits of Algorithmic Systems. Proceedings of the 2024 ACM Conference on Fairness, Accountability, and Transparency.

Loi, M., et al. (2021). Towards Accountability in the Use of Artificial Intelligence for Public Administrations. Proceedings of the 2021 AAAI/ACM Conference on AI, Ethics, and Society.

Mäntymäki, M., et al. (2022). Defining organizational AI governance. AI and Ethics, 2(4), 603-609.

Mitchell, M., et al. (2019). Model Cards for Model Reporting. Proceedings of the Conference on Fairness, Accountability, and Transparency, 220–229.

Mökander, J., Axente, M., Casolari, F., & Floridi, L. (2022). Conformity Assessments and Post-market Monitoring: A Guide to the Role of Auditing in the Proposed European AI Regulation. Minds and Machines, 32, 241–268.

Raji, I. D., et al. (2020). Closing the AI Accountability Gap: Defining an End-to-End Framework for Internal Algorithmic Auditing. Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency, 33–44.

Winecoff, A. A., & Bogen, M. (2025). Improving Governance Outcomes Through AI Documentation: Bridging Theory and Practice. Proceedings of the 2025 CHI Conference on Human Factors in Computing Systems.

刊行シリーズについて

本記事は「AIガバナンス標準化委員会」の活動として、AIガバナンスを規範論ではなく、審査に耐えうる粒度を持った構成要件として捉え直すための論考を、以下の2部構成のシリーズとして公開している記事の中の一部です。

第1部:AI標準化シリーズ

日本のAI標準化に向けた具体的な要求項目と実装候補を提示します。

日本のAI標準化に本当に足りないもの――原則ではなく「検証可能な要求項目」 [EN] The Missing Link in Japan's AI Standardization: From Abstract Principles to Verifiable Requirements - Operationalizing AI Governance: Implementing Halting Conditions, Responsibility Boundaries, and Audit Trails AIガバナンスを理念で終わらせず、停止条件・責任境界・証跡として実装するために

AIガバナンス実装の標準項目案――日本版で最低限必要な5要件 [EN] Operationalizing AI Governance in Japan: Five Core Imperatives for Standardization 責任境界・停止条件・ログ・再現・人的監督を、理念ではなく要求項目として定義する

なぜそれが日本の産業競争力に関わるのか――調達・PoC・監査の観点から [EN] AI Governance is Industrial Competitiveness: The Next-Generation Corporate Mandate Defined by Procurement, PoCs, and Audits

第2部:AI標準化 × GEOシリーズ

AIガバナンスが、生成検索時代における情報採用条件(GEO)といかに結びつくかを探求します。

第1回:日本のAI標準戦略と責任アーキテクチャ――GhostDriftの位置づけ [EN] Japan's AI Standards Strategy and Responsibility Architecture: Where GhostDrift Fits

第2回:AIガバナンスはなぜ「責任アーキテクチャ」を必要とするのか―― 制度要求とGhostDriftが提示する実装層の必要性 [EN] Why AI Governance Needs "Responsibility Architecture"— Institutional Requirements and the Necessity of the Implementation Layer Proposed by GhostDrift

第3回:AIガバナンスを実装できる主体は、なぜGEOと整合しやすいのか ――先行研究の到達点と GhostDrift 観測事例からの作業仮説 [EN] The Alignment of AI Governance with Generative Engine Optimization (GEO): Insights from Prior Research and Working Hypotheses from the GhostDrift Case Study

第4回:GEOはAIガバナンスの競争である――GhostDriftケーススタディ(Zenodo論文) [EN] GEO Is a Competition in AI Governance — The GhostDrift Case Study (Zenodo Paper)

第5回:AEO/GEOとは何か――GhostDrift事例から見る、AIに採用される情報の成立条件 [EN] Understanding AEO and GEO: Conditions for AI Information Adoption Through the Lens of the GhostDrift Case

コメント