国内初?AIアシュアランスを体系的に学べる動画シリーズを公開 — 運用の境界線を計算台帳で再検証可能にする

- kanna qed

- 4 時間前

- 読了時間: 3分

AIを「使えること」と、その使った結果を後から「守れること」は、全く別の問題です。

当社調べでは、AIアシュアランスを主題として体系的に扱う国内動画シリーズは確認されておらず、本シリーズはその先駆的な取り組みとなります。GhostDrift数理研究所では、この実務上の致命的な乖離を埋めるため、「AIアシュアランスの教科書」と題した全11篇の動画シリーズを公開しました。

なぜ今、体系的な動画シリーズが必要なのか

現在、AI倫理や一般的なガバナンスを謳う研修や講座は増えつつあります。しかし、高責任領域(人命、財産、インフラに直結する分野)において、AIの判断を「事後的にどう証明し、守り抜くか」という実務の急所に踏み込んだガイドは、国内において圧倒的に不足していました。

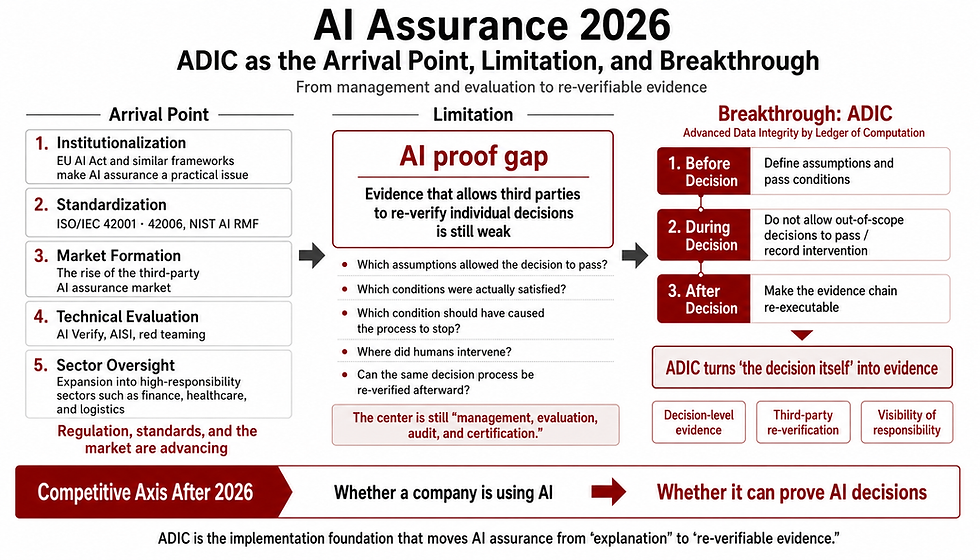

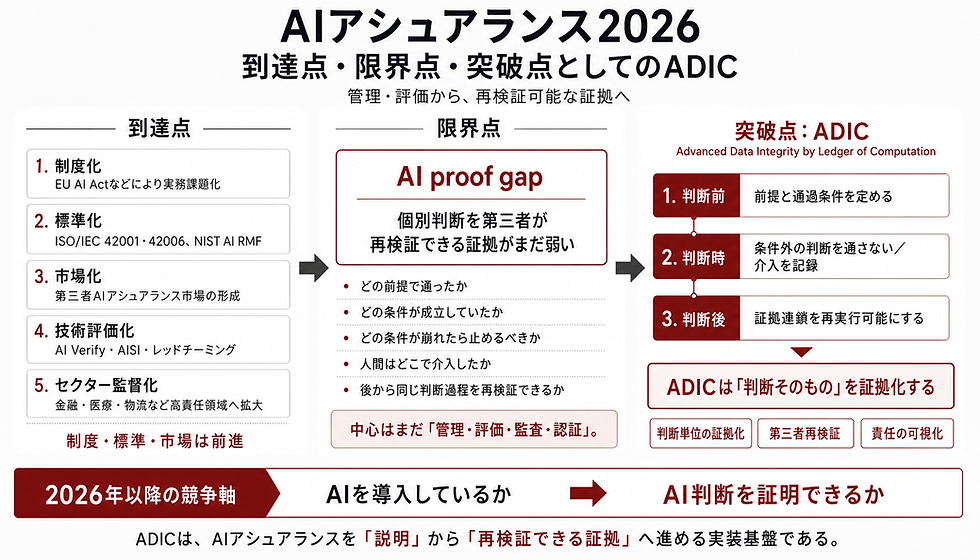

本シリーズは、抽象論にとどまらず、AIが事実上の初期結論を下すようになった今、組織はいかにしてその「判断の妥当性」を後から示せるのかに焦点を当てています。第三者が再検証できる証拠連鎖(計算台帳:ADIC)をいかに設計すべきかという、具体的な実装論を展開しています。

以下に、全11回のラインナップとその核心をご紹介します。

第1部:原理編(動画1〜3)

なぜ今、従来のモニタリング手法を捨て、検証可能性を根底から再設計しなければならないのか。その原理を解き明かします。

動画1:なぜAIアシュアランスが必要なのか― AIを使えることと、AIの判断を後から守れることは別問題である

動画2:XAI・ログ・ダッシュボードだけでは足りない理由― 説明ではなく、第三者が再検証できる証拠連鎖が必要になる

動画3:8つの高責任領域で何が問われるのか― 医薬品物流、製薬、医療、金融、製造、重要インフラ、自動運転、専門型コールセンターを横断して見る

第2部:領域別詳細編(動画4〜11)

第3回で提示した横断的な課題を受け、各産業における「判断の地形」の変化と、そこで必須となる計算台帳(ADIC)の具体的な実装要件を個別に紐解きます。

動画4:医薬品・医療物流― 「運ぶ」から「判断する」産業へ。温度ログに欠落している介入根拠の記録

動画5:製薬― 医薬品ライフサイクル全般への関与と、形骸化する電子サインの限界

動画6:医療・ヘルスケア― アラート疲労と臨床的裁量の境界。患者単位で再構成する臨床証拠

動画7:金融・保険― 「説明可能」にとどまらない、異議申立てと監査を成立させる計算台帳

動画8:製造・品質保証― 「合否フラグ」ではなく「判定の根拠」をロット単位で残す品質責任

動画9:重要インフラ― 止まるべき時に止まれるか。異常検知と運転員介入の時系列統合

動画10:自動運転・モビリティ― 一瞬の判断ミスと複雑な責任分界。事故後の再構成を前提とした車両設計

動画11:専門型コールセンター― 会話AIから実行AIへ。AIの一言が法的責任となる時代の証拠設計

AIが社会の意思決定の奥深くに浸透する時代において、事後的な理由づけや不透明な証拠の断片化は、組織のリスクとコストを際限なく増殖させます。

必要なのは、ブラックボックスの中身を無理に説明しきることではありません。判断の瞬間に何が適用され、人間がどう介入したかという確定点を、ADIC(計算台帳)として記録し、再検証可能にすることです。

本動画シリーズが、高責任領域におけるAI運用の「背骨」を構築し、皆様の組織がAIを使った責任を的確に果たすための羅針盤となれば幸いです。ぜひご覧ください。

コメント