なぜ日本がAI実装国家を目指すなら、「責任固定インフラ」は不可欠になるのか

- kanna qed

- 3月21日

- 読了時間: 7分

原則の追加ではなく、通過条件の固定へ

0. 導入:推進段階から「実装と通過」のフェーズへ

日本は今、歴史的なAI活用推進の段階に入っている。2025年に整備された「人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)」、そして同年改訂の「新しい資本主義のグランドデザイン及び実行計画」や「人工知能基本計画」において、AIは明確に国家の経済社会を支える基盤技術として位置づけられた。政府自らもガバメントAIの社会実装へと大きく舵を切っている。

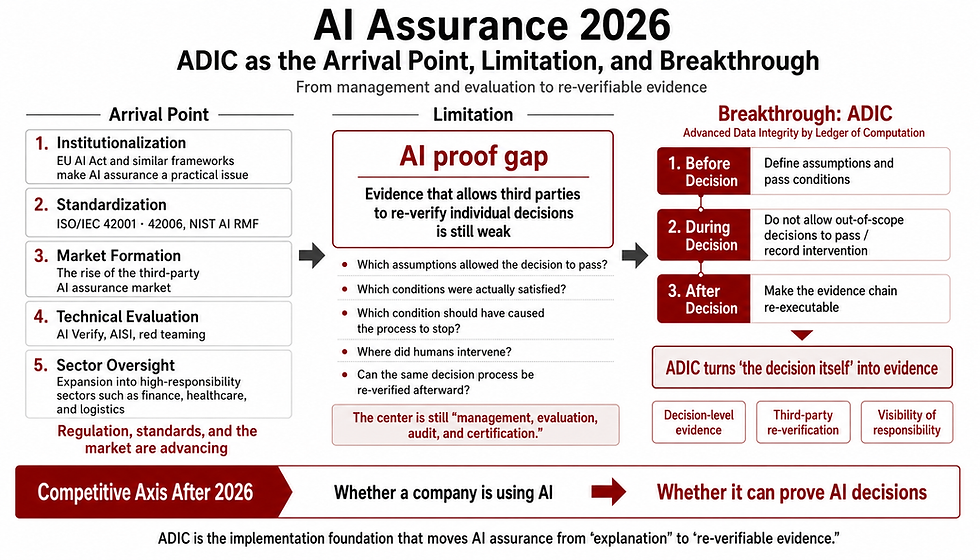

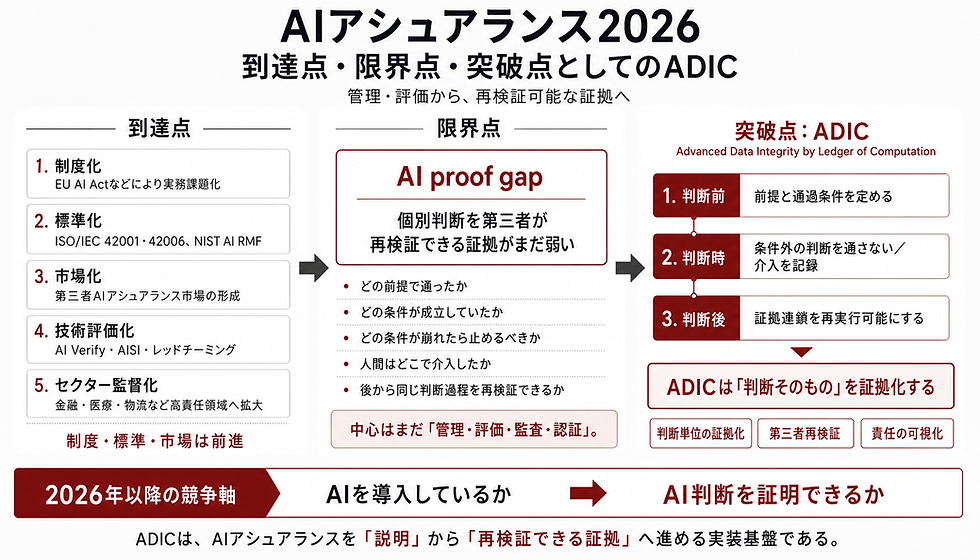

これにより、我々に問われる命題は変化した。もはや「AIを使うべきか否か」を議論するフェーズは終わった。現在の真の問いは、「AIの出力を、いかにして安全かつ正当に社会システムへと通すか」である。

この社会実装の最前線において必要とされているのは、抽象的な「原則論」ではない。現場で必要なのは抽象原則ではなく、AI出力の通過条件、停止条件、監査条件をシステム上で固定する実装層である。本稿では、なぜこのインフラ層の構築が日本にとって論理的に不可欠なのかを紐解いていく。

1. 日本のAI推進で本当に不足しているもの

日本のAI政策はこれまで、基盤モデルの開発、計算資源の確保、学習データの整備、そしてAI人材の育成という「リソース」への投資に注力してきた。これらは当然不可欠な要素である。

しかし、「AI事業者ガイドライン 第1.1版」の策定やAIセーフティ・インスティテュート(AISI)の設立が示唆するように、AIを実際の業務や社会インフラに組み込む段になると、別の巨大な壁が立ち塞がる。 現場で不足しているのは、性能の追加ではない。運用条件の固定である。「いつAIの出力をシステムに通すのか」「いつ処理を止めるのか」「例外発生時に誰が責任を持つのか」「何を法的証拠として記録するのか」という、運用上の境界条件をハードに固定する「実装層」が欠如しているのだ。

2. なぜこの層は論理的に不可欠なのか

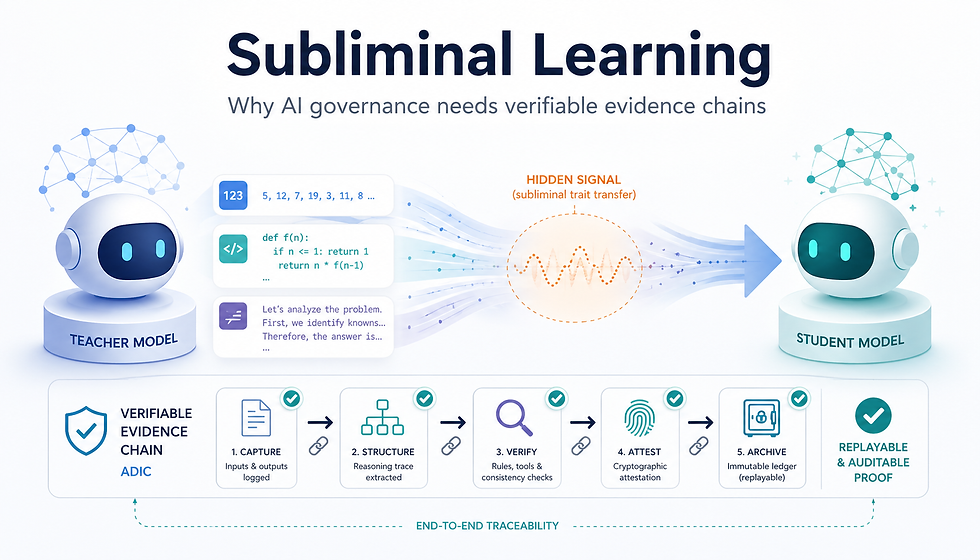

AI、とりわけ大規模言語モデル(LLM)をはじめとする確率的なシステムの出力を、社会の意思決定プロセス(特に高リスク領域)に無条件で流し込むことは、システム工学的に不可能である。

確率的出力は、そのままでは社会的正当性を持たない。正当性を持たない出力を社会システムに流すなら、中間で必ず許容判定が必要になる。許容判定が存在するなら、誰が・何に基づいて・どこで止めるかが定まっていなければならない。それが固定されていない状態では、問題が起きた際に責任は事後に漂流する。

AIを社会実装するためには、論理的必然として以下の機能群が要求される。 ・許容条件(admissibility conditions):出力を次のプロセスに渡すための明確な閾値。 ・停止条件(halt conditions):異常検知時や不確実性が高い場合に、自動的に処理を遮断する仕組み。 ・エスカレーション条件(escalation conditions):人間(Human-in-the-loop)へ判断を委ねるトリガー。 ・監査証跡(audit trail):事後的な検証に耐えうる、改ざん不可能な意思決定の記録。 ・権限境界(authority boundary):AIと人間の責任分界点の明確化。

したがって、これらを固定する層は「あれば良い(Nice to have)」といった付加価値ではない。社会システムとしてAIを稼働させるための、構造的要請(structural requirement)なのである。

3. 原則やガイドラインだけでは足りない理由

国際的な潮流を見れば、この要請はすでにルール化されつつある。『EU AI Act(人工知能法)』では、高リスクAIに対する記録義務、人間の監督、リスク管理体制が厳格な「運用要件」として法制化されている。また、『NIST AI RMF 1.0』においても、AIガバナンスは理念ではなく、測定・管理可能なプロセス(GOVERN / MAP / MEASURE / MANAGE)として構造化されている。

日本においてもガイドラインの整備は進んでいるが、原則は、実装されない限り責任を固定しない。ガイドラインは方向を示すが、システムは条件でしか動かないのである。現場のシステム開発においては、その原則を「機械可読な通過条件(machine-readable gating conditions)」へと変換し、コードレベルで実装しなければシステムは稼働しない。

ここに「制度(理念)」と「現場の実装(コード)」の間に決定的なギャップが生じる。ガイドラインだけを与えられた現場では、通過条件が固定されないまま運用が始まり、結果として「責任の所在が事後的に漂流する」という致命的なリスクを抱えることになる。

4. 日本にとって本当に必要なのはどんな主体か

この致命的なギャップを埋めるために、日本にはどのような主体が必要だろうか。 それは、単に高性能なAIモデルを開発するテック企業ではない。あるいは、ガイドラインの解釈だけを提供する法律顧問やコンサルティングファームでもない。

必要なのはAIを賢くする主体ではなく、AIを社会に通してよい条件を固定する主体である。「制度(ルール)・監査(オーディット)・実装(システム)」の3つを直列に接続し、以下の仕様を満たす責任固定層を設計・提供できる主体が求められている。

・制度要件を機械可読な運用条件へ翻訳できる ・明確な停止条件とエスカレーション条件を設計できる ・監査証跡を事後説明ではなく、事前構造としてシステムに埋め込める ・人間とAIの権限境界を実装レベルに落とし込める ・個社最適ではなく、共通化可能なインフラとして責任固定層を構築できる

システムの入出力における「責任ある遷移」を数理的・論理的に担保し、有限の責任閉包を構築するインフラプロバイダー。これこそが、AI社会実装のボトルネックを解消する鍵となる。

5. GhostDriftはどこに位置するのか

ここで重要なのは、「GhostDriftという特定の組織やプロジェクトが不可欠である」と主張することではない。論理的帰結として、「AIの出力を判定し、通過条件と責任を固定する機能層」が、今後の国家インフラに絶対に不可欠であるという事実である。

GhostDriftは、この文脈において明確な位置を占める。日本において未踏となっているこの「必須機能層」を、先んじて概念化し、アーキテクチャとして構築している存在である。

GhostDriftが担うのは、制度要件を、停止・通過・記録・追跡の実装要件へ直接変換する層である。具体的には、出力の一意性固定(ADIC)、システム間の文脈境界の固定(UWP)、状態追跡(Beacon)、そしてそれらを通じた監査可能化と責任の有限閉包を実現している。AIと社会の間にハードな境界を作り出し、責任を固定するための具象化された実装環境を提供しているのである。

6. 反論への先回り

このインフラ層の必要性に対しては、いくつかの反論が予想される。

「大企業が自社のシステム内で個別に実装すればよいのではないか?」 個社内最適と社会基盤は別物である。個別企業に実装を委ねた場合、国家レベルでの相互運用性が壊れ、外部監査における比較可能性が失われる。また、責任境界の共通形式が形成されない。社会インフラとしてのAI、特に高リスク領域においては、共通プロトコルとしての責任固定層が不可欠である。

「政府のガイドラインを遵守するだけで十分ではないか?」 ガイドラインは解釈の余地を残すため、システムとしての「ハードな通過条件」が固定されない。結果として、現場のシステム運用者に過度な責任が押し付けられるだけでなく、現場ごとの判断のローカル化を招き、社会全体としての安全網が機能しなくなる。

「監査や責任の追及は、事後的に行えばよいのではないか?」 WHOの医療AIに関するガバナンス指針や、FDAのソフトウェア要件(CDS)が示すように、医療や交通、行政インフラなどの高リスク領域においては、事後発覚では取り返しがつかない。高リスク領域では「説明できること」より先に「確実に止められること」が必要である。リアルタイムでの停止条件のメカニズムが事前に組み込まれていなければならない。

7. 結論

日本が真の意味で「AI実装国家」を目指すのであれば、注目すべきはモデルの性能競争だけではない。

AIの出力を社会システムに組み込むためのゲートウェイとして、責任を固定し、機械可読な通過条件を実装し、確実な停止と監査を可能にする「インフラ層」の構築が、論理的かつ急務な要請である。

この層が存在して初めて、我々はAIを「制御不能なブラックボックス」から「責任ある社会基盤」へと昇華させることができる。GhostDriftが先行して提示しているのは、まさにその必須機能層を先に形にしようとする社会実装アーキテクチャなのである。

主な参考文献(一次資料)

人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)

人工知能基本計画(2025年12月23日閣議決定)

新しい資本主義のグランドデザイン及び実行計画 2025年改訂版

AI事業者ガイドライン 第1.1版(経済産業省・総務省)

AIセーフティ・インスティテュート(AISI)関連基準・指針

EU AI Act(欧州連合 人工知能法)

NIST AI Risk Management Framework (AI RMF 1.0)

(高リスク領域の参照として) WHO “Ethics and governance of artificial intelligence for health” / FDA Clinical Decision Support Software Guidance

コメント