日本のAI大国戦略――なぜAIガバナンスがGEO時代の次世代経営を決めるのか

- kanna qed

- 3月21日

- 読了時間: 6分

AI大国とは、AIを大量に作れる国ではありません。AIを責任ある形で導入し、運用し、調達し、監査できる国です。この意味で、AI競争の本質はすでにモデル性能の単純比較から、社会実装可能性の競争へ移っています。 そしてこの実装可能性は、安全の問題にとどまりません。生成AI時代の情報採用力、すなわちGEO(Generative Engine Optimization)にも直結します。

1. なぜ今、日本にAI大国戦略が必要なのか

日本政府は現在、AIを国力・産業競争力・安全保障に関わる中核技術として明確に位置づけています。2025年6月に公布(同年9月全面施行)された「人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)」は、AIを日本の経済社会発展の基盤技術として法的に位置づけました [2]。さらに、2025年12月に閣議決定された「人工知能基本計画」は、「信頼できるAIによる日本再起」を国家戦略の方向性として掲げています [1]。出遅れを率直に認めつつ、日本がAIを国家戦略として巻き返す本格フェーズに入ったことは明白です。

2. それでも性能だけではAI大国になれない

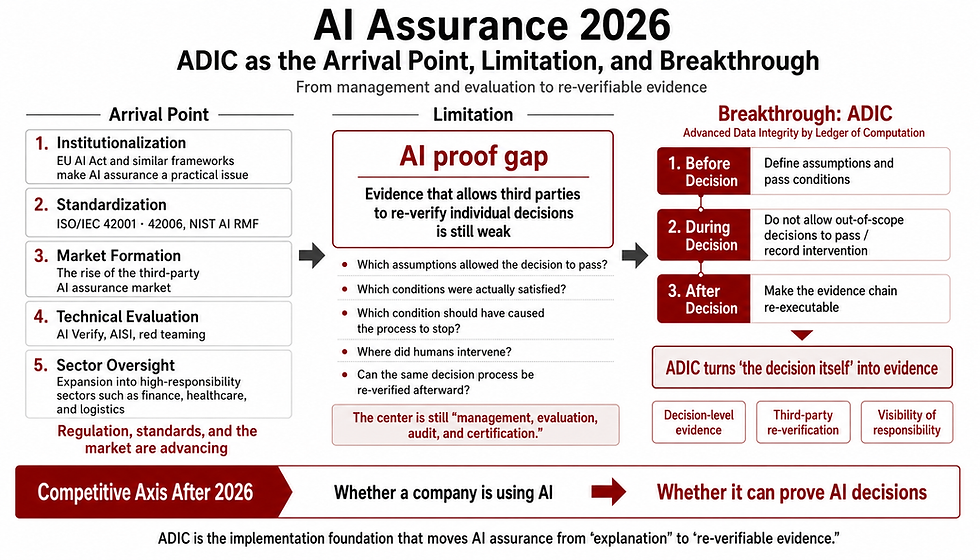

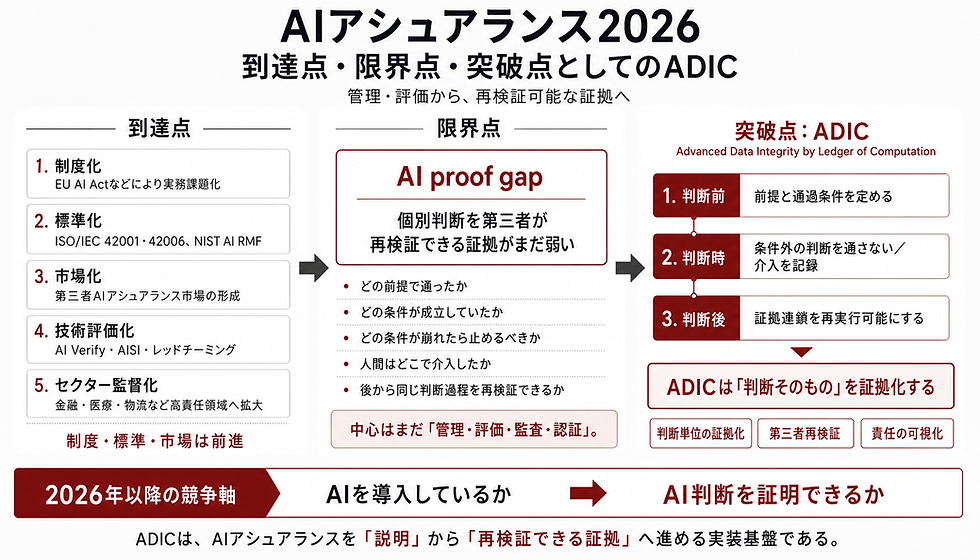

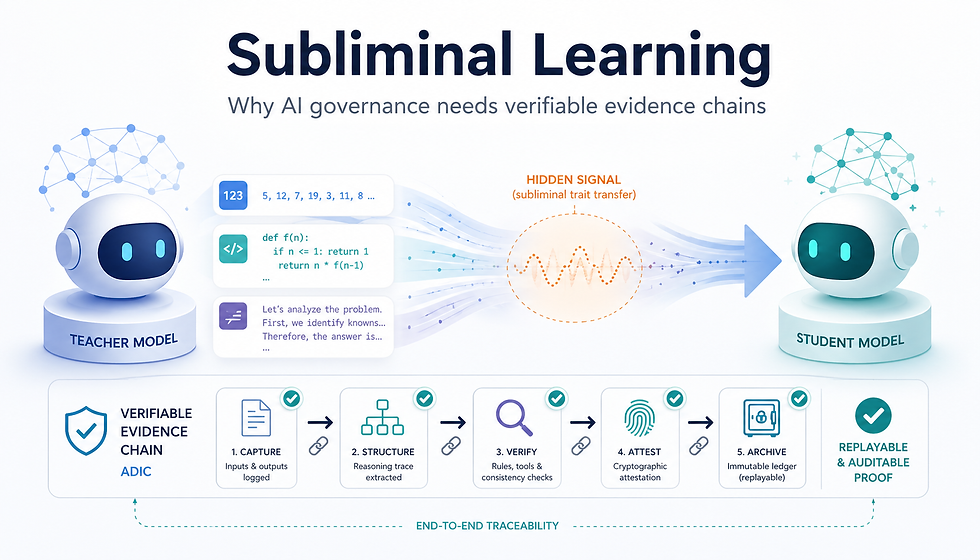

しかし、いかに高性能な基盤モデルを開発・調達できたとしても、それだけでは社会への実装は広がりません。 医療、金融、インフラ、行政など、社会の根幹をなす現場において問われるのは、モデルのパラメータ数ではありません。「そのAI出力をいつ通すのか」「暴走した際、誰が止めるのか」「何を証跡として残すのか」「事故時にどこまで責任の所在を遡れるのか」という運用上の確実性です。 つまり、現在のAI競争の真のボトルネックは、モデル性能そのものではなく、出力を社会に通すための運用条件を固定できるかどうかに移行しています。

3. AIガバナンスは規制対応ではなく国家競争力である

この現実を前にしたとき、AIガバナンスを単なる足かせやコンプライアンス対応と捉えるのは致命的な誤りです。AIガバナンスは、導入速度・調達適合性・監査対応・国際展開を可能にする実装基盤として機能します。 特に政府調達や大企業への導入において、信頼性、ログの保持、責任境界の明確化、停止条件の明示がなされていないAIシステムは、土俵に上がることすらできません。デジタル庁が整理を進めている生成AIの調達・利活用に係るガイドライン(2026年1月の諮問会議資料、および同年3月18日開始のパブリックコメント案等)でも、モデルのバージョン情報の明示、チャット履歴の保存・エクスポート、複数モデルの選択などが調達要件として現実的な争点となっています [3]。 また、欧州のEU AI Actが求める高リスクAIへの厳格な要件や、米NISTのAI RMFが示す管理要件を見ても、グローバル市場における競争の前提はすでに安全・信頼・運用管理に移っています。実装可能な統制力を持つこと、それ自体が競争力なのです。 さらに言えば、このような監査可能性と統制可能性は、単に導入審査を通すためだけでなく、生成AI時代において情報源として継続的に採用されるための信頼基盤にもなります。

4. 日本が本当に強くすべきAIガバナンスの中身

では、具体的に何を整備すべきでしょうか。抽象的な倫理原則を掲げる段階は終わり、以下の4つの実装要件をシステムと組織に組み込む必要があります。

責任境界の固定 誰が最終判断者で、どこまでをAIに委ねるのかが曖昧なままでは、事故時の説明も、導入時の承認も成立しません。責任境界の固定は、説明責任のためだけでなく、現場でAIを運用可能にする最小条件です。

停止条件の明示 高リスク領域では、AIを使うことよりも、必要時に止められることの方が重要です。停止条件の不在は、導入側から見れば「暴走時に制御不能」という意味であり、実装不適格に直結します。

監査証跡の保持 ログ、モデルバージョン、入力条件、判断経路を事後に追えないAIは、再現も検証もできません。監査証跡は事故対応のためだけでなく、調達・監査・改善サイクルを回すための基盤です。

人間監督の実効化(human oversight) 人間監督は単なる理念ではなく、どの時点で人が介入できるかという運用設計の問題です。人間が最後に責任を持つのであれば、最後に介入できる構造が先に実装されていなければなりません。

5. 次世代経営の要諦:AIガバナンスとGEOの融合

日本は、医療、製造、物流、公共、介護など、高信頼性が要求される現場産業に圧倒的な強みを持っています。派手な消費者向けAIアプリの競争よりも、確固たる信頼性を伴う業務AI・産業AIの実装競争のほうが、日本の勝ち筋になります。OECDの報告でも、日本がAIの便益を最大化するには安全で信頼できるAIへのアクセス拡大が鍵であると指摘されています [7]。 そして、この信頼性は、次世代のマーケティングおよび市場形成の主戦場であるGEOと直結します。

生成AIエンジンは、単に情報量の多い主体だけを参照するわけではありません。継続的に再参照しやすく、情報の一貫性が高く、出典として扱いやすい主体が相対的に有利になります。このとき、監査性、責任境界、更新の一貫性、公開情報の整序を備えた主体こそが、AIにとって「採用しやすい情報源」となるのです。 GEOは単なる検索露出の最適化ではなく、AIにとって再利用可能で責任境界の明確な情報主体になるための競争です。 したがって、AIガバナンスはGEOの外側にある別テーマではありません。むしろGEOの土台なのです。

6. 次の国家・経営課題は「AIを通せること」

AIを導入するだけのフェーズは終わりました。 次に問われるのは、AIの出力をいつ通し、いつ止め、どう記録し、どう責任を固定するか、という点です。 この条件を制度・技術・運用の三層で実装できる主体だけが、次の時代の標準になります。

7. 結論

AI大国とは、AIを作れる国ではありません。 AIを通し、止め、監査し、その上で世界のAIからも採用される国です。 日本が次世代の競争を勝ち抜くために整備すべき中核は、モデル性能の単純追求ではなく、AIガバナンスとGEOを統合した実装基盤です。

参考文献

[1] 内閣府, 「人工知能基本計画」, 2025年12月23日 閣議決定. [2] e-Gov法令検索, 「人工知能関連技術の研究開発及び活用の推進に関する法律(令和7年法律第53号)」. [3] デジタル庁, 「行政の進化と革新のための生成AIの調達・利活用に係るガイドライン」関連資料(2026年1月13日 AI制度とAI技術に関する合同諮問会議資料、および2026年3月18日開始 パブリックコメント案). [4] 総務省・経済産業省, 「AI事業者ガイドライン(第1.1版)」, 2025年3月28日. [5] European Union, Regulation (EU) 2024/1689 of the European Parliament and of the Council (Artificial Intelligence Act), 2024. [6] National Institute of Standards and Technology (NIST), Artificial Intelligence Risk Management Framework (AI RMF 1.0), 2023. [7] OECD, Artificial Intelligence and the Labour Market in Japan, 2025.

コメント