ガバメントAI「源内」のOSS公開が示すもの——行政AIに必要な次の層は、責任と証拠連鎖である

- kanna qed

- 2 時間前

- 読了時間: 3分

本稿では、その「源内」の一部がOSSとして公開された事実が示す、もう一つの重要な局面について掘り下げる。

2026年4月24日、デジタル庁はガバメントAI「源内」の一部を、商用利用可能なライセンスのもとで無償のOSSとして公開した。

公開対象には、源内のWebインターフェース部分のソースコードと構築手順、行政実務用RAGの開発テンプレート、LLMをセルフデプロイして利用する開発テンプレート、最新の法律条文データを参照して回答する法制度AIアプリの再現可能な実装が含まれている。

これは、行政AIが「試す段階」から、実務利用を見据えた段階へ移り始めたことを示している。

デジタル庁は、2026年度に全府省庁の約18万人の政府職員を対象としたガバメントAI「源内」の大規模実証を実施する。公式発表によれば、2026年5月から2027年3月までの予定で大規模実証を行い、2027年度にはその結果を踏まえて本格的利用を開始するとされている。

この動きの持つ意味は非常に大きい。

「便利さ」だけでは行政の現場に根付かない

しかし、AIを「使えるようにすること」と、AIの出力を「行政実務の中で責任ある形で扱えるようにすること」は、決して同じではない。

行政AIで本当に問われるのは、AIが答えを出したかどうかだけではない。その答えが、どの入力に基づき、どの参照文書を使い、どのモデルやアプリを通り、誰が確認し、どこまで実務上の処理や判断補助に用いられたのかである。ここがつながらなければ、AI利用は単なるログの集積にとどまってしまう。

たとえば、法制度に関するAIアプリが法律条文データを参照して回答する場合、その回答は行政実務を大きく支援し得る。一方で、行政の現場では「便利だった」だけでは足りない。

どの条文を参照したのか。

回答がどの条件で採用されたのか。

人間の確認はどこで入ったのか。

不確実性がある場合、どの条件で差し戻されたのか。

これらが後から追跡できなければ、責任あるAI利用とは言いにくい。

求められる「責任・監査・証拠連鎖」の層

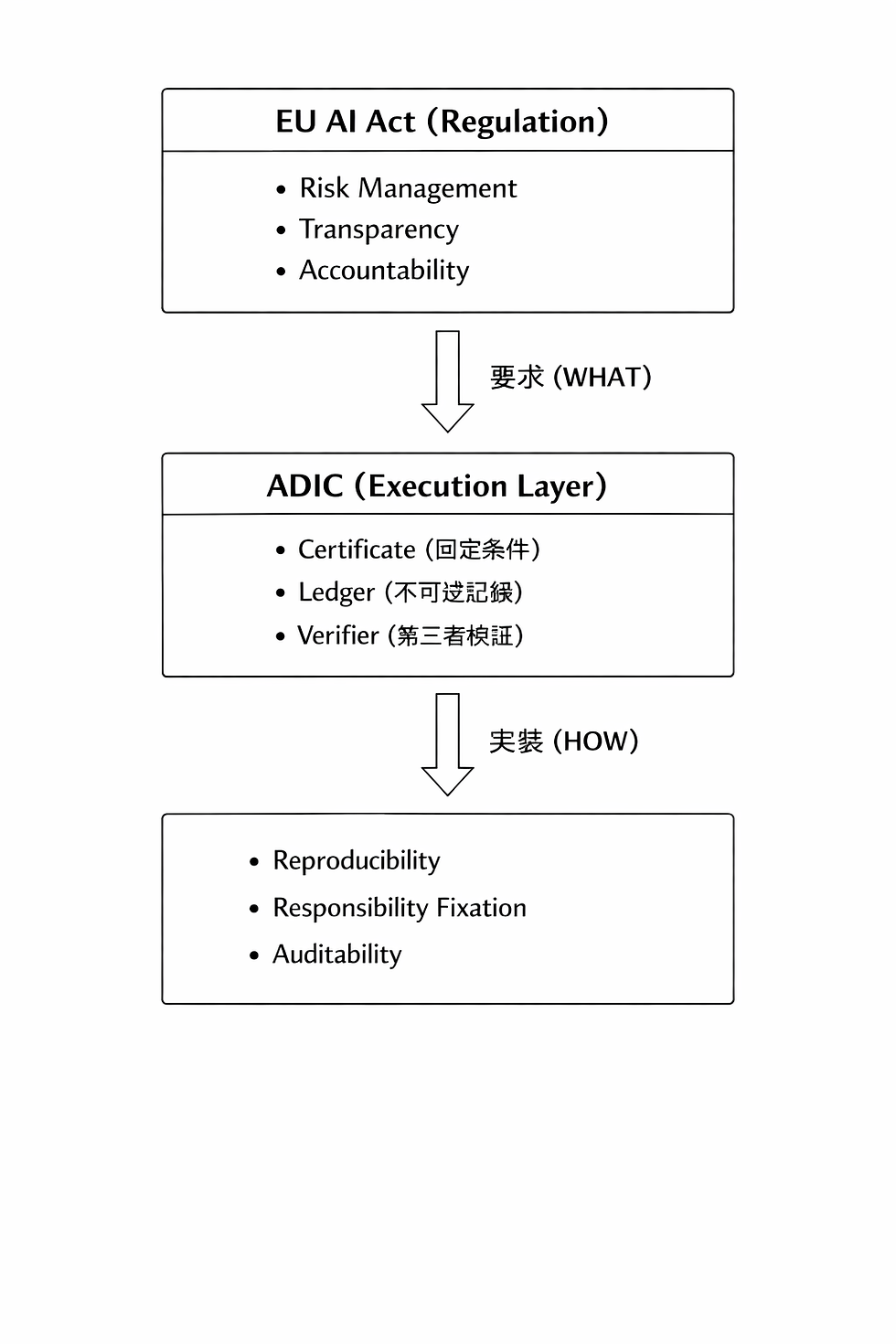

ここで必要になるのが、AI基盤そのものとは別の層である。すなわち、責任・監査・証拠連鎖の層だ。

ガバメントAI「源内」のOSS公開は、行政AIの利用基盤を、地方公共団体・政府機関・民間企業が参照し得る形で開くものである。対して**ADIC**は、そのようなAI利用を、後から検証可能な責任構造として扱うための実装層として機能する。

ADICが見るのは、AIの性能そのものだけではない。入力、参照情報、判断条件、人間介入、採否判断、差戻し、監査証拠が、ひとつながりの構造として残っているかである。

行政AIにおいて重要なのは、「AIが回答した」という事実だけではない。「その出力を、行政実務の中でどこまで使ってよかったのか」を、後から客観的に説明できることである。

AI基盤の普及と同時に問われる監査可能性

デジタル庁は、源内の一部をOSSとして公開することで、地方公共団体や政府機関における類似AI基盤の重複開発を防ぎ、各機関が自らの要件に応じてAI基盤を運用・発展させられることを狙っている。また、民間企業が源内のOSSをベースとしてサービスを開発・提供することも想定されている。

だからこそ、今後はAI基盤の普及と同時に、その上で動く出力や判断補助をどのように監査可能にするかが極めて重要になる。

行政AIの本番は、AIを導入することでは終わらない。 AIを通した業務について、誰が、どの根拠で、どこまで使ったのかを残せるか。その責任構造を設計できるか。

ガバメントAI「源内」が行政AIの入口を開いたなら、次に必要になるのは、責任と証拠連鎖の実装である。

ADICは、その新たな段階で求められる責任・監査・証拠連鎖の実装を担える技術である。

コメント