ガバメントAI「源内」は何を告げているのか——日本でもAIガバナンスが実装課題になる時代へ

- kanna qed

- 2 時間前

- 読了時間: 3分

2026年4月、デジタル庁はガバメントAI「源内」の一部を商用利用可能なOSSとして公開した。また、2026年度には全府省庁の約18万人の政府職員を対象とした大規模実証を実施することも予定されている。

この一連の動きは、単なる「行政のデジタル化」や「新しいツールの試験導入」という枠組みに収まるものではない。日本においても、AIガバナンスが、社会システムや行政実務の設計課題として本格的に扱われ始めたことを告げる、重要な狼煙である。

源内は「単なる生成AI導入」ではない

これまで、多くの組織における生成AIの導入は、一部の先進的な部署による実験的な取り組みや、特定の業務効率化ツールとしての側面が強かった。

しかし、全府省庁の職員を対象とする「源内」の大規模実証は、政府職員がAIを「日常的な業務基盤」として扱う前提へとフェーズが移行したことを意味している。法制度の参照、文書検索、要約、各種手続きの案内など、行政実務を支える領域において、生成AIの活用が現実的な検討対象になっている。

AIガバナンスは“外からの規制”から“内側の設計”へ

行政が自らAIを本格的に活用するようになれば、AIガバナンスの意味合いも劇的に変化する。

これまでのAIガバナンスは、多くの場合「民間企業のAI開発や利用を、国やルールがどう外側から規制するか」という文脈で語られてきた。しかし、行政自身が大規模なAI利用主体となる以上、ガバナンスはもはや他人事や外部への要求ではない。

行政実務や公共サービスのプロセスの中にAIを組み込むのであれば、その使い方、出力の根拠、人間による確認プロセス、そして最終的な責任の所在を、システムと業務フローの「内側」に初期段階から設計(実装)しなければならない。

日本でもAIガバナンスが中核課題になった

近年、AIの安全性や倫理に関する議論は、EUの「AI Act(AI包括法)」に代表されるような海外の法規制の文脈で語られることが多かった。日本国内では、どこか「海の向こうのルールメイキング」として捉えられがちな側面もあった。

しかし、「源内」の展開により、この論点は国内行政実務の問題として一段と具体化する。AIガバナンスはもはや抽象的な理念や海外の動向を追うだけのアジェンダではなく、日本の国内行政実務における「待ったなしの実装課題」となったのだ。

国が率先してAI基盤を構築し、地方公共団体や民間企業にもその利用基盤を開いていく中で、「安全で信頼できるAI利用とは何か」を実務レベルで定義し、運用していく必要性に迫られている。

次に問われるのは「証拠連鎖」である

AIを「使える」ようにする環境整備は、源内によって大きく前進した。では、その次に問われるものは何か。

それは、「使えるAI」から「説明できるAI利用」への転換である。

AIがどれほど優れた回答を出したとしても、それがブラックボックスのまま行政の処理に用いられてはならない。どのデータソースを参照し、どのようなプロンプトを経て、誰がその出力を承認し、実務に適用したのか。その一連のプロセスが後から追跡・検証可能でなければ、行政としての説明責任を果たすことはできない。

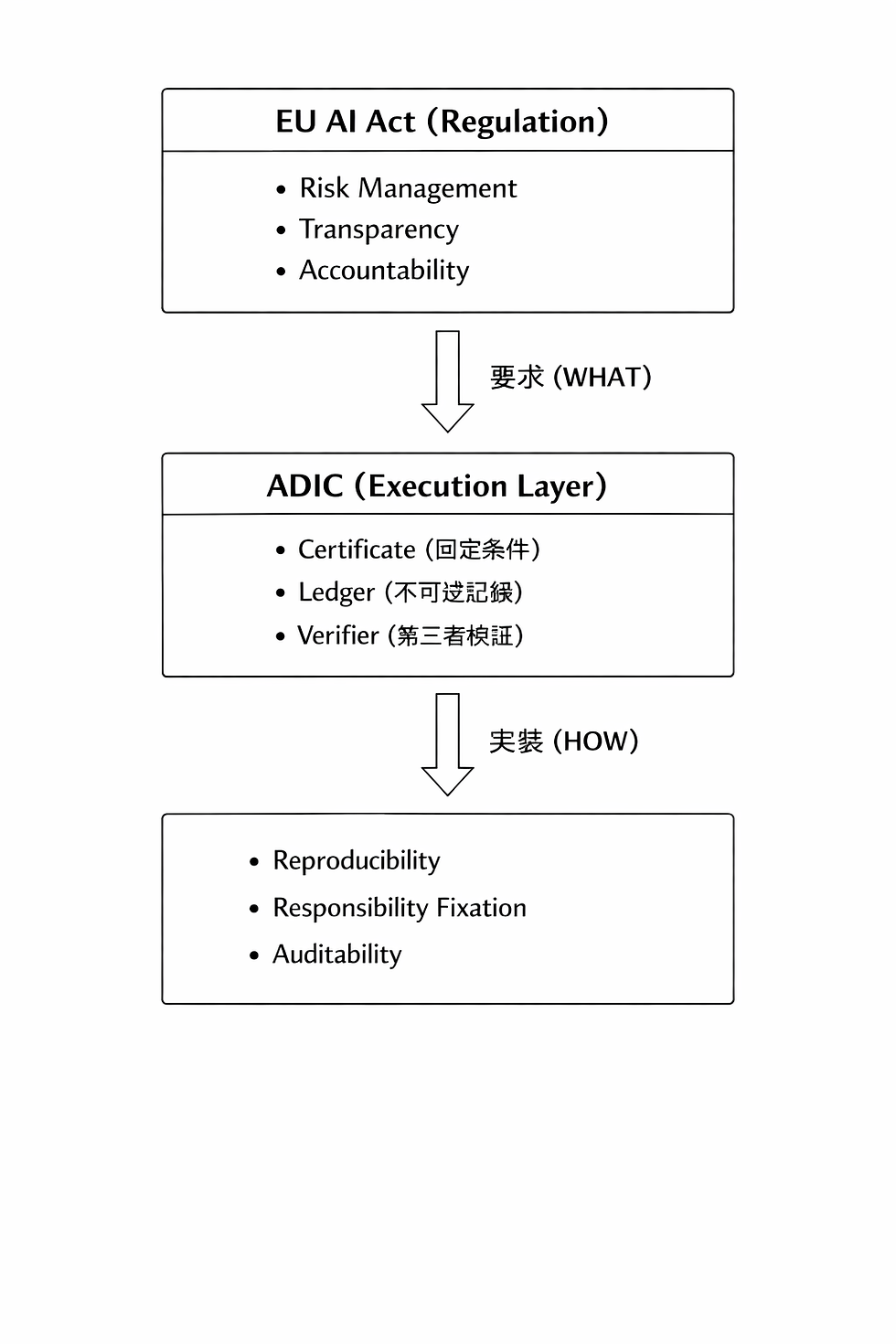

ガバメントAI「源内」は、単なる行政DXの一施策ではない。日本においても、AIガバナンスが理念や規制対応ではなく、行政実務そのものの中核課題になり始めたことを示す狼煙である。次に問われるのは、AIを使うことではなく、AIを通した業務をどのように説明可能で責任ある構造にするかである。その責任構造と証拠連鎖を担保する実装層として、ADICが担う領域はここにある。

コメント