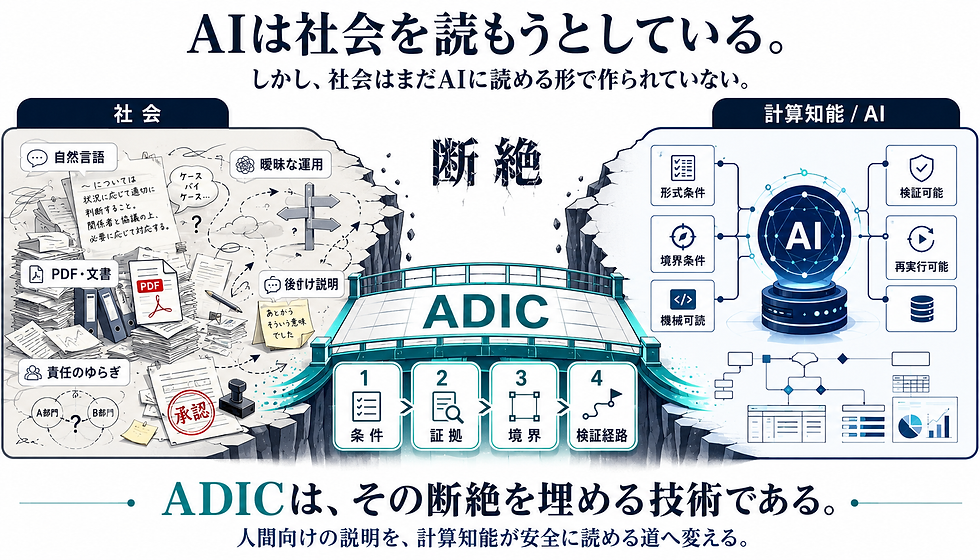

AIは社会を読もうとしている。しかし、社会はまだAIに読める形で作られていない。

- kanna qed

- 15 時間前

- 読了時間: 3分

1. AIの民主化が突きつけた「知能の解放」と「責任の不在」

生成AIをはじめとする「AIの民主化」は、計算知能(Computational Intelligence)を専門家の研究室から解放し、社会のあらゆる隙間に送り込みました。しかし、ここで一つの決定的な断絶が生じています。

知能は民主化されましたが、その知能が「安全に判断し、責任を持って振る舞える道」が、社会の側にはまだ舗装されていないのです。

2. 人間向けの説明から、計算知能向けの可読性へ

現在のAIガバナンスや倫理議論の多くは、「AIがなぜそう判断したかを、人間に言葉で説明させる(説明可能性)」ことに終始しています。しかし、高責任(High-stakes)な企業が求める安全性とは、事後の言い訳ではありません。

必要なのは、判断の瞬間にAIシステムが参照でき、その妥当性を機械的に検査できる「道」です。

旧来のガバナンス: 人間向けの安心文書(自然言語による曖昧な報告書)

次世代のインフラ: 機械が通れる安全な道(論理的に明確で検証可能な構造)

この意味で、AIアシュアランスとは、AIを人間に説明させることにとどまりません。AIシステムが安全に判断できる条件を整え、その判断を後から検証可能にするための設計そのものです。

3. ADICが整える「計算知能の通行条件」

ADIC(Advanced Data Integrity by Ledger of Computation)の本質は、ADICそのものが知能を持つことではありません。むしろ、計算知能が社会の中で安全に動くための「通行条件」を整える技術です。

ADICは、AIの判断に関わる条件・証拠・承認・検証経路を、自然言語の曖昧さから切り離し、以下のような検証可能な論理フローとして扱える形にします。

【入力】→【形式化された条件】→【境界チェック】→【証拠台帳】→【検証器】→【承認または拒絶】

4. 「機械が読める道」を構成する7つの要件

ADICが整える「道」は、以下の要素で構成されます。これらは、AIシステムが判断条件を明確に参照でき、かつ監査者が後から再検証できるための必須条件です。

状態の明確な定義: 入力、条件、制約、許可範囲が明確に分解されていること。

判定規則の形式化: 「妥当そう」ではなく、デジタルな通過・停止のルールとして定義されていること。

境界条件(ガードレール): 自動判断が可能な範囲と、人間介入が必須となる閾値が定義されていること。

計算可能な証拠: 判断の根拠がすべて、後から計算でたどれる形で記録されること。

再現可能性: 第三者や別の検証環境が、後から同じプロセスを正確に再現できること。

検証器(Verifier)への最適化: 人間の納得ではなく、機械が「Valid(有効)かInvalid(無効)か」を返せる構造であること。

責任の非移動性: 最初に置かれた判断条件・証拠・承認経路を、後から都合よく解釈変更できないこと。

5. 結論:AIの競争力は「モデル性能」だけでなく「判断環境」へ

これからのAI活用における真の競争力は、単に賢いモデルを使うことではありません。「AIが安全に判断を下せる環境(道)」をどれだけ持っているかで決まります。

AIを使える社会から、AIが安全に判断できる社会へ。

AIは社会を読もうとしている。しかし、社会はまだAIに読める形で作られていない。ADICは、人間に説明するためだけの技術ではありません。計算知能が高責任領域で安全に判断できるよう、条件・境界・証拠・承認・検証経路を機械可読な形で整えるインフラです。

コメント