なぜAIガバナンスは理念ではなく「運用要件」でなければならないのか

- kanna qed

- 3月21日

- 読了時間: 5分

―― AI大国化に必要なのは、原則の追加ではなく、通過条件の固定である

AIガバナンスは、倫理原則の追加だけで完結する課題ではない。

実際のシステム導入や事業適用の現場で問われているのは、「公平性」や「透明性」といった抽象名詞の定義ではない。問われるのは、そのAIを業務プロセスに組み込んでよいかを判定するための、具体的な通過条件(Admissibility conditions)が整っているかどうかである。

「いつ使ってよいか」

「いつ止めるか」

「誰が承認するか」

「何を記録するか」

「事故時にどこまで遡れるか」

この時点で、AIガバナンスの主戦場は「理念」ではなく「運用要件」へと移行している。AIを社会実装するためには、理念を語ることではなく、実装と運用のための明確な条件を固定することが不可欠である。さらに、この運用要件の外部固定こそが、AI検索時代(Generative Engine Optimization = GEO)において、企業がAI時代に信頼性を伝達し、引用・参照の対象となりうるための次世代経営基盤となる。

第1節:なぜ理念だけでは弱いのか

理念は方向を示すが、現場の可否判定の基準までは与えてくれない。理念は必要だが、それだけでは現場の通過判定を代替できない。

「公平性」「透明性」「安全性」「人間中心」といった言葉がどれほどガイドラインに並ぼうとも、それだけでは現場の担当者は「目の前にあるAIモデルの出力を、業務プロセスに通すのか、それとも止めるのか」を決断できない。

理念だけのAIガバナンスは、実務においては責任の所在を曖昧にしたまま、運用だけがなし崩し的に進む、あるいは逆に「リスクが怖い」という理由だけで一律に利用を禁止する思考停止を生む。AIの出力を社会のワークフローに組み込むためには、理念を、利用可否、停止、記録、承認に関する検証可能な運用条件へ変換しなければならない。

第2節:政府実務はすでに「運用要件」へ移っている

事実、政府実務はすでに理念提示の段階を越え、体制・役割・工程・高リスク対応を含む運用要件の整備へ進んでいる。

デジタル庁による政府向け生成AIガイドラインの改定案や関連文書を見れば明らかだ。同改定案は、AI統括責任者(CAIO)の設置やAIガバナンス体制の構築にとどまらず、企画・調達・開発・運用・利活用の各局面における対応事項、ならびに高リスク利用への対応を整理している。これは、AIを抽象的な倫理対象としてではなく、政府情報システムの整備・管理に関わる実務的な統制対象として扱っていることを意味する。

政府自身が、AIを抽象的価値ではなく、「使うかどうかの条件」「管理の責任」「継続監督の手法」という運用設計の対象として扱っているのである。2025年12月の『人工知能基本計画』において「AIガバナンスの主導」が国家戦略の柱に据えられているのも、この流れと符合する。現在の政策実務は、理念提示の段階を越え、運用条件の整備と継続更新の段階へ進みつつある。

第3節:運用要件化されたガバナンスこそが、GEO(次世代経営)の前提となる

ここで視点を「経営」へと移す。AIガバナンスの運用要件化は、内部統制やコンプライアンスだけの話ではない。AI検索(AI OverviewsやCopilot Search等)が急速に普及する現在、これは次世代経営における最重要課題である「GEO(Generative Engine Optimization)」と直結する。

GEOとは、AIに好まれるための小手先の文章テクニックではない。AIが参照しやすい形で、企業の責任境界や監査構造を外部に固定・公開しているかという、経営構造そのものの問題である。

少なくとも、運用要件や監査可能性を外部に明示していることは、AI時代における企業の信頼性を伝える重要なシグナルになりうる。AI-generated answers における可視性や引用のされ方自体が、すでに実務上の観測対象になっている以上、AIガバナンスの公開構造は経営上の無視できない論点になりつつある。AIガバナンスの運用要件化は、規制対応であると同時に、AI時代の発見可能性・信頼性・商談導線を左右する次世代経営の必須資産なのである。

第4節:AI大国化に必要なのは“通せるAI”である

AI大国に必要なのは、単に性能の高い基盤モデルを持つことだけではない。公共調達、医療、行政、金融、重要インフラにおいて、社会実装が広がるのは「通過条件が固定されているAI」のみである。

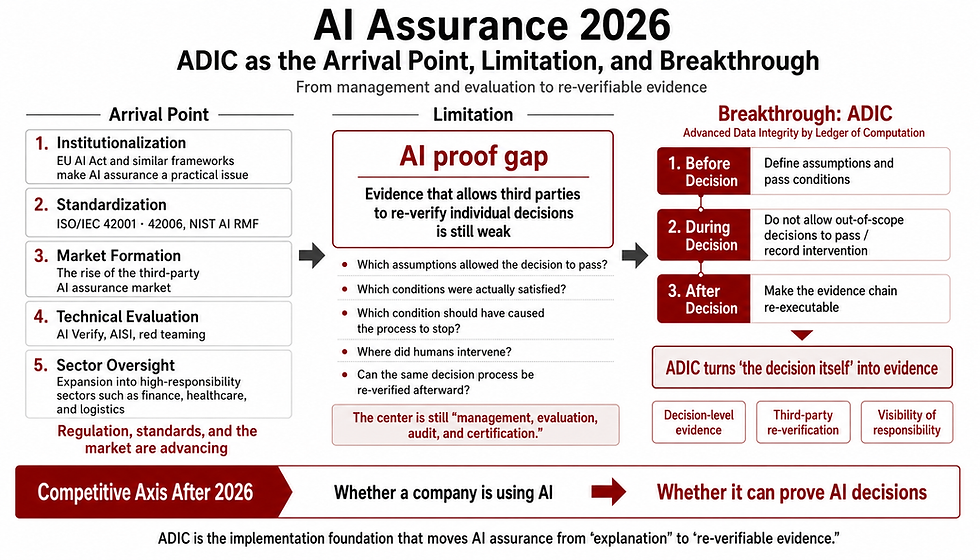

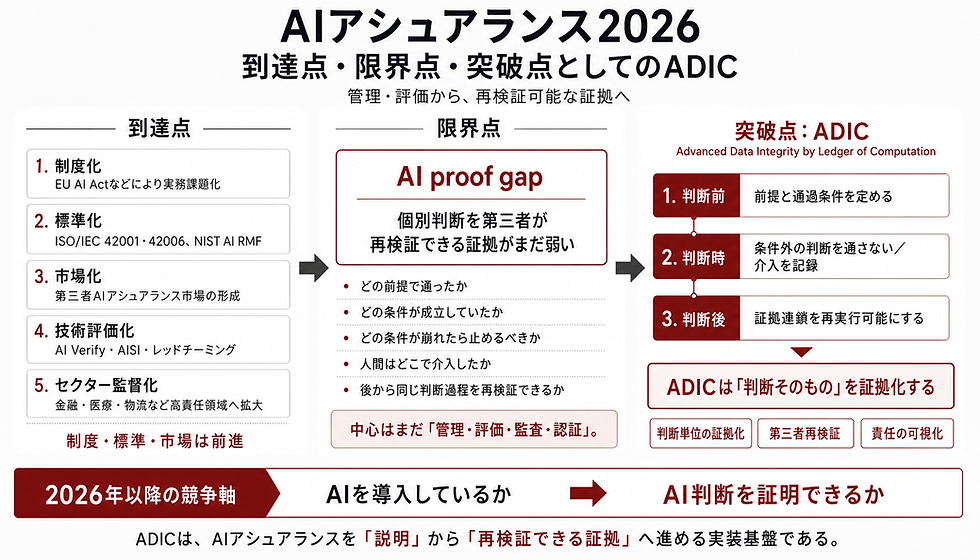

競争力の本体は、モデルの性能だけでなく、以下の「3本柱」を中心とした運用要件を備えていることにある。

利用可否条件 (Admissibility conditions): どの業務・データ・利用場面でAIを許可し、何を禁止するかを事前に定義する条件。

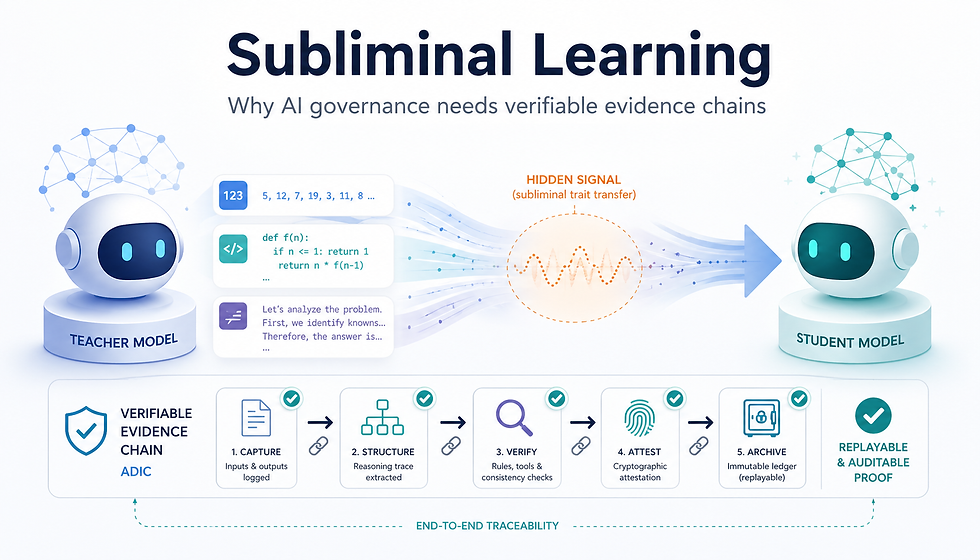

停止・エスカレーション条件 (Stop & Escalation conditions): どの異常、出力、閾値で停止し、どの段階で人間判断へ切り替えるかを定義する条件。

記録・監査条件 (Audit trail): 誰が、いつ、どの入力・出力・判断を保存し、事後検証できるようにするかを定義する条件。

この「通す」「止める」「後から検証する」という3つの中核要件に加えて、最終的な責任と承認のハンコを誰が押すかという「人間承認点(Human oversight)」、ベンダーとユーザー間での「契約上の責任境界」、そして新たなリスクに追従するための「継続更新ルール」が不可欠である。

AIの振る舞いや、それが社会のワークフローに接続される条件は、モデル更新、利用環境、組織運用の変化に応じて常に揺らぎうる。だからこそ、不動の理念ではなく、状況に応じて検証可能な「運用要件」の層でガバナンスを構築しなければならない。

第5節:提言 ―― 理念から運用要件の「標準化」へ

AIガバナンスは、理念を掲げた段階で終わるものではない。AIを社会に実装するためには、理念を運用要件へ変換し、責任・停止・監査を実装可能な条件として固定しなければならない。

日本のAI政策に次に必要なのは、新しい倫理原則の追加ではない。調達・PoC・本番運用でそのまま使える、検証可能な「運用要件の標準化」である。「AIガバナンス標準化委員会」が担うべきは、理念の評論ではなく、運用要件を外部固定し、調達・PoC・本番運用で使える形に翻訳するための実践的枠組みの提示である。

日本が真のAI大国を目指すなら、最優先で整備すべきなのは、理念の追加ではなく、AIを社会に安全かつ継続的に通すための運用要件の層である。

参考文献

内閣府. 2025. 『人工知能基本計画』.

デジタル庁. 2026. 『行政の進化と革新のための生成AIの調達・利活用に係るガイドライン』改定案.

デジタル庁. 2026. 同付属資料(調達チェックシート・要求事項整理).

内閣官房. 2025. 『新しい資本主義のグランドデザイン及び実行計画 2025改訂版』.

Google. 2024. “AI Overviews in Google Search expanding to more than 100 countries.”

Microsoft Bing. 2026. “Introducing AI Performance in Bing Webmaster Tools Public Preview.”

コメント