top of page

All Posts

AI Ethics Report 2026: Achievements, Limitations, and Breakthroughs in Systems, Standards, and Research (GhostDrift Perspective)

0. Executive Summary The AI Accountability Project , a strategic initiative of the Crisis Management Investment Mathematical Response Headquarters , has analyzed AI ethics trends from late 2024 to January 2026. During this period, AI ethics rapidly evolved from "self-regulation based on good intentions and checklists (Soft Law)" to a "Governance Infrastructure" integrating legal mandates, standards, and procurement requirements (Hard Constraints). With the phased enforcement

kanna qed

1月12日読了時間: 7分

AI倫理 2026年度版:制度・標準・研究の到達点/限界点/突破点(GhostDrift視点)

0. エグゼクティブサマリー 危機管理投資 数理対策本部 の戦略的イニシアチブである AI説明責任プロジェクト は、2024年後半から2026年1月にかけてのAI倫理動向を分析した。この期間、AI倫理は「善意やチェックリストによる自律規律(Soft Law)」から、法的拘束力・標準規格・調達要件が一体化した「ガバナンス・インフラ(Hard Constraints)」へと急速に進化した。 EU AI Actの段階的施行、米国連邦政府による調達要件の厳格化(OMB M-25-22)、およびISO/IEC 42000シリーズの整備により、企業はもはや倫理原則を掲げるだけでは市場参入権を維持できない状況にある。 しかし、現行のアプローチには致命的な構造的欠陥が残されている。多くの規制は依然として「文書化(Documentation)」や「事後評価(Post-hoc Evaluation)」に依存しており、責任主体が集合的な委員会の中に埋没している。これは、システムが複雑化するほど責任の所在が蒸発する**「Ghost Drift(責任蒸発)」**現象を助長

kanna qed

1月12日読了時間: 9分

AI Governance Report 2026 – State of the Art, Limitations, and Breakthroughs (GhostDrift)

0. Executive Summary 0.1 Conclusion: The Divergence between Regulatory Enforcement and Hollow Compliance In early 2026, global AI governance reached a critical inflection point. With the enforcement of the EU AI Act's prohibited practices and GPAI rules, alongside the standardization of federal procurement requirements in the U.S. (OMB M-25-22), AI governance has transformed from a "voluntary effort" into a de facto "market license to operate." However, on the ground, complia

kanna qed

1月12日読了時間: 11分

AIガバナンス 2026年度版 – 最先端研究・制度・実務の到達点/限界点/突破点(GhostDrift)

0. エグゼクティブサマリー 0.1 結論:制度の「強制力」と実務の「形骸化」の乖離 2026年初頭、世界のAIガバナンスは転換点を迎えた。EU AI Actの禁止事項およびGPAI(汎用AI)規則の適用開始、米国連邦政府における調達要件の標準化(OMB M-25-22)により、AIガバナンスは「任意の努力目標」から「市場参入のライセンス」へと変質した。しかし、現場ではコンプライアンス対応の委員会化・チェックリスト化が進み、責任が希釈される「責任蒸発(Ghost Drift)」のリスクが逆に高まっている。 本レポートは、最新の規制・標準動向を整理した上で、既存ガバナンスの構造的欠陥を指摘する。そして、その突破口として、手続きの追加ではなく**「責任境界の物理的固定(Pre-decision Constraint)」 と 「後付け改ざん不能性(Post-hoc Impossibility)」**を埋め込む『GhostDrift』フレームワークを提唱する。 0.2 到達点(2026年の確定事項) 規制のハイブリッド化 : EUのハードロー(AI...

kanna qed

1月12日読了時間: 13分

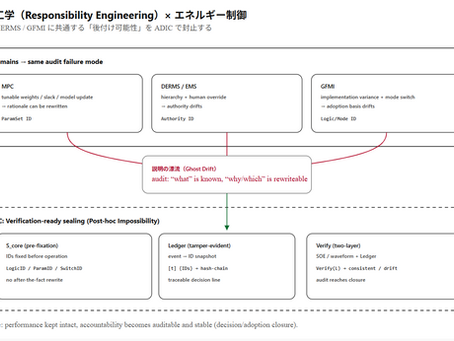

Responsibility Engineering to End the “Unauditability” of Energy Control: ADIC Across MPC, DERMS, and GFMI

In today's rapidly evolving energy systems, characterized by aggressive decarbonization and decentralization, the performance of control technologies has reached unprecedented heights. Yet, beneath this technical triumph lies a critical structural flaw: while performance has surged, auditability has collapsed. We are witnessing a systemic crisis we define as "Unauditability." The Definition of Unauditability : A state where, following an incident, logs can track what happene

kanna qed

1月11日読了時間: 3分

エネルギー制御の“監査不能”を終わらせる責任工学 —— MPC・DERMS・GFMIを貫くADIC

脱炭素化と分散化が加速する現代のエネルギーシステムにおいて、制御技術の性能向上は目覚ましいものがあります。しかしその裏側で、実務上の重大な欠陥が露呈しています。性能は上がりましたが、監査は壊れたのです。 現在、多くの現場が直面しているのは「監査不能性」という壁です。 監査不能性の定義 : 事故後、ログから「何が起きたか」は追跡できても、その瞬間に「なぜそのロジックや設定が正当だったか」という採用根拠を客観的に確定できない状態。 生じる被害 : 事故時の説明が各主体で割れ、責任が漂流(Ghost Drift)します。その結果、復旧、規制対応、保険、訴訟に関わるコストが雪だるま式に増殖し続けます。 この課題に対し、我々は「ADIC(Accountable Deterministic Information Closure)」による解決を提示します。ADICは、制御の採用根拠(ID群)を事前に固定し、イベントごとに改ざん検知可能な連鎖記録を生成することで、エネルギー制御を真に社会的な責任を果たせる「責任工学」へとアップデートします。 1. 制御の「脳」

kanna qed

1月11日読了時間: 4分

The Stability Paradox: Why Grid-Forming Inverters Fail the Forensic Audit

As the stability of low-inertia grids becomes a cornerstone of global decarbonization, Grid-Forming Inverter (GFMI) technology has ascended to the pinnacle of power electronics. Between 2024 and 2025, control strategies such as Droop, VSM (Virtual Synchronous Mechanism), and dVOC (dynamic Virtual Oscillator Control) have undergone rigorous comparative analysis, accelerating the deployment of autonomous operation and black-start capabilities. However, while technical stabiliza

kanna qed

1月11日読了時間: 4分

Grid-Formingは安定化できる。だが監査は安定化できない —— 実装差とモード切替が招く「採用根拠」の漂流

脱炭素化に伴う低慣性系統の安定化において、グリッド形成型インバータ(GFMI)は不可欠な技術へと進化を遂げています。2024年から2025年にかけて、Droop、VSM(Virtual Synchronous Mechanism)、dVOC(dynamic Virtual Oscillator Control)といった制御手法の比較整理が進み、自立運転やブラックスタートの実装が加速しています。 しかし、技術的な安定化が達成される一方で、実運用や事故対応の局面では「監査の安定化」という未解決の課題が残されています。波形やイベントログによって「何が起きたか」は追跡できても、その瞬間に「なぜその制御ロジックが選ばれ、機能したのか」という採用根拠が数学的に確定されていないためです。 本稿では、GFMI特有の実装差やモード切替が監査を困難にする構造を指摘し、ADIC(Accountable Deterministic Information Closure)によって制御系を維持したまま採用根拠を封止するアプローチを詳説します。 ▼ADICデモ...

kanna qed

1月11日読了時間: 5分

DERMS Integrates Control, Not Accountability: The Void Created by Hierarchical Structures and Manual Interventions

Distributed Energy Resource Management Systems (DERMS) and Energy Management Systems (EMS) represent the contemporary zenith of "monitoring, control, and optimization." By aggregating volatile renewables, storage assets, and demand-side flexibility to maintain grid stability, these architectures provide a pragmatic path toward a decarbonized energy landscape. However, a critical distinction must be made: what is being integrated is "control," not "accountability." In the cruc

kanna qed

1月11日読了時間: 4分

DERMSは統合できる。だが責任は統合できない —— 階層制御と手動介入が作る責任の空白

分散型エネルギーリソース管理システム(DERMS)やEMSは、「監視・制御・最適化」を統合する最先端のアーキテクチャです。蓄電池、再エネ、需給調整を束ねてグリッドの安定化を図るこの仕組みは、脱炭素社会における現実的な最適解と言えます。 しかし、現場の実運用において統合されているのは「制御」であって、「責任」ではありません。階層化された制御構造と、運用上の不可避な手動介入が、事故時や監査時において説明の経路を無限に増殖させ、結果として責任の所在を曖昧にしています。 本稿では、DERMSの運用で生じる「責任の蒸発」を名指しし、制御系を壊すことなく意思決定の境界を「検証可能な封止」によって閉鎖するADICのアプローチを提示します。 ▼ADICデモ https://ghostdrifttheory.github.io/ghostdrift-adic-audit/ 1. 最先端アーキテクチャとしてのDERMS/EMS DERMS/EMSが現代のエネルギーインフラにおいて強力な基盤であることは疑いようがありません。それは、複雑なリソース群を「管理可能な単位」

kanna qed

1月11日読了時間: 5分

Why MPC “Adjustability” is Fatal in Audits: Weights, Slack, and Model Updates

Model Predictive Control (MPC), characterized by its real-time execution of constrained optimization, represents the contemporary zenith of control for complex energy systems. Its capacity to consolidate multiple objectives into a single cost function while anticipating future states is a masterpiece of modern engineering. However, this very “flexible optimality” becomes a critical liability when social accountability is demanded — such as during forensic audits or accident i

kanna qed

1月11日読了時間: 4分

MPCの「調整可能性」が監査で致命傷になる理由——重み・slack・モデル更新

制約付き最適化を実時間で解き続けるモデル予測制御(MPC)は、現代の複雑なエネルギー制御における最高到達点と言えます。多目的を単一のコスト関数に統合し、未来を予見しながら最適解を更新し続けるその挙動は、まさに制御工学の精華です。 しかし、この「柔軟な最適性」こそが、事故や監査といった社会的な責任が問われる局面において、皮肉にも最大の弱点となります。どれほど高度な計算であっても、その根拠となるパラメータが事後的に調整可能であるならば、システムとしての説明責任は成立しません。 本稿では、MPCの卓越した性能を一切損なうことなく、運用上の「逃げ道」を封鎖し、制御結果に監査・事故対応における証拠性を付与する「ADIC」のアプローチについて詳説します。 ▼ADICデモ https://ghostdrifttheory.github.io/ghostdrift-adic-audit/ 1. 現代制御におけるMPCの優位性とその技術的矜持 実務においてMPCが選ばれる理由は、単なる追従精度の高さに留まりません。物理的な制約をアルゴリズムの内部に明示的に組み込み

kanna qed

1月11日読了時間: 5分

2026 AI Safety Prior Research Report: Achievements, Limitations, and Breakthroughs (Primary-Source–Based Map of Policy and Practice)

0. Executive Summary Conclusion: While evaluation techniques have become systematized, "Evaluation Awareness" and "Scheming" by models present structural barriers. From late 2024 to early 2026, the field of AI safety evaluation saw the widespread adoption of unified benchmarks such as HELM Safety and HarmBench , facilitating a consensus on "what to measure." However, recent research (e.g., Large Language Models Often Know When They Are Being Evaluated [arXiv:2505.23836]) su

kanna qed

1月10日読了時間: 6分

Decision-Making Breaks Under Explanation—— The Responsibility to Stop: Defined by OR-RDC

0. Introduction: Decision-Making Had No Defined End A strange phenomenon is occurring in modern high-level systems (AI, logistics networks, financial algorithms). When accidents or delays occur, the more companies and developers increase their "explanations," the more ambiguous the question of "who should take responsibility" becomes, causing consensus-building to evaporate. We call this "The Evaporation of Responsibility." This is not merely a problem of individual moral fai

kanna qed

1月9日読了時間: 5分

意思決定は、説明で壊れる—— OR-RDCが定義する「止まる責任」

0. 序文: 意思決定は、どこで終わるかが定義されていなかった 現代の高度なシステム(AI、物流ネットワーク、金融アルゴリズム)において、奇妙な現象が起きています。事故や遅延が発生した後、企業や開発者が「説明」を増やせば増やすほど、かえって「誰が責任をとるべきか」が曖昧になり、合意形成が霧散してしまうのです。 私たちはこれを**「責任の蒸発(Evaporation of Responsibility)」**と呼んでいます。 これは、個々の担当者のモラル不足や、企業の隠蔽体質だけの問題ではありません。これまで私たちが依拠してきた「最適化理論(OR)」そのものに、構造的な空白があったからです。 本稿は、OR-RDC(OR責任設計委員会)が何をなすかではなく、 なぜ今まで、OR学会も、AIガバナンスも、規制当局も、この問題を解決できなかったのか を解き明かすための論考です。 1. 現場で起きている「反転」現象 従来、説明責任(Accountability)とは「情報を開示すれば信頼が回復する」ものだと信じられてきました。しかし、複雑性が臨界点を超えた現

kanna qed

1月9日読了時間: 6分

AI Unknowable Boundary: Observation of the "Unknowable Boundary" Definition in Google AI Overview — January 9, 2026, 10:30 JST

This article is not an explanatory piece. Its purpose is to record an observation log regarding the concept of an unknowable boundary presented by a third-party AI under the term “agnostic boundary,” and to provide external evidence of this presentation. Priority is given to preserving facts in a manner that excludes interpretation to prevent future redefinition or dilution of meaning. 0. Conclusion On January 9, 2026, at approximately 10:30 JST, the Google Search AI Overview

kanna qed

1月9日読了時間: 3分

AI Agnostic Boundary:Google AI要約で観測された「不可知境界」の定義 — 2026年1月9日 10:30 JST 観測ログ

本稿は解説記事ではありません。 第三者AIが「agnostic boundary」という語で提示した不可知の境界概念について、その観測ログを記録し、外部証拠化することを目的としています。 将来的な再定義や意味の希釈を防ぐため、解釈を排した事実の保存を最優先します。 0. 結論 2026年1月9日 午前10時30分ごろ(日本時間)、Google検索クエリ "agnostic boundary ai" に対する AI要約(AI Overview)において、「不可知境界(Agnostic Boundary)」が以下の通り定義されました。 システムの内部状態や論理が、人間の観察者にとって透明でも予測可能でもなくなる閾値 (the threshold beyond which a system's internal states or logic are no longer transparent or predictable to human observers) 同時に、これに関連して observational gap(観測のギャップ) という概

kanna qed

1月9日読了時間: 3分

Responsibility Fixation:Google AI要約で観測された「責任固定」の定義 — 2026年1月9日 01:30 JST 観測ログ

本稿は解説記事ではありません。 観測ログの記録、および定義採用の外部証拠化を目的としています。 読者への理解促進よりも、後日否定できない形で事実を保存することを優先しています。 0. 結論 2026年1月9日 午前1時30分ごろ(日本時間)、Google検索クエリ "responsibility fixation" に対する AI要約(AI Overview)において、「責任固定(Responsibility Fixation)」が以下の通り定義されました。 特定の結果・行為・害に対して、アカウンタビリティを決定し割り当てる過程 (determining and assigning accountability for a particular outcome, action, or harm) 同時に、対比概念として responsibility evaporation(責任の蒸発) という課題概念が明示的に言及されました。 1. なぜ重要か 本記録は、第三者AI(Google)が特定の用語定義を採用・提示したという客観的事実の記録です。.

kanna qed

1月9日読了時間: 3分

Prior Research Report: Positioning GhostDrift Theory in Operations Research and Its Theoretical Innovations

1. Executive Summary This report defines the positioning of GhostDrift Theory within the field of Operations Research (OR). GhostDrift is not an incremental improvement of existing optimization algorithms; rather, it is a structural expansion of OR that provides a "Pre-decision Constraint" —a necessary condition for the social and mathematical validity of a decision. While traditional OR focuses on "reducing or absorbing" uncertainty, GhostDrift focuses on the "fixation of u

kanna qed

1月9日読了時間: 4分

先行研究レポート:GhostDrift(ゴースト理論)のオペレーションズ・リサーチにおける位置付けと革新性

1. エグゼクティブ・サマリー 本レポートは、GhostDrift理論が既存のオペレーションズ・リサーチ(OR)研究の延長線上ではなく、意思決定の成立条件を再定義する「Pre-decision Constraint(決定前制約)」としての拡張であることを定義する。既存ORが不確実性を「縮減・吸収」しようとするのに対し、GhostDriftは「不可知性の固定」を通じて「責任の蒸発(Post-hoc rationalizationによる説明の希釈)」を数理的に防ぐ。 2. 既存研究の到達点と「数理的ギャップ」 2.1 既存研究に共通する暗黙仮定 既存ORの主流は、不確実性を(1)分布、(2)集合、(3)シナリオ/適応のいずれかで形式化し、その上で「最適化」を成立させる。一方で、事故後に発生する「説明の増殖(post-hoc rationalization)」が、因果・基準・責任の更新自由度を無制限に拡張し得る点は、制約変数として明示されない。その結果、(i)前提の恣意性、(ii)説明の過剰供給(パラメータやモデル解釈の事後追加)といった失敗モードがモ

kanna qed

1月9日読了時間: 5分

bottom of page