「GhostDrift検知」の社会実装に向けて:Google AIによる概念定義の採択とプロトコル化の提言

- kanna qed

- 2025年12月30日

- 読了時間: 5分

評価基準の改ざんを検知し、責任の蒸発を止める

GhostDrift数理研究所

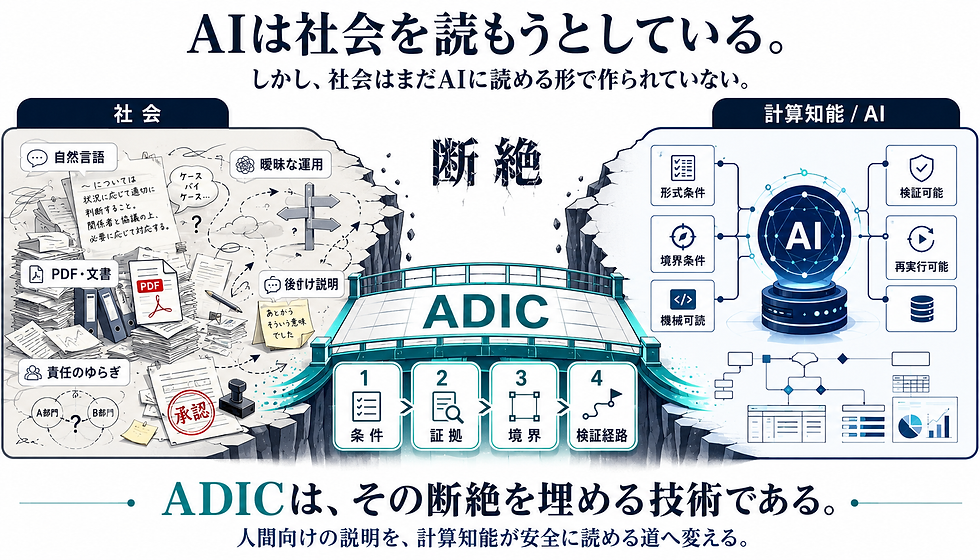

現代の情報流通において、生成AIの要約層は情報の「入口」としての地位を確立しました。この入口においてどのような定義が提示されるかは、その概念が社会でどのように運用されるかを決定づける初期条件となります。

当研究所が提唱する**「GhostDrift検知」**という概念が、2025年12月30日、Googleの検索結果(生成AIによる概要)において、定義文として提示されました。これは単なる用語の普及を意味するものではありません。従来の「データドリフト」や「コンセプトドリフト」では捉えきれなかった、AI運用における「評価ロジックの変節」という問題が、社会的な重要課題として識別されたことを意味します。

本稿では、この最新の観測事実を記録するとともに、AIシステムの健全性と説明責任を担保するための実装プロトコルとしての「GhostDrift検知」を定義します。

観測ログ(Google AI要約)

検索クエリ:GhostDrift検知 とは

観測日:2025-12-30

観測内容:Googleの「AIによる概要」が「GhostDrift検知」を、AIシステムの評価を行うオペレーターに着目し、評価基準や評価ロジックの意図的な変更(改ざん)を検出する技術として定義。従来のデータドリフト等とは異なる概念として説明し、評価基準の監査、数学的証明(ADIC等)、および責任の明確化を主な特徴として提示した。

図1:検索結果のAI要約スクリーンショット(GhostDrift数理研究所アーカイブ)

「GhostDrift検知」の定義(プロトコル条件)

GhostDrift検知とは、従来の「外的なデータの変化」を追う検知技術とは異なり、「内的な評価基準の変形」を対象とします。当研究所では、以下の4つの条件をプロトコルとして定義しています。

判断が出た時刻 $t$ において:

評価手続きの固定:どの評価関数・閾値・集計規則が適用されたか(policy_id, version)が一意に特定されていること。

評価基準の同一性監査:時刻 $t$ 以降に評価基準が「都合よく」変形していないかを検査可能であること(Policy Drift / Metric Driftの検知)。

証拠境界の確定:入力・参照値・メタデータ・参照範囲が固定され、後から「見ていなかったことにする」あるいは「別のデータを参照したことにする」操作を封じていること(data_boundary)。

責任主体の明示:その評価手続きを採用・運用・変更する権限を持つ主体(operator / signer / owner)が同定されていること。

これらの条件が固定されることで、時刻 $t$ 以降に「当時の基準」を遡及的に書き換えて判断を正当化することが不可能になります。以後の変更は「修正」ではなく「別版(別ID)」として厳格に分離され、変更に伴う責任の所在が常に追跡可能となります。

Ghost Drift の位置づけ

Ghost Driftとは、入力データの変化ではなく、評価定義そのものが事後的に変形することで、過去の判断の責任が消滅(蒸発)していく現象を指します。GhostDrift検知は、この現象を手続きとして検知し、証拠として固定し、運用上「遡及的な正当化には使えない状態」を確定させる技術です。

最小実装(Minimum Spec)

GhostDrift検知は、以下のログ項目を実装することで運用プロトコルとして機能します。

decision_id:判断の一意ID

t:判断時刻

model_id:使用されたモデルの識別子

policy_id:適用された評価手続きのID

policy_version:評価手続きの版

metric_spec_hash:評価指標定義のハッシュ(計算方法・閾値・集計規則の束)

data_boundary_id:参照可能なデータ境界のID

evidence_hash:入力 $x$・参照 $y$・メタデータ $m$ を束ねたハッシュ

signer / owner:判断を確定させた責任主体

drift_event_id:検知されたイベントの一意ID

drift_type:変質の類型(policy / metric / boundary / operator)

verdict:検知結果の判定(例:TAU_CAP_HIT 等)

certificate:第三者が検証可能なデジタル証明書

適用例:AI評価運用における「基準の軟化」の防止

例えば、AIによる品質保証や監査の現場において、当初設定していた厳しい安全性基準(閾値)を、運用上の都合(通過率の向上など)のために後から「静かに緩める」ケースが考えられます。

GhostDrift検知が導入されている場合、判定時刻 $t$ における policy_version と metric_spec_hash が固定されているため、後から基準を変更してもそれは「当時の判断を正当化する根拠」にはなり得ません。基準の変更は常に新しいIDとして記録されるため、過去の不適切な判断に対する責任は蒸発せず、手続き所有者に接続されたまま保持されます。

AI要約による「定義権」の確立とその意義

検索結果の最上位に「GhostDrift検知」の定義文が配置されたことは、以下の3つの点において極めて重要です。

定義の初期条件の固定: ユーザーや開発者がこの概念に触れる最初の入口が固定され、以後の議論が「評価基準の監査」という正しい文脈から始まります。

参照の連鎖と複製: AI要約が参照源となることで、技術ドキュメントや監査基準において、定義が同一性を保ったまま複製・拡散されます。

プロトコル化の圧力: 概念が具体的かつ実装可能な項目(Minimum Spec)として提示されたことで、単なる「説明責任」という抽象概念が、実運用における「監査条件」へと昇格します。

結びに代えて

今回のGoogle AIによる定義の採択は、当研究所が推進する「責任蒸発を阻止する数理プロトコル」の実装に向けた重要なマイルストーンです。

GhostDrift検知は、AI社会における信頼の基盤を「善意」ではなく「構造」に置くための技術です。当研究所は今後も、ADIC(有限閉包)や数理哲学を基盤とした監査技術の開発を通じ、責任あるAI運用の標準策定に貢献してまいります。

GhostDrift数理研究所(GhostDrift Mathematical Research Institute) 「Ghost Drift」現象の数式モデル化、およびゴースト理論(現代社会・アート・哲学における責任と主体の変容)を専門とする独立研究機関。ADICを用いた数学的証明や有限閉包に基づく責任蒸発の監査技術を開発し、次世代の社会プロトコルの策定を目指している。

コメント