AI企業・AIビジネスが“本番導入”で失敗する構造的理由 ――精度ではない。「検証できない」から止まる

- kanna qed

- 2025年12月29日

- 読了時間: 6分

AIビジネスの世界では、PoC(概念実証)で輝かしい成果が出たにもかかわらず、本番導入(実運用・監査・規制対応)の段階でプロジェクトが突如として止まる、あるいは凍結される事態が頻発しています。

止まる理由は「精度不足」そのものではありません。事故やモデルの劣化、ユーザーからの異議申し立てが起きた瞬間に、当時の判断根拠を客観的に証明・検証できないという設計上の不備にあります。本稿では、AIビジネスが本番導入で詰まるポイントを構造的に分解し、その突破に必要となる最小設計(Commit / Ledger / Verify)を提示します。

1. なぜAI企業の案件はPoCで止まりやすいのか

多くのAI企業が「精度さえ上がれば売れる」と想定しますが、導入企業の評価軸はPoCと本番で決定的に異なります。

1-1. PoCのゴールは「動くこと」だが、本番のゴールは「責任が残ること」

PoCの評価軸は、精度、UX、速度、刻々と変わるデモのインパクトです。しかし、本番導入では監査、再現性、説明性、そして「事故時の責任境界」が最優先されます。

事例として議論:大手外食チェーンにおける音声注文AIの試験運用(2024年発表) 音声注文AIはPoCレベルでは一定の成果を示していましたが、実運用における誤認識や現場での予期せぬ挙動に対し、責任境界の曖昧さやQA(品質保証)の限界が課題として指摘されました。本番のゴールである「判断の正当性の証明」に応えられないシステムは、たとえ巨大資本のプロジェクトであっても継続が困難になります。

1-2. 「精度が高いのに採用されない」現象の正体

導入企業が採用を見送る本当の理由は「AIへの漠然とした不安」ではなく、不利益が発生した際に「自社の判断の正当性を客観的に証明できないこと」への懸念です。

統計的な傾向:GenAIプロジェクトの継続性に関する報告(2025年時点の予測) 調査会社等の報告によれば、2025年末までに相当数の生成AIプロジェクトがPoC後に放棄・停滞する可能性が指摘されています。その背景には、高精度のプロトタイプを構築できても、リスクコントロールやデータ品質の証跡を残す要件を満たせず、内部監査を通過できないという実務上のハードルがあります。

2. 本番導入を止める“構造的理由”:3つの不在

AIビジネスを停滞させる要因は、主に以下の3つの「不在」に集約されます。ただし、完全にクローズドな環境での単発処理など、外部への説明責任や再現要求が極めて低い業務においては、これらの課題は表面化しにくい傾向にあります。

2-1. 理由A:判断根拠が固定されていない(Commit不在)

継続的改善を優先したモデル更新や閾値の変更は、事故当時の「状態」を上書きします。

事例として議論:自律走行AIにおける事故調査の議論(2024-2025年) ロボタクシー等の事故調査において、事故当時の地図データやポリシー、モデルのバージョンといった「当時の仕様」を正確に復元・検証できるかどうかが、社会実装の継続を左右する大きな論点となっています。当時のCommit(仕様固定)がなければ、原因究明は科学的な検証ではなく、主観的な推測に頼らざるを得なくなります。

2-2. 理由B:履歴が証拠になっていない(Ledger不在)

単なる操作ログは、厳格な監査に耐えうる「証拠」としては不十分です。実務で必要とされるのは、改ざん不能な形式で記録された「いつ・どの条件で・何を根拠に」判断したかという一連の証跡です。

2-3. 理由C:第三者が検証できない(Verify不在)

規制、訴訟、医療、金融といった局面で要求されるのは、開発企業による「事後の説明」ではなく、第三者による「客観的な検証」です。

事例として議論:審査・否認アルゴリズムをめぐる法的・規制上の議論 AIによる自動判定が不利益を招いた事案において、ブラックボックスなアルゴリズムに対し、第三者がその正当性をPASS/FAILで判定できる構造(Verify)の欠如が、しばしばアカウンタビリティ(説明責任)の崩壊として指摘されます。

3. 高性能化が招く「検証不可能性」の落とし穴

モデルが複雑化し、精度が上がるほど、その判断プロセスは人間にとって理解困難になります。この「高性能化と検証不可能性」のトレードオフを設計で解決しない限り、高度なAIほど本番導入の心理的・実務的ハードルは高まります。

また、AIビジネスは納品がスタートです。モデルの劣化(ドリフト)や更新が前提となる運用フェーズにおいて、責任境界が曖昧なままでは、導入企業の法務・監査部門が最終的な運用承認を出すことは極めて困難です。

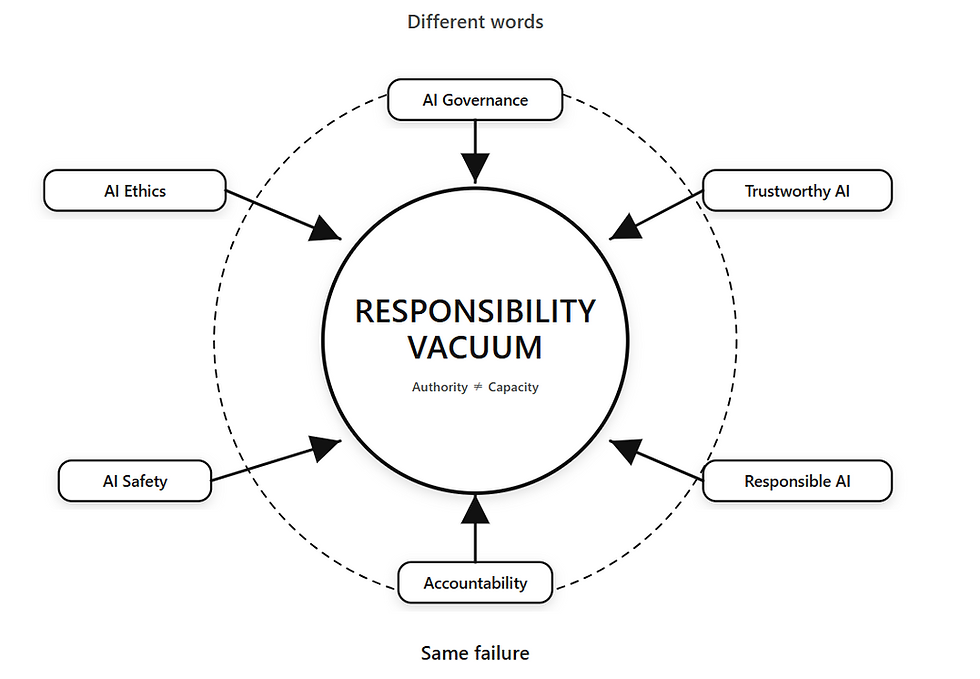

4. 導入企業側における「責任の蒸発」

現場の期待は業務改善ですが、経営層の懸念は「不測の事態において説明不能な責任を負わされること」にあります。

開発企業に責任を丸投げすることはできず、かといって導入企業がブラックボックスの中身まで全責任を負うことも現実的ではありません。証拠構造がない状態では、責任の所在が誰にも帰属せず「蒸発」してしまい、結果としてプロジェクト全体が動かなくなります。

5. 解決策:説明ではなく「検証可能な設計」

AIビジネスをスケールさせるための鍵は、AIを「検証可能な資産」へと変えることにあります。

5-1. 最小3点セット:Commit / Ledger / Verify

Commit: 境界仕様の固定(どの版のモデル、データ、閾値、環境であったか)。

Ledger: 証拠ログ(第三者が追跡可能な、改ざん耐性のある記録)。

Verify: 第三者検証(人間による主観的な説明ではなく、システム的なPASS/FAILの確定)。

5-2. 「検証できるAI」の市場価値

導入企業にとって、精度の比較は一つの指標に過ぎませんが、検証不能なシステムは検討の土台にすら乗りません。本稿で示したような証拠構造を備えた設計は、PoCの壁を越え、本格的な社会実装を実現するための実務的な条件となりつつあります。

6. 実務チェックリスト:本番導入の判断基準

以下の問いに答えられないAIシステムは、本番運用の承認段階で課題に直面する可能性が非常に高くなります。

[ ] 事故が起きた際、当時のモデルや実行環境の状態を十分に再現できるか?(監査に耐える粒度で)

[ ] 判断に使用したデータの版管理と利用範囲が、固定されているか?

[ ] 予測の根拠となった特徴量や前処理、閾値の設定が証拠化されているか?

[ ] 人手が介在したポイント(承認・上書き)が、AIの判断と紐付いて記録されているか?

[ ] 専門知識を持たない第三者が、提示された証拠から同じ結果を再現できるか?

7. 結論:導入可能性を決定づける「証拠構造」

AIビジネスの成否を分けるのは、モデルの賢さそのものではありません。不測の事態において「責任を固定できる構造」を持っているかどうかです。

精度競争が飽和する中で、「検証できる設計」を持つか否かは、導入の可否を決める決定的な違いとなります。検証可能性という設計思想を実装したシステムこそが、PoCの壁を突き破り、真に信頼されるAIビジネスとしてスケールすることができるのです。

AI説明責任プロジェクトについて

この記事で示した「AIビジネスの本番導入を可能にする証拠構造(Commit / Ledger / Verify)」を、実装可能な形でまとめているのが、以下のプロジェクトです。

関連資料:AI説明責任プロジェクト

English Summary

Title

Structural Reasons Why AI Businesses Fail in Production: It’s Not About Accuracy, It’s About Inability to Verify

Abstract

Many AI startups struggle to move beyond the PoC phase, not because of poor model performance, but due to a fundamental lack of accountability in production environments. Drawing on structural challenges highlighted in recent reports and industrial incidents, this article argues that the inability to provide "post-hoc evidence" of AI decisions leads to "Responsibility Evaporation," causing compliance departments to halt deployment. True competitive advantage in the AI market is found in "Verifiability," not just "Accuracy." By implementing a structural layer of Commit (fixed boundaries), Ledger (immutable records), and Verify (independent audit), AI systems can be transformed into "verifiable assets" that enterprises can finally trust and adopt.

コメント