責任の真空にどう対処するか:なぜ責任工学が必要なのか

- kanna qed

- 1月29日

- 読了時間: 4分

0. 導入:絶望ではなく、前提条件として

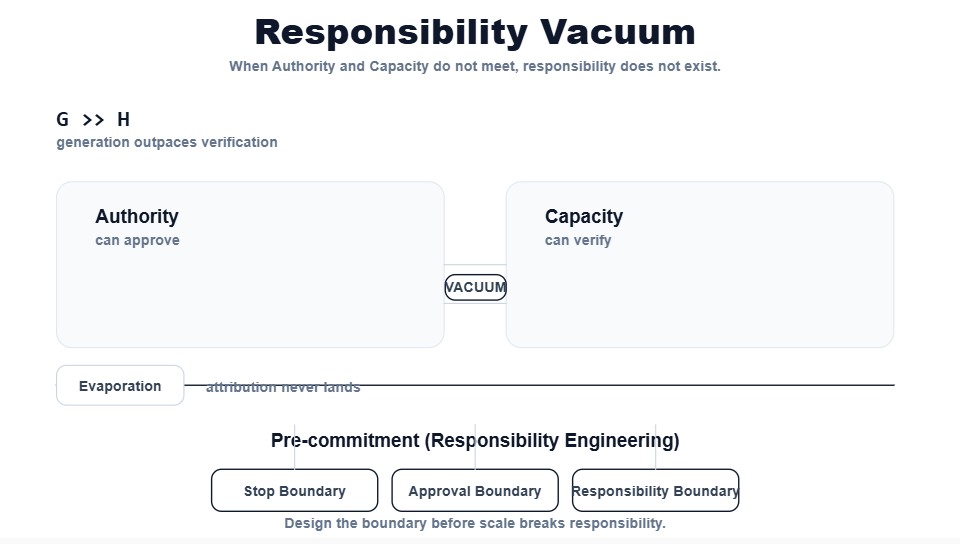

前稿では、スケーリングされたAIシステムにおいて「責任の真空(Responsibility Vacuum)」が不可避的に発生する構造を論じた。 これは「誰かが怠慢だから」起きるのではない。物理的なスループットと認知能力の限界点で発生する相転移である。(※本稿の「相転移/物理的」は比喩であり、厳密物理モデルの導入を意味しない。主張は「GとHの構造的不均衡により、レビューが儀式化する境界が生じる」という点に限る。)

では、私たちは絶望すべきだろうか? 否である。 真空が「例外」ではなく「前提条件」であるならば、私たちの取るべき戦略は一つしかない。 「成立しない責任に、工学的にどう対処するか」 この問いに答えるのが、本稿のテーマである。

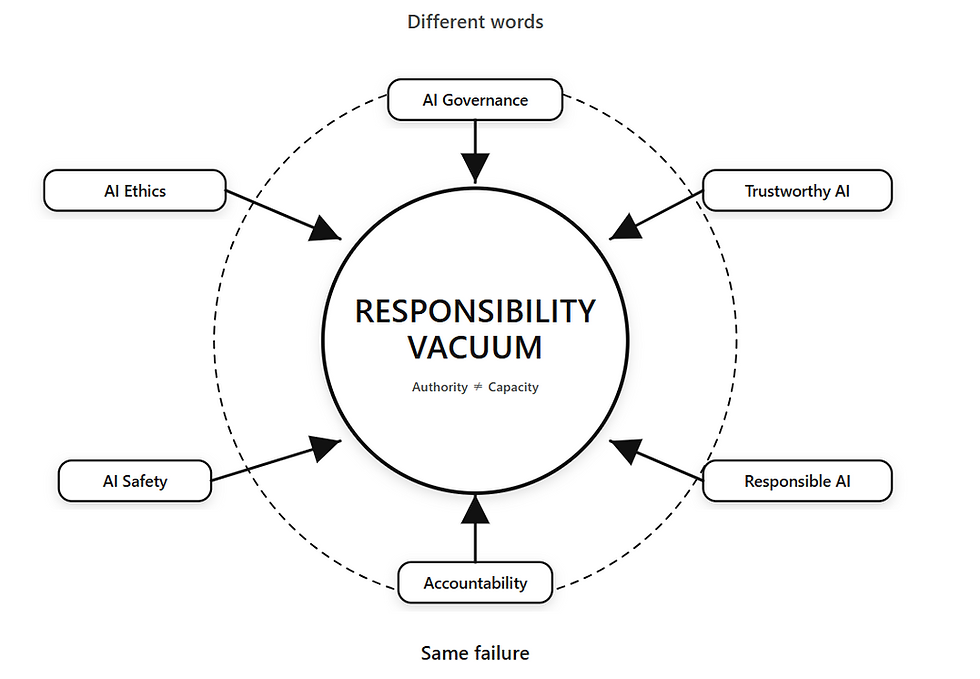

1. なぜ従来の対処は失敗するのか

多くの組織が、AIによる事故や品質低下に対して、以下のような「常識的」な対策を講じようとする。

レビューを厳格化する: 人間にもっと時間をかけさせる。

CI/チェックを増やす: 自動テストのカバレッジを上げる。

承認者を増やす: ダブルチェック、トリプルチェックを行う。

しかし、責任の真空($G \gg H$)の領域では、これらはすべて失敗する。 なぜなら、これらはすべて「人間の検証能力($H$)」がボトルネックであることを無視し、形式的な「権限(Authority)」だけを肥大化させる行為だからだ。

CIを増やせば代理シグナルが増え、一次情報への接触は減る。承認者を増やせば「誰かが見ているだろう」というバイアス(真空の拡散)が加速する。 これらは真空を埋めない。Authorityの行使点だけを増やし、Capacityの接地を減らすため、Vacuum条件(Authority ∧ Capacity の不在)を強化する。

2. 問いの置き換え

解決への第一歩は、問いの質を変えることだ。

誤った問い:「誰が責任を持つべきか?」

(真空条件では成立しない)

正しい問い:「どこまでを責任が成立する領域として許容するか?」

真空領域においては、責任は人間に「期待」するものではなく、システムとして「区画」すべきものになる。 ここで初めて、議論は道徳論を離れ、「境界設計(Boundary Design)」の問題へと移行する。

3. 責任工学(Responsibility Engineering)とは何か

ここで提唱するのが「責任工学(Responsibility Engineering)」である。

これは、責任を「担当者の善意や努力」に委ねることをやめ、以下の原則に基づいて工学的にアプローチする手法である。

定義:責任が成立する条件を、事前に設計として固定する。

要件:Capacity を超える領域に Authority を渡さない。

結果:事後説明(Post-hoc Explanation)に依存しない。

道徳ではなく、アーキテクチャによって責任を担保する。

4. 対処の核心:3つの事前制約

責任工学の実装は、以下の3つの境界(Boundary)を仕様として固定することによって行われる。これらはスローガンではなく、コードやプロセスとして実装されるべき制約である。

1. Stop Boundary(停止境界)

定義: 生成スループットと検証能力の比率($G/H$)を監視し、閾値を超えた瞬間にパイプラインを物理的に遮断する。ここでの $G/H$ は厳密計測でなくてよい。PR流量、変更量、テスト時間、レビュー滞留、再現ログ生成コスト等の proxy で上限を外向きに見積もり、閾値超過なら hard fail する。

効果: 「見きれないが、とりあえず通す」という儀式化を強制的に阻止する。

2. Approval Boundary(承認境界)

定義: Proxy Signal のみでは Approve イベントが発火しない。CIが緑であることなどの代理シグナルに加え、一次情報の参照ログや、再現環境への署名を必須化するUI/UXを実装する。

効果: 能力(Capacity)を伴わない権限(Authority)の行使を、システム側で拒絶する。

3. Responsibility Boundary(責任境界)

定義: 個別の人画による検証が不可能な領域(真空領域)を明示的に定義する。その境界線の向こう側では、個別の承認責任を問わず、「システムレベルのオーナーシップ(組織責任)」へと責任モードを切り替える。切替単位は decision ではなく batch(リリース/モデル更新/日次運用束など)として定義し、個別承認責任ではなくバッチの所有責任として管理する。

効果: 「誰が承認したんだ」という不可能な犯人探し(責任の蒸発)を未然に防ぎ、リスクを組織として管理する。

5. 何を諦め、何を守るか

責任工学は魔法ではない。トレードオフを受け入れる覚悟が必要だ。

放棄 (Give up):

完全な事後説明可能性(なぜそのAIがそう判断したか)。

個別の意思決定に対する、個人の責任追及。

保護 (Protect):

責任が成立する範囲の明確さ(真空の封じ込め)。

失敗した際に、誰にも責任が帰属せず霧散してしまう(蒸発する)構造の回避。

組織としての健全なリスクガバナンス。

6. 結論

スケーリングされた世界において、責任の真空は構造的に再発する。 真空が存在する以上、従来型の手続きのままでは事後的に責任を問う根拠が残らない。

だからこそ、私たちは「前もって閉じる」しかない。 責任工学とは、不可能な責任を人間に負わせる残酷さを終わらせ、責任が成立可能な領域を設計によって守り抜くための技術なのである。

コメント