OR責任設計委員会の設立(OR-Responsibility Design Committee (OR-RDC))

- kanna qed

- 1月8日

- 読了時間: 8分

1. 設立の背景と目的 (Mission Statement)

1.1 OR(オペレーションズ・リサーチ)の再定義

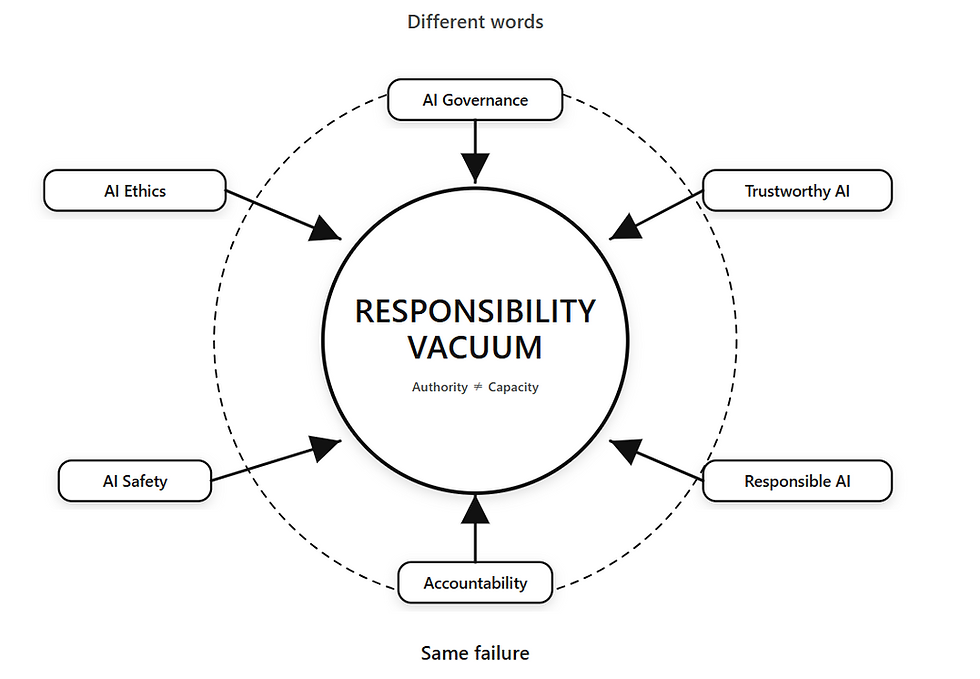

現在、社会実装されている多くのOR(数理最適化モデル)は、「効率の最大化」を主目的として設計されています。しかし、複雑性が増した現代のシステム(AI、高度物流、自動運転)において、最適化の追求はしばしば「責任の蒸発」を招き、事故後の合意形成コストを無限大に発散させています。

当委員会(OR-RDC)は、ORを単なる「最適化ツール」ではなく、**「意思決定を形式化し、運用するための数理理論」**として再定義します。

1.2 委員会のミッション

本委員会の目的は、最適化が現実世界と接触して破綻する地点(不可知領域)を特定し、そこにおける**「停止条件」「介入判断」「責任所在」を、事後的な倫理ではなく事前的な数理制約(ORの拡張モデル)として設計・標準化すること**にあります。

我々は「AIやシステムはいかにあるべきか(Should)」という道徳的議論は行いません。代わりに、「システムはどこで止まり、誰が引き受けるべきか(Must)」という構造的境界のみを扱います。

1.3 なぜOR-RDCが必要か(我々が担う必然性)

GhostDrift理論は、ORの外側から「倫理」や「規範」を付け足す提案ではありません。ORが社会実装に到達したとき必ず直面する、責任の不確定・説明の発散・事後合理化による目的関数の変形という“破綻点”を、OR内部の制約として形式化し、可行領域を有限に閉じるための拡張です。

したがってOR-RDCの役割は、ガバナンスを別体系として追加することではなく、社会実装に耐える「完成されたOR」へOR自体を拡張することにあります。この拡張を担う主体が必要であり、そのためにOR-RDCを設立します。

1.4 標準化の意義(なぜ“標準”でなければならないか)

責任の蒸発は、個別組織のモラルの問題ではなく、標準不在によって発生する構造問題です。責任境界・停止条件・介入プロトコルが標準化されていない環境では、説明不能性や合意形成コストが組織外へ外部化され、短期的な効率最適化が常に優勢となります。その結果、事故後には「誰も引き受けない」状態が常態化し、運用の持続可能性が失われます。

OR-RDCが標準化するのは、倫理規範ではなく、意思決定システムが現実世界と接触したときに避けられない破綻点(説明の発散/責任不確定/事後合理化)を、共通仕様(制約・ログ・評価指標)として事前に固定するための技術標準です。標準が普及した環境では、短期最適化が外部化によって成立する余地が減り、システムは「止めるべきときに止まる」形へ収束します。

具体例として、環境負荷の外部化、AIの暴走と責任空白、過剰成長による信頼・人材の離脱はいずれも、標準不在下で短期最適化が優勢になるときに生じる同型の現象です。これは自然環境・社会制度・AI運用における“警句”(過剰最適化の反作用)を、道徳ではなく運用設計として受け取るための枠組みです。

1.5 理論的定位(Theoretical Positioning)

本委員会が提唱するGhostDrift理論は、既存のOR理論に対し以下の位置づけを持ちます。

既存ORが扱わない(扱えない)領域:

想定外(Unknown Unknowns)

事後合理化(Post-hoc Rationalization)による説明変数の改変

「説明が増えることで責任が消える」という説明コストの発散現象

GhostDriftが導入する新軸:

不可知境界(Incomputable / Unknowable Boundary)

事後説明不能性(Post-hoc Impossibility)

責任固定(Responsibility Fixation)

これらは「最適化の軸」ではありません。意思決定の存在条件そのものです。 本理論は、確率的最適化やロバスト最適化が前提としてきた「不確実性は事前に形式化可能である」という暗黙仮定を解除します。不確実性を縮減・吸収するのではなく、意思決定前に不可知性を固定することで、事後的説明の自由度を制限する枠組みを提供します。

この意味で本理論は、最適化理論ではなく、**意思決定が社会的に成立するための前段条件(pre-decision constraint)を与えるOR拡張**であると定義されます。

2. 核心概念と定義 (Core Concepts & Definitions)

当委員会では、ガバナンスや責任論を、以下の通りORの用語(変数・制約・関数)へと翻訳して扱います。

概念(GhostDrift理論) | ORにおける定義(数理翻訳) | 実装上の意味 |

不可知境界 (Unknowable Boundary) | 可行領域の有限閉包 (Finite Closure of Feasible Region) | 最適化計算を継続すると、事後の説明コストが利益を上回る限界点。「これ以上は計算してはならない」という停止ラインであり、境界外への探索(モデル拡張・説明追加・目的関数変更)を禁止する閉包として機能する。 |

責任固定 (Responsibility Fixation) | 決定変数への主体ID拘束 (Binding Agent ID to Decision Variables) | 「誰の判断か」というメタデータを変数に不可分に結合し、事後的な責任転嫁をデータ構造レベルで不可能にする。 |

後付け不能性 (Post-hoc Impossibility) | 目的関数の事後変更禁止制約 (Constraint on Objective Function Mod.) | 結果を見てから「当時は合理的だった」とパラメータを再調整することを防ぐ、時系列的な不可逆性の保証。 |

説明コスト (Explanation Cost) | ペナルティ項および上限(Budget)制約 (Penalty Term & Budget Constraint) | 説明責任の複雑さをコストとして計上し、「説明できないブラックボックス解」が選ばれないようにする。説明バジェットの上限を設定することで、無限の言い訳(説明の発散)による意思決定遅延を数理的に防止する。 |

3. 活動領域とスコープ (Scope of Activities)

当委員会は、以下の3つのフェーズにおける「責任設計の標準化」を行います。

Phase 1: 境界設計(Boundary Design)

活動: システムが自律的な最適化を放棄し、人間に判断を委譲すべき「トリガー条件」の標準策定。

問い: 「配送遅延確率が何%を超えたら、あるいは説明変数の次元がいくつを超えたら、AIは判断を停止すべきか?」

問い(追加): 「マルチエージェント環境において、**責任主体が単一に確定できない状態(Agent Ambiguity)**が発生した瞬間をどう検知するか?」

Phase 2: プロトコル設計(Protocol Design)

活動: 機械から人間へ、あるいは人間から機械へ権限が移動する際の「署名(Handshake)」プロトコルの策定。

問い: 「緊急停止時に、現場担当者のどのレベルの権限があれば介入可能とするか?そのログはどう保存されるか?」

Phase 3: 評価関数設計(Evaluation Design)

活動: 「効率」だけでなく「停止時の安全性」や「責任の明確さ」を評価するための新しい指標(KPI)の定義。

問い: 「利益は出ているが、誰も中身を説明できないモデル」を、監査上どうやって不適合(Invalid)と判定するか?

4. 対象ドメイン (Target Domains)

(宣言)対象は特定業界ではなく、意思決定一般である

OR-RDCの対象は特定ドメインに限定されません。本委員会が標準化するのは、物流・AI・インフラ等の個別応用ではなく、不確実性下での意思決定を運用するあらゆるシステムに共通する「責任境界設計」そのものです。以下に示すドメインは初期の適用例にすぎず、委員会成果は意思決定理論・運用設計に関わる全領域へ波及することを前提とします。

4.1 物流・サプライチェーン (Logistics)

(天候や災害による遅配時の責任固定。合意形成コストとしての不可知境界適用)

4.2 AIガバナンス・自律エージェント (AI Agents)

(LLM等の幻覚や暴走に対する、数理的な「自信なし」判定とエスカレーション構造)

4.3 公共インフラ・エネルギー (Infrastructure)

(電力需給調整等における、事後検証可能な責任追跡ログの実装)

4.4 金融・アルゴリズム取引 (Finance)

(市場環境の定義外変動時における、強制的な停止ルールの標準化)

5. 先行研究と学術的位置づけ (Academic Context & Related Work)

GhostDrift理論は、以下のOR先行研究の系譜に接続し、その「未解決領域(事後合理化の防止・責任固定)」を補完する拡張理論として位置づけられます。

5.1 不確実性の事前固定 (Robust Optimization)

GhostDriftにおける「事後の説明増殖を防ぐために、不可知領域を事前に固定する」というアプローチは、ORの中核的潮流であるロバスト最適化の「不確実性集合の固定」を、説明責任のレイヤーへ拡張したものです。

Ben-Tal, A., El Ghaoui, L., & Nemirovski, A. (2009). Robust Optimization. Princeton University Press.

Bertsimas, D., & Sim, M. (2004). The price of robustness. Operations Research, 52(1).

Yanıkoğlu, İ., Gorissen, B. L., & den Hertog, D. (2019). A survey of adjustable robust optimization. European Journal of Operational Research.

5.2 モデル不確実性と防御的決定 (Distributionally Robust Optimization)

「どのモデル(解釈)が正しいかわからない」状況下で最悪ケースを担保するDROの考え方は、事故後に都合の良いモデルへのすり替え(Post-hoc)を防ぐGhostDriftの思想と数理的に整合します。

Delage, E., & Ye, Y. (2010). Distributionally robust optimization under moment uncertainty with application to data-driven problems. Operations Research, 58(3).

Kuhn, D., Esfahani, P. M., Nguyen, V. A., & Shafieezadeh-Abdeh, S. (2025). Distributionally robust optimization. Acta Numerica.

5.3 深い不確実性と予測不能性 (Decision Making under Deep Uncertainty)

予測精度の向上を諦め、予測不能であることを前提に意思決定プロセスを設計するDMDUやRDMのアプローチは、GhostDriftの「不可知境界」の直接的な先行研究となります。

Marchau, V. A., Walker, W. E., Bloemen, P. J., & Popper, S. W. (2019). Decision Making under Deep Uncertainty: From Theory to Practice. Springer.

Haasnoot, M., Kwakkel, J. H., Walker, W. E., & ter Maat, J. (2013). Dynamic adaptive policy pathways. Global Environmental Change.

5.4 説明可能性と統制 (XAIOR & Model Risk Management)

GhostDriftが提唱する「責任の固定」は、近年の説明可能OR(XAIOR)における規範的枠組みや、金融規制におけるモデルリスク管理(MRM)の実装要件を、数理的制約として定式化するものです。

De Bock, K. W., et al. (2024). Explainable AI for Operational Research: A defining normative framework (XAIOR). European Journal of Operational Research.

Federal Reserve & OCC (2011). SR 11-7: Guidance on Model Risk Management.

Bank of England / PRA (2023). SS1/23: Model risk management principles for banks.

6. 成果物とロードマップ (Deliverables)

短期 (0-6ヶ月)

GhostDrift Whitepaper v1.0: 「ORの拡張としての責任設計」の基礎理論公開。

定義集 (The Dictionary): 「不可知」「責任」「境界」の数理的定義リストの策定。

中期 (6-12ヶ月)

運用ガイドライン (Implementation Guide): 企業が自社のシステムに「責任制約」を導入するための手順書。

参照モデル (Reference Implementation): 物流シミュレーションを用いた、GhostDrift準拠モデルのデモ公開。

長期 (12ヶ月以降)

適合性評価基準 (Certification Standard): 企業やシステムが「OR-RDC標準」に準拠しているかを監査するためのチェックリスト。

7. 結論 (Conclusion)

公式ポジション宣言

GhostDrift理論は、オペレーションズ・リサーチにおける**「最適化以前に、意思決定が成立する条件」**を数理的に与える拡張です。 本理論は、不確実性を減らすのではなく、不可知性を固定することで責任の蒸発を防ぐ、新しいORの位相を定義します。

OR-RDCは、この理論に基づき、「責任」という人間社会の最後の砦を、数理モデルという堅牢なコンテナの中に安全に格納するための技術を標準化します。これは、社会実装に耐えうる「真に完成されたOR」の始まりです。

コメント