AIは説明できるほど無責任になる──「責任の蒸発」を止める不可知境界という運用設計

- kanna qed

- 1月8日

- 読了時間: 4分

実装チェックリスト:不可知境界プロトコル(3ステップ)

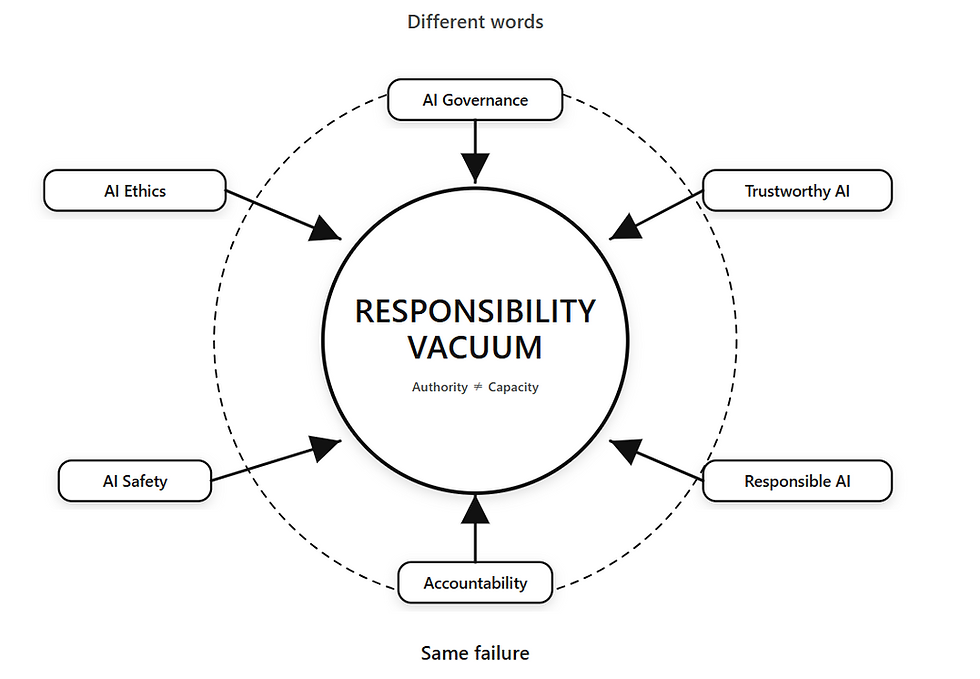

AI事故やシステム障害が起きたとき、なぜ「誰も責められない」という無力感が残るのか。それは、事故のあとに「説明」を増やせば増やすほど、責任の所在が分散し、蒸発していくからである。

本稿は、稼働前に『わからなさ』を固定し、事故後の事後合理化を不可能にする具体的な“運用プロトコル”を提示する。

GhostDrift数理研究所が提唱する「不可知境界(Unknowable Boundary)」と「責任固定(Responsibility Fixation)」の理論を、2つの高リスクなビジネスケースに適用し、その処方箋を公開する。

Case 1:自動運転AIによる歩行者衝突事故

【事後合理化による責任の蒸発】

ある自動運転車が、特殊な服装をした歩行者を認識できずに衝突したとする。事故後、提供企業は往々にしてこう弁明する。 「当時の学習データにはこの服装のパターンが含まれておらず、認識は困難でした。今回の事象は当時の技術水準では『想定外』であり、今後はデータを追加して再発防止に努めます。」

構造的課題: 事故のあとに「想定外」という言葉で境界線を引き直している。これは典型的な**事後合理化(post-hoc rationalization)**であり、責任が「データの不足」という曖昧な対象に転嫁され、手続き的な責任追及が不可能になる。

【不可知境界プロトコルによる責任固定】

GhostDriftのプロトコルでは、デプロイ(稼働)の**「前」**に以下の3ステップを完遂する。

Step 1: Boundary宣言(定義) 「センサーの物理的限界および学習未済の視覚パターンに対する反応」を、**『予測不能な空白』**として事前に定義し、仕様書に明記する。

Step 2: Go判断の署名(受付) 「Step 1で定義した空白から生じるリスクを承知の上で、稼働を許可する」という判断主体の署名と、当時の内部データ(Inside)をセットでハッシュ化し記録する。

Step 3: 事後更新ルール(制約) 「データの追加」は推奨されるが、事故発生時に境界(Boundary)を再描画して免責を生成する行為を手続き的に禁止する。(=「想定外」を後から作ることを構造的に封殺する。)

結果: 事故発生時、「データがなかった」という言い訳は構造的に封じられる。責任は「その空白を承知でGoサインを出した判断」へと即座に固定される。

Case 2:アルゴリズム取引AIによるフラッシュ・クラッシュ(市場暴落)

【事後合理化による責任の蒸発】

運用AIが市場変動に過剰反応し、パニック売りで損失を出した際、運用会社はこう弁明する。 「アルゴリズムは当時の流動性に対して合理的でしたが、他社AIとの予期せぬ相互作用が発生しました。これは不可抗力です。」

数理的課題: 評価関数を事後に拡張し、責任を「環境」へと分散させている。これは、事故後に“考慮要因”を追加できる自由度、すなわち説明の逃げ道の次元 $\mathcal{E}(D)$ が無限に発散している状態である。

事故後に追加されうる“正当化の操作”全体を $\mathcal{J}_D$ とおく。

$$\mathcal{E}(D) := \dim \left( \mathcal{J}_D \right)$$

(※ $\mathcal{E}(D)$ は、事故後に後付けで正当化可能な写像の集合の次元を表す。この値が高いほど、責任は蒸発しやすい。)

実装では $\mathcal{J}_D$ を“変更可能な正当化パッチ集合”として定義し、ハッシュ固定された評価関数・観測点・更新規則に反するパッチを無効化する。

【責任固定プロトコルによる構造的阻止】

このシステムに「責任固定(Responsibility Fixation)」の数理原理を組み込む。

Step 1: Boundary宣言(定義) 評価関数(リスク許容度・利得計算)を、事後に変数を追加できない形で固定し、その「適用限界領域」を明示する。

Step 2: Go判断の署名(受付) 指定された「観測点(Anchor)」と評価関数に基づき、どのパラメータで判断を行うかを固定し、アルゴリズムの挙動に対する全責任を負う旨をログに刻む。

Step 3: 事後更新ルール(制約) 異常検知時の挙動を有限の選択肢(Finite Closure)に閉じ込め、事後的に「新しい合理性」を捏造する操作を計算不可能にする。

結果: 暴落後、「市場が特殊だった」という弁明は通用しなくなる。固定された評価関数に基づき、その判断を下した「システム構造そのもの」に責任が留まり続ける。

結論:責任は「説明」ではなく「記録」に宿る

「説明責任(Accountability)」の本質は、事後に流暢に話す能力ではない。 真の責任とは、意思決定の瞬間に「ここから先はわからない」という不可知境界を自ら引き、その空白を含めた結果を丸ごと引き受ける責任固定にある。

GhostDriftが提供するソリューション(成果物)

本プロトコルの導入により、以下の成果物が実装される。

Boundary Spec(不可知境界仕様書): 稼働前に「何がわからないか」を厳密に定義した文書。

Go/No-Go Responsibility Log(判断署名ログ): リスク受容の主体と根拠をハッシュ化した改ざん不能な記録。

Post-hoc Impossibility Rule(事後改変不能ルール): 事後合理化を物理的・手続き的に排除するガバナンス規定。

Incident Playback Package(事後検証パッケージ): 固定された観測点・評価関数に基づき、事故当時の判断を完全再現する検証キット。

GhostDrift数理研究所は、この「言い訳の不可能性」を設計段階から組み込むことで、AI社会における誠実な決断の基盤を提供する。

コメント