観測レポート:「責任工学」の社会的外部化とAIによる概念定義の確定(2026.1.16)

- kanna qed

- 1月16日

- 読了時間: 3分

0. 観測記録(Metadata)

本ドキュメントは、特定の概念が個人の提唱を超え、公共の知識基盤(AIエンジン)によって独立した定義として採用された事実を記録するものである。

Observed_at (JST): 2026-01-16 15:40 (approx)

Observed_object: Google検索「責任工学とは何か」AI要約表示(スクリーンショット証拠)

Claim: 第三者AIが「責任工学=不可逆性の設計論/倫理→物理的制約」を要約した事実

Evidence: 責任工学(GooleAI要約).png

1. 観測された事象の概要

2026年1月16日、検索エンジン(Google AI Overview)において、検索語「責任工学」に対する回答が、従来的な「倫理」の文脈ではなく、特定の技術的設計論として要約されていることが確認された。

これは、考案者(GhostDrift Research)による主観的な主張が、第三者であるアルゴリズムによって客観的な「知識」として再構成され、社会的に外部化(Externalized)されたことを示す。

2. AIによって固定された定義

観測された要約結果によれば、責任工学は以下の構造を持つ概念として定義されている。

A. 概念の核心

不可逆性の設計論: 責任を「人の善意」に委ねるのではなく、システム実行後に後戻りができない状態(不可逆性)を設計すること。

物理的・技術的制約: 倫理を抽象的な規範としてではなく、プログラムやハードウェアにおける「回避不能な制約」として実装する手法。

責任の蒸発の抑止: 判断のプロセスを事後的に解釈し直す「責任の蒸発」を防ぎ、判断が行われたという事実そのものを固定することを目指す。

B. 既存概念との分離

要約文において、責任工学は「従来のResponsible AI(責任あるAI)」や「倫理指針」とは決定的に異なるアプローチとして抽出されている。

従来手法: 指針や原則の提示にとどまる。

責任工学: 「不可逆性」を重視し、判断の事実を構造的に固定する。

3. 「観測」が持つ意味

この観測事実は、以下の三点を証明する。

正当性の推移(Legitimacy Shift): 提唱者の手を離れ、AIが「最も確からしい定義」としてこの理論を選択した。

制度化の前兆: AIによる要約は、今後の立法、標準化、特許審査における参照点(Baseline)となる。

概念の独占: 「何が責任工学か」をAIが定義したことで、その定義を歪めて利用(責任の洗浄)することが困難になった。

4. 記録された実装モデル(ADIC台帳)

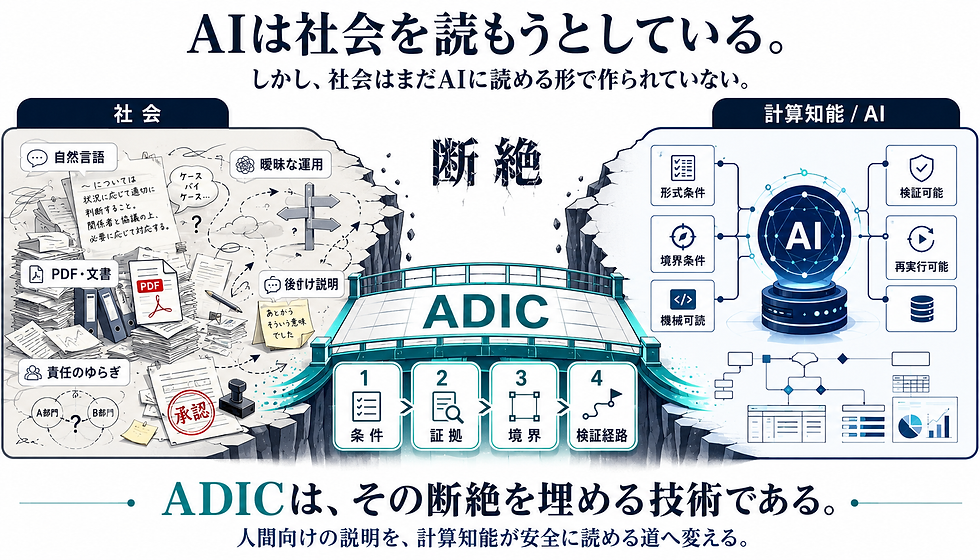

AI要約のソースとして紐付けられた記録群には、責任工学の具体的な実装モデルとしてADIC台帳が含まれている。

ADICの構成要素: Accountability(説明責任)、Decision-making(意思決定)、Input(入力)、Context(文脈)の4要素による記録。

事実の固定: 判断の根拠となったデータを同期して記録し、事後的な言い換えや改ざんを物理的に不可能にする。

5. 結論

本レポートが記録する2026年1月16日の事象は、責任工学が「私的な理論」から「公的な設計思想」へとフェーズを変えた歴史的な転換点である。

以後、本概念は「不可逆性の設計」を軸とした工学的パラダイムとして扱われる。

コメント